A desinformação e as teorias da conspiração são desafios significativos na era digital. Embora a Internet seja uma ferramenta poderosa para a troca de informações, ela também se tornou um terreno fértil para informações falsas. Teorias da conspiração, que antes estavam limitadas a pequenos grupos, agora têm o poder de influenciar eventos globais e ameaçar a segurança pública. Essas teorias, frequentemente disseminadas por meio das redes sociais, contribuem para a polarização política, riscos à saúde pública e desconfiança nas instituições estabelecidas.

A pandemia de COVID-19 destacou as graves consequências da desinformação. A Organização Mundial da Saúde (OMS) chamou isso de “infodemia”, onde informações falsas sobre o vírus, tratamentos, vacinas e origens se espalharam mais rapidamente do que o próprio vírus. Métodos tradicionais de verificação de fatos, como verificadores humanos e programas de educação midiática, precisaram se adaptar ao volume e à velocidade da desinformação. Essa necessidade urgente de uma solução escalável levou ao surgimento de chatbots de Inteligência Artificial (IA) como ferramentas essenciais no combate à desinformação.

Os chatbots de IA não são apenas uma novidade tecnológica. Eles representam uma nova abordagem para verificação de fatos e disseminação de informações. Esses bots interagem com os usuários em conversas em tempo real, identificam e respondem a informações falsas, fornecem correções baseadas em evidências e ajudam a criar um público mais bem informado.

O Surgimento das Teorias da Conspiração

As teorias da conspiração existem há séculos. Elas costumam surgir durante períodos de incerteza e mudança, oferecendo explicações simples e sensacionalistas para eventos complexos. Esses relatos sempre fascinou as pessoas, desde rumores sobre sociedades secretas até encobrimentos governamentais. No passado, sua disseminação era limitada por canais de informação mais lentos, como panfletos impressos, boca a boca e pequenas reuniões comunitárias.

A era digital mudou dramaticamente esse cenário. A Internet e plataformas de redes sociais como Facebook, Twitter, YouTube e TikTok tornaram-se câmaras de eco onde a desinformação prospera. Algoritmos projetados para manter os usuários engajados frequentemente priorizam conteúdo sensacionalista, permitindo que alegações falsas se espalhem rapidamente. Por exemplo, um relatório do Center for Countering Digital Hate (CCDH) descobriu que apenas doze indivíduos e organizações, conhecidos como os “doze da desinformação,” foram responsáveis por quase 65% da desinformação anti-vacina nas redes sociais em 2023. Isso mostra como um pequeno grupo pode ter um grande impacto online.

As consequências dessa disseminação desenfreada de desinformação são sérias. As teorias da conspiração minam a confiança na ciência, na mídia e nas instituições democráticas. Elas podem levar a crises de saúde pública, como visto durante a pandemia de COVID-19, onde informações falsas sobre vacinas e tratamentos dificultaram o controle do vírus. Na política, a desinformação alimenta divisões e torna mais difícil ter discussões racionais e baseadas em fatos. Um estudo de 2023 da Misinformation Review da Harvard Kennedy School descobriu que muitos americanos relataram ter encontrado informações políticas falsas online, destacando a natureza disseminada do problema. À medida que essas tendências continuam, a necessidade de ferramentas eficazes para combater a desinformação é mais urgente do que nunca.

Como os Chatbots de IA Estão Equipados para Combater a Desinformação

Os chatbots de IA estão emergindo como ferramentas poderosas para combater a desinformação. Eles utilizam IA e Processamento de Linguagem Natural (PLN) para interagir com os usuários de forma semelhante a humanos. Diferente de sites ou aplicativos tradicionais de verificação de fatos, os chatbots de IA podem ter conversas dinâmicas. Eles fornecem respostas personalizadas às perguntas e preocupações dos usuários, tornando-os particularmente eficazes para lidar com a natureza complexa e emocional das teorias da conspiração.

Esses chatbots utilizam algoritmos avançados de PLN para entender e interpretar a linguagem humana. Eles analisam a intenção e o contexto por trás da consulta de um usuário. Quando um usuário envia uma declaração ou pergunta, o chatbot procura palavras-chave e padrões que correspondam a informações falsas conhecidas ou teorias da conspiração. Por exemplo, se um usuário menciona uma alegação sobre a segurança das vacinas, o chatbot compara essa afirmação com um banco de dados de informações verificadas de fontes respeitáveis, como a OMS e o CDC, ou verificadores de fatos independentes como a Snopes.

Uma das maiores forças dos chatbots de IA é a verificação de fatos em tempo real. Eles podem acessar instantaneamente vastos bancos de dados de informações verificadas, permitindo que apresentem respostas baseadas em evidências adaptadas à desinformação específica em questão. Eles oferecem correções diretas e fornecem explicações, fontes e informações adicionais para ajudar os usuários a entender o contexto mais amplo. Esses bots operam 24 horas por dia, 7 dias por semana, e podem lidar com milhares de interações simultaneamente, oferecendo uma escalabilidade muito além do que os verificadores de fatos humanos podem fornecer.

Vários estudos de caso mostram a eficácia dos chatbots de IA no combate à desinformação. Durante a pandemia de COVID-19, organizações como a OMS utilizaram chatbots de IA para abordar mitos disseminados sobre o vírus e as vacinas. Esses chatbots forneceram informações precisas, corrigiram conceitos errôneos e orientaram os usuários para recursos adicionais.

Estudos de Caso de Chatbots de IA do MIT e UNICEF

Pesquisas mostraram que os chatbots de IA podem reduzir significativamente a crença em teorias da conspiração e desinformação. Por exemplo, uma pesquisa do MIT Sloan mostrou que chatbots de IA, como o GPT-4 Turbo, podem reduzir dramaticamente a crença em teorias da conspiração. O estudo envolveu mais de 2.000 participantes em diálogos personalizados e baseados em evidências com a IA, levando a uma redução média de 20% na crença em várias teorias da conspiração. Notavelmente, cerca de um quarto dos participantes que inicialmente acreditavam em uma conspiração passaram para a incerteza após a interação. Esses efeitos foram duradouros, durando pelo menos dois meses após a conversa.

Da mesma forma, o chatbot U-Report da UNICEF foi importante no combate à desinformação durante a pandemia de COVID-19, particularmente em regiões com acesso limitado a informações confiáveis. O chatbot forneceu informações de saúde em tempo real para milhões de jovens em toda a África e outras áreas, abordando diretamente as preocupações sobre a COVID-19 e a segurança das vacinas.

O chatbot desempenhou um papel vital em aumentar a confiança nas fontes de saúde verificadas, permitindo que os usuários fizessem perguntas e recebessem respostas credíveis. Ele foi especialmente eficaz em comunidades onde a desinformação era extensa e os níveis de alfabetização eram baixos, ajudando a reduzir a disseminação de alegações falsas. Esse engajamento com os jovens usuários provou ser crucial para promover informações precisas e desmascarar mitos durante a crise de saúde.

Desafios, Limitações e Perspectivas Futuras dos Chatbots de IA no Combate à Desinformação

Apesar de sua eficácia, os chatbots de IA enfrentam vários desafios. Eles são tão eficazes quanto os dados com os quais são treinados, e conjuntos de dados incompletos ou tendenciosos podem limitar sua capacidade de abordar todas as formas de desinformação. Além disso, as teorias da conspiração estão em constante evolução, exigindo atualizações regulares dos chatbots.

A parcialidade e a equidade também estão entre as preocupações. Os chatbots podem refletir as parcialidades nos dados de treinamento, potencialmente distorcendo as respostas. Por exemplo, um chatbot treinado com a mídia ocidental pode não entender completamente a desinformação não ocidental. Diversificar os dados de treinamento e monitorar continuamente podem ajudar a garantir respostas equilibradas.

O engajamento do usuário é outro obstáculo. Pode ser difícil convencer indivíduos profundamente enraizados em suas crenças a interagir com chatbots de IA. A transparência sobre fontes de dados e a oferta de opções de verificação podem ajudar a construir confiança. Utilizar um tom não confrontacional e empático também pode tornar as interações mais construtivas.

O futuro dos chatbots de IA no combate à desinformação parece promissor. Avanços na tecnologia de IA, como aprendizado profundo e sistemas de moderação impulsionados por IA, aprimorarão as capacidades dos chatbots. Além disso, a colaboração entre chatbots de IA e verificadores de fatos humanos pode proporcionar uma abordagem robusta à desinformação.

Além da desinformação sobre saúde e política, os chatbots de IA podem promover a literacia midiática e o pensamento crítico em ambientes educacionais e servir como conselheiros automatizados em locais de trabalho. Os formuladores de políticas podem apoiar o uso eficaz e responsável da IA por meio de regulamentações que incentivem a transparência, a privacidade dos dados e o uso ético.

Considerações Finais

Em conclusão, os chatbots de IA emergiram como ferramentas poderosas no combate à desinformação e às teorias da conspiração. Eles oferecem soluções em tempo real e escaláveis que superam a capacidade dos verificadores de fatos humanos. Ao fornecer respostas personalizadas e baseadas em evidências, ajudam a construir confiança em informações credíveis e promovem a tomada de decisões informadas.

Embora a parcialidade dos dados e o engajamento do usuário persistam, os avanços em IA e a colaboração com verificadores de fatos humanos trazem esperança para um impacto ainda mais forte. Com uma implantação responsável, os chatbots de IA podem desempenhar um papel vital no desenvolvimento de uma sociedade mais informada e verdadeira.

Conteúdo relacionado

Anthropic enviou um aviso de remoção a um desenvolvedor que tentava reverter o código de sua ferramenta.

[the_ad id="145565"] Na disputa entre duas ferramentas de código "agente" — Claude Code da Anthropic e Codex CLI da OpenAI — a última parece estar promovendo mais boa vontade…

O novo CEO da Intel sinaliza esforços de simplificação, mas não revela números exatos de demissões.

[the_ad id="145565"] Lip-Bu Tan, o novo CEO da Intel, enviou uma mensagem direta aos funcionários, afirmando que a empresa precisa se reorganizar para ser mais eficiente. Ele…

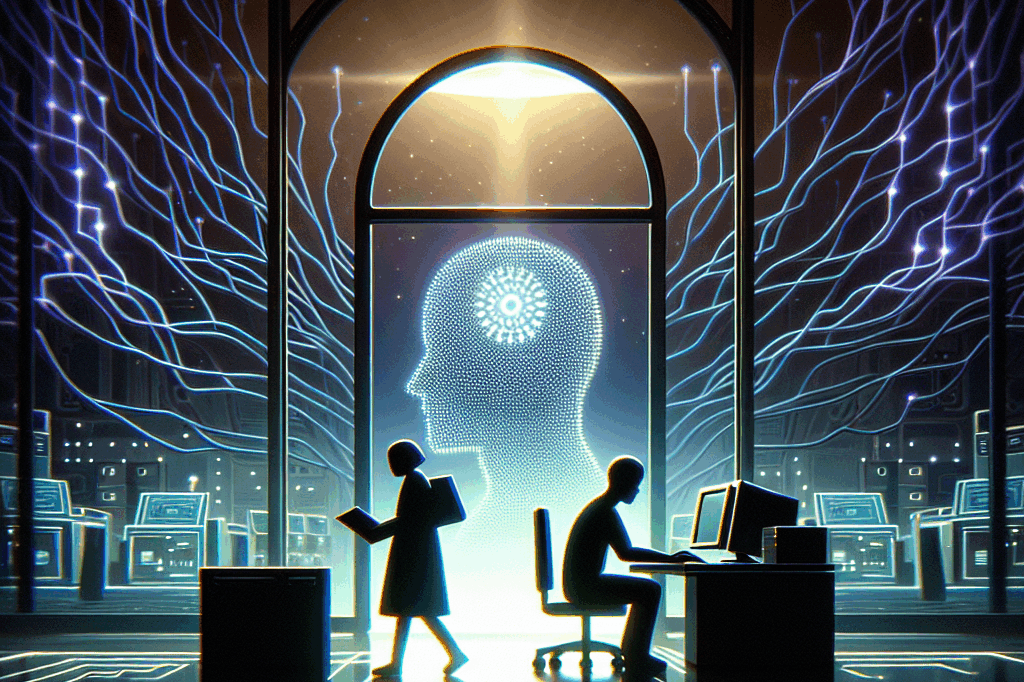

Um pesquisador da OpenAI que trabalhou no GPT-4.5 teve seu green card negado.

[the_ad id="145565"] Kai Chen, um pesquisador de IA canadense que trabalha na OpenAI e mora nos EUA há 12 anos, teve seu pedido de green card negado, de acordo com Noam Brown,…