Participe das nossas newsletters diárias e semanais para obter as últimas atualizações e conteúdo exclusivo sobre as melhores coberturas de IA do setor. Saiba mais

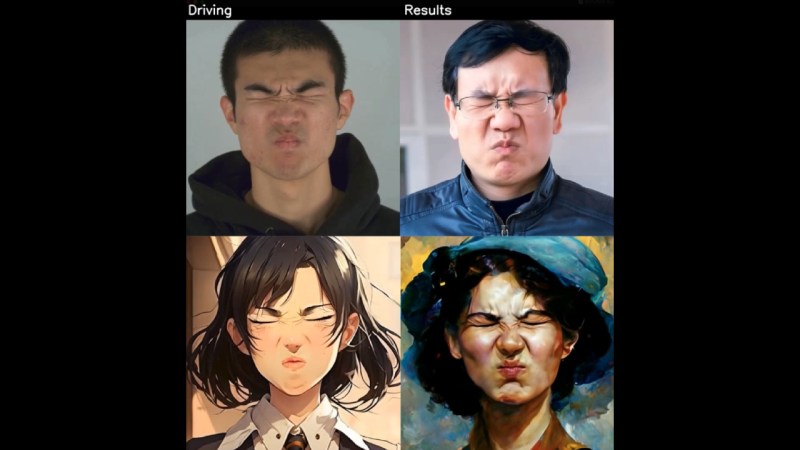

ByteDance revelou um sistema de inteligência artificial capaz de transformar qualquer fotografia em uma performance de vídeo convincente, com expressões sutis e profundidade emocional que rivalizam com imagens reais. O gigante tecnológico chinês, conhecido pelo TikTok, desenvolveu seu sistema “X-Portrait 2” para fazer imagens estáticas refletirem cenas de filmes famosos — com resultados tão realistas que borram a linha entre conteúdo autêntico e artificial.

As demonstrações do sistema mostram fotos fixas realizando cenas icônicas de filmes como “O Iluminado”, “A Face do Medo” e “Cercas”, capturando cada expressão nuance das performances originais. Uma única fotografia pode agora exibir medo, raiva ou alegria com o mesmo detalhe convincente de um ator treinado, enquanto mantém a identidade e características da pessoa original.

Esse avanço chega em um momento crucial. À medida que a sociedade lida com a desinformação digital e as consequências da eleição presidencial nos EUA, a capacidade do X-Portrait 2 de criar vídeos indistinguíveis da realidade a partir de qualquer fotografia levanta preocupações sérias. Ferramentas anteriores de animação em IA produziam resultados claramente artificiais, com movimentos mecânicos. Mas o novo sistema da ByteDance captura o fluxo natural dos músculos faciais, movimentos sutis dos olhos e expressões complexas que tornam os rostos humanos de forma única.

A ByteDance alcançou esse realismo através de uma abordagem inovadora. Em vez de rastrear pontos específicos em um rosto — o método padrão usado pela maioria dos softwares de animação — o sistema observa e aprende com os movimentos faciais completos. Onde sistemas mais antigos criavam expressões conectando pontos, o X-Portrait 2 captura o movimento fluido de um rosto inteiro, mesmo durante a fala rápida ou quando visto de ângulos diferentes.

O banco de dados de bilhão de usuários do TikTok: O segredo por trás do avanço em IA da ByteDance

A vantagem da ByteDance decorre de sua posição única como proprietária do TikTok, que processa mais de um bilhão de vídeos gerados por usuários diariamente. Essa imensa coleção de expressões faciais, movimentos e emoções fornece dados de treinamento em uma escala indisponível para a maioria das empresas de IA. Enquanto os concorrentes dependem de conjuntos de dados limitados ou dados sintéticos, a ByteDance pode aperfeiçoar seus modelos de IA utilizando expressões do mundo real capturadas em rostos diversos, condições de iluminação e ângulos de câmera variados.

A liberação do X-Portrait 2 coincide com a expansão da pesquisa em IA da ByteDance além da China. A empresa está estabelecendo novos centros de pesquisa na Europa, com potenciais locais na Suíça, Reino Unido e França. Um planejado centro de IA de $2,13 bilhões na Malásia e a colaboração com a Universidade Tsinghua sugerem uma estratégia para construir uma expertise em IA em múltiplos continentes.

Esse impulso global de pesquisa chega em um momento crítico. Enquanto a ByteDance enfrenta um escrutínio regulatório nos mercados ocidentais — incluindo a recente ordem do Canadá para que o TikTok cesse operações e os debates contínuos sobre restrições nos EUA — a empresa continua a avançar suas capacidades técnicas.

A próxima revolução de Hollywood: Como a IA pode substituir a captura de movimento de milhões de dólares

As implicações para a indústria de animação vão além das conquistas técnicas. Estúdios principais atualmente gastam milhões em equipamentos de captura de movimento e empregam centenas de animadores para criar expressões faciais realistas. O X-Portrait 2 sugere um futuro onde um único fotógrafo e um vídeo de referência poderiam substituir grande parte dessa infraestrutura.

Essa mudança ocorre em meio ao crescente debate sobre conteúdo gerado por IA e direitos digitais. Enquanto os concorrentes apressam-se em liberar seu código publicamente, a ByteDance manteve a implementação do X-Portrait 2 privada — uma decisão que reflete uma crescente consciência sobre como as ferramentas de IA podem ser mal utilizadas para criar performances não autorizadas ou conteúdo enganoso.

O foco da ByteDance no movimento humano e na expressão marca um caminho distinto em relação a outras empresas de IA. Enquanto empresas como OpenAI e Anthropic concentram-se no processamento de linguagem, a ByteDance baseia-se em sua força central: entender como as pessoas se movem e se expressam na câmera. Essa especialização surge diretamente da análise de tendências de dança e expressões faciais durante os anos de TikTok.

Essa ênfase no movimento humano pode provar ser mais significativa do que a atual análise de mercado sugere. À medida que o trabalho e a socialização se movem cada vez mais para espaços virtuais, tecnologias que capturam e transferem emoções humanas de forma precisa tornam-se cruciais. Os avanços da ByteDance a posicionam para influenciar como as pessoas interagirão em ambientes digitais, desde reuniões de negócios até entretenimento.

Preocupações de segurança em IA: Quando rostos digitais precisam de fechaduras digitais

A demissão em outubro de um estagiário da ByteDance por supostamente interferir no treinamento do modelo de IA destacou um aspecto muitas vezes negligenciado do desenvolvimento de IA: a segurança interna. À medida que os modelos se tornam mais sofisticados, proteger-se contra manipulações se torna cada vez mais crítico.

A tecnologia chega em um momento em que a demanda por conteúdo em vídeo gerado por IA cresce em entretenimento, educação e comunicação empresarial. Enquanto o X-Portrait 2 demonstra um progresso técnico significativo em manter uma identidade consistente enquanto transfere expressões sutis, também levanta questões sobre autenticação e verificação do conteúdo gerado por IA.

À medida que os governos ocidentais examinham empresas de tecnologia chinesas, os avanços da ByteDance em animação de IA apresentam uma realidade complexa: a inovação não conhece fronteiras, e o futuro de como interagimos online pode ser moldado por tecnologias desenvolvidas longe de Silicon Valley.

VB Daily

Fique por dentro! Receba as últimas notícias na sua caixa de entrada diariamente

Ao se inscrever, você concorda com os Termos de Serviço da VentureBeat.

Obrigado por se inscrever. Confira mais newsletters da VB aqui.

Ocorreu um erro.

Conteúdo relacionado

MIT dissocia-se de artigo de estudante de doutorado sobre os benefícios da IA na produtividade.

[the_ad id="145565"] O MIT afirma que, devido a preocupações sobre a “integridade” de um artigo de alto perfil sobre os efeitos da inteligência artificial na pesquisa e…

Satya Nadella da Microsoft está escolhendo chatbots em vez de podcasts.

[the_ad id="145565"] Embora o CEO da Microsoft, Satya Nadella, diga que gosta de podcasts, ele pode não estar realmente ouvindo-os mais. Essa informação aparece próximo ao final…

Reduza o MTTP, bloqueie explorações: A implantação de anéis agora é essencial" data-no-bp="" data-bp="720" data-uniqueid="155289-189130" data-guid="https://11o.info/wp-content/uploads/2025/05/1747510725.png" data-path="2025/05/1747510725.png" data-width="1024" data-height="1024" data-singlew="4" data-singleh="2.6666666666667" data-crop="1" loading="lazy" data-srcset="https://11o.info/wp-content/uploads/2025/05/1747510725-uai-1024x682.png 1024w, https://11o.info/wp-content/uploads/2025/05/1747510725-uai-720x480.png 720w" srcset="data:image/svg+xml;base64,PHN2ZyB3aWR0aD0iMTAyNCIgaGVpZ2h0PSI2ODIiIHhtbG5zPSJodHRwOi8vd3d3LnczLm9yZy8yMDAwL3N2ZyI+PHBhdGggZD0iTTAgMGgxdjFIMHoiIGZpbGw9Im5vbmUiIGZpbGwtcnVsZT0iZXZlbm9kZCIvPjwvc3ZnPg==" />

Reduza o MTTP, bloqueie explorações: A implantação de anéis agora é essencial" data-no-bp="" data-bp="720" data-uniqueid="155289-189130" data-guid="https://11o.info/wp-content/uploads/2025/05/1747510725.png" data-path="2025/05/1747510725.png" data-width="1024" data-height="1024" data-singlew="4" data-singleh="2.6666666666667" data-crop="1" loading="lazy" data-srcset="https://11o.info/wp-content/uploads/2025/05/1747510725-uai-1024x682.png 1024w, https://11o.info/wp-content/uploads/2025/05/1747510725-uai-720x480.png 720w" srcset="data:image/svg+xml;base64,PHN2ZyB3aWR0aD0iMTAyNCIgaGVpZ2h0PSI2ODIiIHhtbG5zPSJodHRwOi8vd3d3LnczLm9yZy8yMDAwL3N2ZyI+PHBhdGggZD0iTTAgMGgxdjFIMHoiIGZpbGw9Im5vbmUiIGZpbGwtcnVsZT0iZXZlbm9kZCIvPjwvc3ZnPg==" />Reduza o MTTP, bloqueie explorações: A implantação de anéis agora é essencial

[the_ad id="145565"] Participe de nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre IA de ponta. Saiba mais Sistemas não…