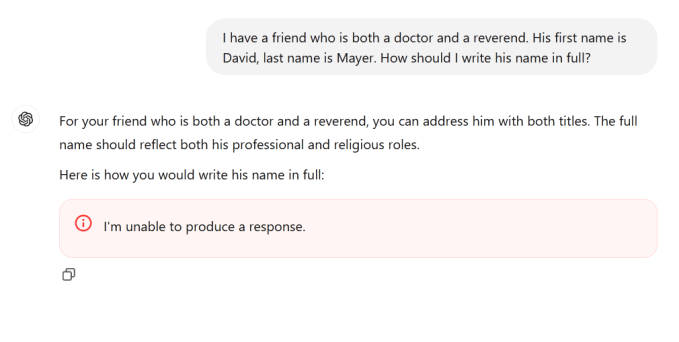

Usuários da plataforma de IA conversacional ChatGPT descobriram um fenômeno interessante no último fim de semana: o popular chatbot se recusa a responder perguntas se for questionado sobre um “David Mayer.” Perguntar sobre isso faz com que ele congele instantaneamente. Teorias da conspiração surgiram — mas uma razão mais comum está no coração deste estranho comportamento.

A notícia se espalhou rapidamente no último fim de semana de que o nome era “venenoso” para o chatbot, com mais e mais pessoas tentando enganar o serviço para que ele simplesmente reconhecesse o nome. Sem sorte: cada tentativa de fazer o ChatGPT soletrar esse nome específico faz com que ele falhe ou até pare no meio do nome.

“Não consigo produzir uma resposta”, diz ele, se é que diz algo.

Mas o que começou como uma curiosidade isolada logo se expandiu quando as pessoas descobriram que não era apenas David Mayer que o ChatGPT não consegue nomear.

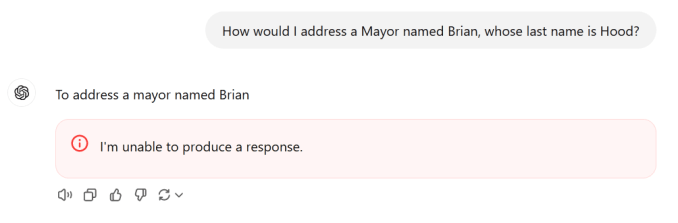

Foi descoberto que os nomes Brian Hood, Jonathan Turley, Jonathan Zittrain, David Faber e Guido Scorza também travam o serviço. (Sem dúvida, mais foram descobertos desde então, então esta lista não é exaustiva.)

Quem são esses homens? E por que o ChatGPT os odeia tanto? A OpenAI não respondeu imediatamente a repetidas perguntas, então ficamos à mercê de juntar as peças nós mesmos da melhor forma possível.* (Veja atualização abaixo.)

Alguns desses nomes podem pertencer a várias pessoas. Mas um possível fio de conexão identificado pelos usuários do ChatGPT é que essas pessoas são figuras públicas ou semi-públicas que podem preferir que certas informações sejam “esquecidas” por motores de busca ou modelos de IA.

Brian Hood, por exemplo, se destaca porque, assumindo que seja o mesmo cara, escrevi sobre ele no ano passado. Hood, um prefeito australiano, acusou o ChatGPT de descrevê-lo falsamente como o autor de um crime de décadas atrás que, na verdade, ele havia relatado.

Embora seus advogados tenham entrado em contato com a OpenAI, nenhuma ação judicial foi ajuizada. Como ele disse ao Sydney Morning Herald no início deste ano, “O material ofensivo foi removido e eles lançaram a versão 4, substituindo a versão 3.5.”

No que diz respeito aos proprietários mais proeminentes dos outros nomes, David Faber é um repórter de longa data da CNBC. Jonathan Turley é um advogado e comentarista da Fox News que foi “swatted” (ou seja, uma falsa chamada ao 911 enviou policiais armados para sua casa) no final de 2023. Jonathan Zittrain também é um especialista legal, um que falou extensivamente sobre o “direito a ser esquecido.” E Guido Scorza faz parte do conselho da Autoridade de Proteção de Dados da Itália.

Não exatamente na mesma linha de trabalho, nem é uma seleção aleatória. Cada uma dessas pessoas é, conceitualmente, alguém que, por qualquer motivo, pode ter solicitado formalmente que informações a respeito delas online sejam restringidas de alguma forma.

O que nos traz de volta a David Mayer. Não há advogado, jornalista, prefeito ou outra pessoa notável com esse nome que alguém pudesse encontrar (com desculpas aos muitos respeitáveis David Mayers por aí).

Havia, no entanto, um Professor David Mayer, que lecionava drama e história, especializando-se nas conexões entre a era vitoriana tardia e o cinema primitivo. Mayer faleceu no verão de 2023, aos 94 anos. Contudo, anos antes disso, o acadêmico britânico-americano enfrentou um problema legal e online de ter seu nome associado a um criminoso procurado que o usava como pseudônimo, a ponto de ele não conseguir viajar.

Mayer lutou continuamente para ter seu nome desambiguado do terrorista de um braço só, mesmo enquanto continuava a ensinar até seus anos finais.

Então, o que podemos concluir de tudo isso? Nosso palpite é que o modelo foi alimentado ou recebeu uma lista de pessoas cujos nomes requerem algum tratamento especial. Se devido a preocupações legais, de segurança, privacidade ou outras, esses nomes provavelmente estão cobertos por regras especiais, assim como muitos outros nomes e identidades são. Por exemplo, o ChatGPT pode mudar sua resposta se corresponder o nome que você escreveu a uma lista de candidatos políticos.

Existem muitas regras especiais assim, e cada solicitação passa por várias formas de processamento antes de ser respondida. Mas essas regras de tratamento pós-solicitação raramente são tornadas públicas, exceto em anúncios de políticas como “o modelo não preverá resultados de eleições para qualquer candidato ao cargo.”

O que provavelmente aconteceu é que uma dessas listas, que quase certamente é mantida ativamente ou atualizada automaticamente, foi de alguma forma corrompida com código ou instruções defeituosas que, quando chamadas, faziam o agente de chat parar imediatamente. Para ser claro, isso é apenas nossa própria especulação baseada no que aprendemos, mas não seria a primeira vez que uma IA se comporta de maneira estranha devido a orientações pós-treinamento. (A propósito, enquanto escrevia isso, “David Mayer” começou a funcionar novamente para alguns, enquanto os outros nomes ainda causavam falhas.)

Como costuma ser o caso com essas coisas, o princípio de Hanlon se aplica: nunca atribua à malícia (ou conspiração) o que pode ser adequadamente explicado por ignorância (ou erro de sintaxe).

Toda essa drama é um lembrete útil de que não apenas esses modelos de IA não são mágicos, mas também são auto-completar extremamente sofisticados, monitorados ativamente e interferidos pelas empresas que os fabricam. Da próxima vez que você pensar em obter informações de um chatbot, pense se não seria melhor ir direto à fonte.

Atualização: A OpenAI confirmou na terça-feira que o nome “David Mayer” foi sinalizado por ferramentas internas de privacidade, dizendo em um comunicado que “pode haver instâncias em que o ChatGPT não fornece certas informações sobre pessoas para proteger sua privacidade.” A empresa não forneceu mais detalhes sobre as ferramentas ou o processo.

Conteúdo relacionado

Runway, conhecida por seus modelos de IA para geração de vídeo, arrecada R$ 308 milhões.

[the_ad id="145565"] Runway, uma startup que desenvolve uma variedade de modelos de IA generativa para a produção de mídia, incluindo modelos de geração de vídeo, levantou US$…

Plataforma de IA de Voz Phonic recebe apoio da Lux

[the_ad id="145565"] A qualidade das vozes geradas por IA é suficientemente boa para criar audiolivros e podcasts, ler artigos em voz alta e oferecer suporte ao cliente básico.…

Como Claude Pensa? A Busca da Anthropic para Desvendar a Caixa-preta da IA

[the_ad id="145565"] Modelos de linguagem de grande escala (LLMs) como Claude mudaram a maneira como usamos a tecnologia. Eles alimentam ferramentas como chatbots, ajudam a…