À medida que as empresas passam de experiências limitadas em IA generativa para a implementação em produção, elas se tornam cada vez mais conscientes dos custos. Afinal, o uso de modelos de linguagem de grande porte (LLMs) não é barato. Uma maneira de reduzir despesas é retornar a um conceito antigo: o caching. Outra estratégia é direcionar consultas mais simples para modelos menores e mais econômicos. Na sua conferência re:Invent em Las Vegas, a AWS anunciou essas duas funcionalidades para seu serviço de hospedagem de LLM, Bedrock.

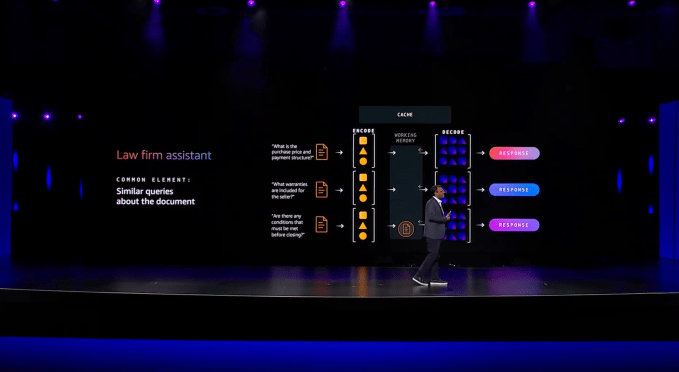

Vamos começar falando sobre o serviço de caching. “Imagine que existe um documento e várias pessoas fazendo perguntas sobre o mesmo documento. A cada vez, você está pagando,” afirmou Atul Deo, diretor de produto da Bedrock. “E essas janelas de contexto estão ficando cada vez maiores. Por exemplo, com o Nova, teremos 300k [tokens de] contexto e 2 milhões [tokens de] contexto. Acredito que, no próximo ano, isso pode aumentar ainda mais.”

O caching essencialmente garante que você não precise pagar pelo modelo para realizar trabalhos repetitivos e reprocessar as mesmas consultas (ou substancialmente semelhantes) repetidas vezes. De acordo com a AWS, isso pode reduzir os custos em até 90%, mas um efeito colateral adicional é que a latência para obter uma resposta do modelo é significativamente menor (a AWS afirma que pode ser uma redução de até 85%). A Adobe, que testou o caching de prompts para algumas de suas aplicações de IA generativa na Bedrock, viu uma redução de 72% no tempo de resposta.

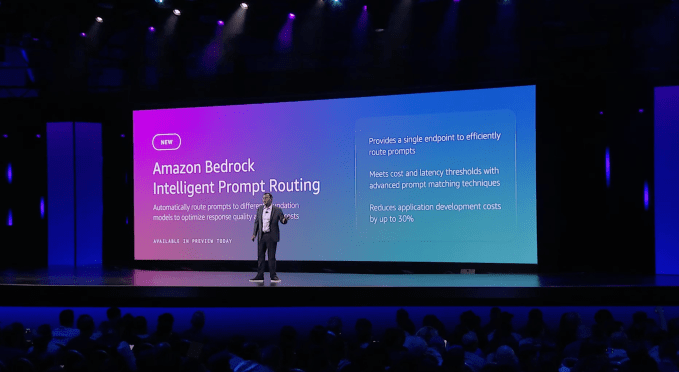

A outra grande novidade é o roteamento inteligente de prompts para a Bedrock. Com isso, a Bedrock pode automaticamente direcionar prompts para diferentes modelos na mesma família de modelos, ajudando as empresas a encontrar o equilíbrio certo entre desempenho e custo. O sistema prevê automaticamente (usando um pequeno modelo de linguagem) como cada modelo performará para uma consulta específica e, em seguida, roteia a solicitação de acordo.

“Às vezes, minha consulta pode ser muito simples. Eu realmente preciso enviar essa consulta para o modelo mais capaz, que é extremamente caro e lento? Provavelmente não. Então, basicamente, você quer criar essa noção de ‘Ei, em tempo de execução, com base no prompt de entrada, envie a consulta certa para o modelo certo’,” explicou Deo.

O roteamento de LLM não é um conceito novo, é claro. Startups como Martian e vários projetos de código aberto também abordam isso, mas a AWS provavelmente argumentaria que o que diferencia sua oferta é que o roteador pode direcionar consultas de forma inteligente sem muita intervenção humana. Mas também é limitado, na medida em que só pode roteizar consultas para modelos da mesma família. A longo prazo, no entanto, Deo me disse que a equipe planeja expandir esse sistema e oferecer aos usuários mais personalização.

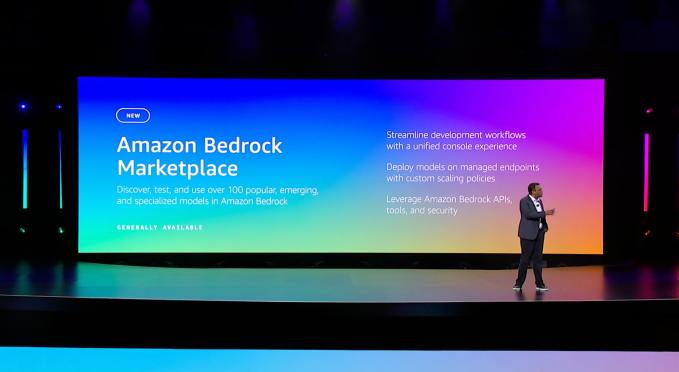

Por fim, a AWS também está lançando um novo marketplace para o Bedrock. A ideia aqui, disse Deo, é que, embora a Amazon esteja formando parcerias com muitos dos maiores fornecedores de modelos, agora existem centenas de modelos especializados que podem ter apenas alguns usuários dedicados. Como esses clientes estão pedindo à empresa para dar suporte a esses modelos, a AWS está lançando um marketplace para esses modelos, onde a única grande diferença é que os usuários terão que provisionar e gerenciar a capacidade de sua infraestrutura por conta própria — algo que a Bedrock geralmente faz automaticamente. No total, a AWS oferecerá cerca de 100 desses modelos emergentes e especializados, com mais vindo por aí.

Conteúdo relacionado

“Deep Think” aprimora o desempenho do modelo Google Gemini da Google.

[the_ad id="145565"] O Google está aprimorando seus modelos de IA mais avançados, o Gemini. Na terça-feira, durante o Google I/O 2025, a empresa anunciou o Deep Think, um modo…

A AMD revela novos CPUs Threadripper e GPUs Radeon para gamers na Computex 2025.

[the_ad id="145565"] Durante a Computex 2025, a Advanced Micro Devices realizou um evento de imprensa para apresentar suas placas de vídeo Radeon RX 9060 XT e os processadores…

Google’s NotebookLM Now Includes Video Overviews in Portuguese

[the_ad id="145565"] No Google I/O 2025, a gigante da tecnologia apresentou novas capacidades que chegarão ao NotebookLM, seu assistente de anotações e pesquisa baseado em IA.…