Apresentado pela Supermicro

A equipe da xAI, em parceria com a Supermicro e a NVIDIA, está construindo a maior implantação de cluster de GPU refrigerado a líquido do mundo. É um supercomputador de IA massivo que abrange mais de 100.000 GPUs NVIDIA HGX H100, exabytes de armazenamento e redes ultrarrápidas, tudo projetado para treinar e alimentar o Grok, um chatbot de IA generativa desenvolvido pela xAI.

A instalação de dados de bilhões de dólares, localizada em Memphis, TN, passou de um prédio vazio, sem geradores de energia, transformadores ou a estrutura de múltiplos corredores necessária, para um supercomputador de IA em apenas 122 dias. Para ajudar o mundo a entender a extraordinária conquista do cluster xAI Colossus, o VentureBeat tem o prazer de compartilhar este vídeo exclusivo e detalhado, possibilitado pela Supermicro e produzido pela ServeTheHome.

pic.twitter.com/eVdrVdi3b8 [pic.twitter.com]

— Supermicro (@Supermicro_SMCI)

25 de outubro de 2024

Aqui está um resumo dos destaques desse enorme empreendimento.

Dentro do hall de dados

Ao se propor a construir o maior supercomputador de IA, é evidente desde o início que uma quantidade imensa de poder computacional será necessária. Ele deve estar pronto para ser instalado e se tornar operacional no dia 1, e a solução geral precisará ser personalizada para os requisitos únicos da xAI.

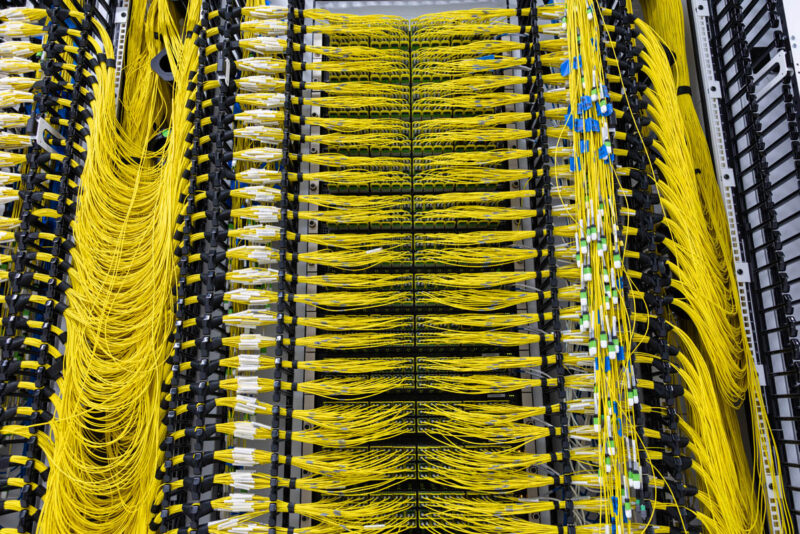

O design começa com um hall de dados de piso elevado bastante comum, com a energia localizada acima e tubulações de refrigeração líquida levando ao resfriador da instalação abaixo. Cada um dos quatro halls de computação possui cerca de 25.000 GPUs NVIDIA, além de todo o armazenamento, rede de fibra óptica de alta velocidade e energia embutida.

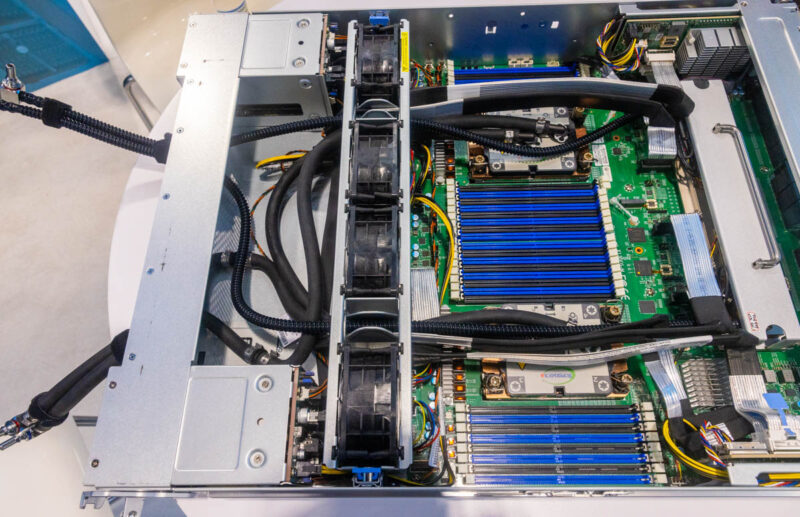

A partir daí, as coisas se tornam mais especializadas. Cada cluster contém o bloco básico de construção para o Colossus: o rack refrigerado a líquido da Supermicro. Cada rack contém oito sistemas GPU Universais 4U da Supermicro, que incluem GPUs refrigeradas a líquido NVIDIA HGX H100 de 8 GPUs e dois CPUs x86 refrigerados a líquido. Assim, cada rack contém 64 GPUs NVIDIA Hopper. Oito desses servidores GPU, além de uma unidade de distribuição de refrigerante (CDU) da Supermicro e coletores de refrigeração, compõem um dos racks. Os racks são organizados em grupos de oito com 512 GPUs, além de um rack de rede para fornecer miniclusters dentro do sistema muito maior.

Os Servidores Supermicro 4U Universais GPU Refrigerados a Líquido do Data Center xAI Colossus são os servidores de IA mais densos e avançados disponíveis hoje, com um sofisticado sistema de refrigeração líquida e a capacidade de serem atendidos sem remover os sistemas do rack.

Servidores e Design de Rack Refrigerados a Líquido de Próxima Geração

O manifold horizontal de distribuição de refrigerante (CDM) de 1U acima de cada servidor traz líquido refrigerado e transporta o líquido aquecido; desconexões rápidas fazem com que seja rápido e simples remover ou reinstalar o equipamento de refrigeração líquida com uma mão para revelar as duas bandejas inferiores. O rack apresenta oito dos Sistemas Universais GPU 4U da Supermicro para NVIDIA HGX H100 e HGX H200 Tensor Core GPUs. Cada bandeja superior do sistema contém o complexo de 8 GPUs NVIDIA HGX H100 e as placas frias na placa NVIDIA HGX para resfriar as GPUs. A bandeja inferior contém a placa-mãe, CPU, RAM e switches PCIe, além das placas frias nos CPUs de soquete duplo.

De forma única, a placa-mãe da Supermicro na bandeja inferior integra os quatro switches PCIe da Broadcom usados em quase todos os servidores NVIDIA HGX hoje no lado direito da placa, em vez de colocá-los em uma placa separada. E ao contrário de outros servidores de IA da indústria, que adicionam refrigeração líquida a um design refrigerado a ar após a fabricação, os servidores da Supermicro são projetados desde o início para serem refrigerados a líquido com um bloco de refrigeração líquida personalizado. Esse tipo de potência compacta, acessibilidade e facilidade de manutenção torna esses sistemas incrivelmente escaláveis e distingue a Supermicro na indústria.

Além disso, cada uma das CDUs possui seu próprio sistema de monitoramento para acompanhar o fluxo de líquido, temperatura e outras funções críticas, que se conectam à interface de gerenciamento central. Cada CDU possui bombas e fontes de energia redundantes para que, caso uma falhe, possa ser atendida ou substituída em minutos, sem interromper o sistema em funcionamento.

Os servidores da Supermicro ainda utilizam ventoinhas do sistema para resfriar componentes como DIMMs, fontes de energia, controladores de gerenciamento de base de baixa potência, NICs e outros eletrônicos. Para manter cada rack com resfriamento neutro, as ventoinhas do servidor puxam ar mais frio da frente e expelem o ar mais quente através de trocadores de calor com portas traseiras refrigeradas a líquido. O excesso de calor é removido tanto dos servidores de GPU refrigerados a líquido da Supermicro quanto do armazenamento, clusters de computação da CPU e componentes de rede. A quantidade de energia que as ventoinhas consomem é bastante reduzida em comparação com um servidor refrigerado a ar, resultando em menor consumo de energia para cada servidor.

Rede do Colossus

As redes gigantescas do data center funcionam na plataforma de rede Ethernet NVIDIA Spectrum-X, e estão sendo utilizadas para escalar seus massivos clusters de IA a um nível que nenhuma outra tecnologia pode alcançar. Spectrum-X é uma plataforma de rede de ponta que fornece transferência de dados rápida e confiável, projetada para atender às altas demandas das cargas de trabalho de IA. Oferece recursos como roteamento mais inteligente de dados, redução de atrasos e melhor controle do tráfego de rede. Inclui também visibilidade e monitoramento aprimorados da malha de IA, tornando-a ideal para grandes projetos de IA em ambientes de infraestrutura compartilhada.

Cada cluster utiliza os SuperNICs NVIDIA Bluefield-3, que fornecem conectividade de rede de 400 gigabits por segundo. É a mesma tecnologia básica que qualquer cabo ethernet de desktop utiliza, mas no data center, é 400GbE, ou 400 vezes mais rápido por conexão óptica. Nove links por sistema oferecem 3,6Tbps de largura de banda por servidor de computação GPU. A RDMA (Acesso Direto à Memória Remota) para as GPUs compõe a maior parte dessa largura de banda. Cada GPU é pareada com seu próprio SuperNIC BlueField-3 da NVIDIA e tecnologia de rede Spectrum-X.

Além da rede RDMA para GPUs, os CPUs também obtêm uma conexão de 400GbE, que utiliza um fabric de switch totalmente diferente. A xAI está executando uma rede para suas GPUs e outra para o restante do cluster, que é um ponto de design muito comum em clusters de computação de alto desempenho.

O NVIDIA Spectrum SN5600, um switch ethernet de 64 portas de 800Gb, pode dividir e executar 128 links de ethernet de 400 gigabits para garantir que as GPUs NVIDIA e todo o cluster funcionem e escalem em níveis de desempenho máximos. Ele pode descarregar vários protocolos de segurança, usa gerenciamento de fluxo avançado para evitar congestionamentos na rede e gerencia todas as tarefas de supercomputador da CPU no cluster, em uma das primeiras implantações desse tipo de switch no mundo.

No total, essa enorme empreitada supera em escala qualquer supercomputador já tentado anteriormente. Estamos ansiosos para ver a xAI, juntamente com a Supermicro e a NVIDIA, continuarem a ultrapassar limites ainda mais longe em uma nova era de supercomputação.

Veja de perto o Colossus! Não perca o passe em vídeo detalhado acima.

Artigos patrocinados são conteúdos produzidos por uma empresa que está pagando pelo post ou tem uma relação comercial com o VentureBeat, e são sempre claramente marcados. Para mais informações, entre em contato com sales@venturebeat.com.

Conteúdo relacionado

Aprenda como a Toyota e a NLX se uniram com sucesso na TC Sessions: IA

[the_ad id="145565"] Estamos a apenas dois dias do TechCrunch Sessions: AI, que reúne a comunidade de IA no Zellerbach Hall da UC Berkeley, na quinta-feira, 5 de junho! Espere…

Fabricantes de automóveis e chips formam grupo para desenvolver conectividade interna aberta em veículos

[the_ad id="145565"] Fabricantes de automóveis, fornecedores, fabricantes de semicondutores e parceiros do ecossistema anunciaram a formação da Associação OpenGMSL, uma…

DeepSeek pode ter usado o Gemini do Google para treinar seu mais recente modelo.

[the_ad id="145565"] Na semana passada, o laboratório chinês DeepSeek lançou uma versão atualizada de seu modelo de IA de raciocínio R1, que se apresenta bem em vários…