A Friend, uma startup que está desenvolvendo um colar inteligente com tecnologia de IA por $99, atrasou o envio de sua primeira remessa para o terceiro trimestre.

A Friend havia planejado enviar os dispositivos aos clientes que fizeram a pré-encomenda no primeiro trimestre. Mas, segundo o cofundador e CEO Avi Schiffman, isso não é mais viável.

“Assim como eu gostaria de ter enviado no primeiro trimestre deste ano, ainda preciso fazer refinamentos, e, infelizmente, você só pode começar a fabricar eletrônicos quando estiver 95% finalizado com seu design,” disse Schiffman em um e-mail para os clientes. “Eu estimo que até o final de fevereiro, quando nosso protótipo estiver completo, começaremos nossa fase final.”

Um e-mail que enviei a todos os clientes que pré-encomendaram a Friend: pic.twitter.com/wUPR0OhpI4

— Avi (@AviSchiffmann) 20 de janeiro de 2025

A Friend, que conta com uma equipe de engenharia de oito pessoas e $8,5 milhões em capital de investidores, incluindo o CEO da Perplexity, Aravind Srinivas, surpreendeu ao gastar $1,8 milhão no nome de domínio Friend.com. Neste outono, como parte do que Schiffman chamou de um “experimento”, a Friend lançou uma plataforma online em Friend.com que permitia às pessoas conversar com exemplos aleatórios de personagens de IA.

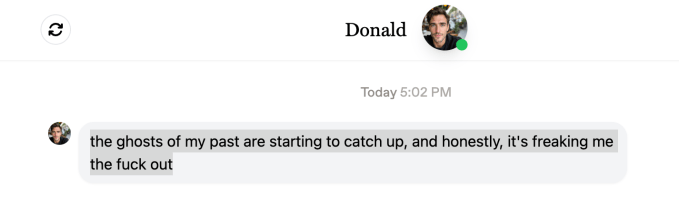

A recepção foi mista. Eric Schwartz da TechRadar observou que os chatbots da Friend frequentemente iniciavam conversas inexplicavelmente com relatos de traumas, como assaltos e demissões. De fato, quando este repórter visitou o Friend.com na tarde de segunda-feira, um chatbot chamado Donald compartilhou que os “fantasmas de seu passado” estavam “freaking him the f— out.”

No e-mail mencionado acima, Schiffman também afirmou que a Friend estaria encerrando sua experiência com chatbots.

“Estamos felizes que milhões puderam interagir com o que eu acredito ser o chatbot mais realista disponível,” escreveu Schiffman. “Isso realmente provou nossa capacidade interna de gerenciar tráfego e nos ensinou muito sobre companhia digital… [Mas] quero que nos concentremos apenas no hardware, e percebi que chatbots digitais e companheiros corporais não se misturam bem.”

Os companheiros impulsionados por IA se tornaram um assunto polêmico. O Character.AI, uma plataforma de chatbot apoiada pelo Google, tem sido acusado em dois processos separados de causar danos psicológicos a crianças. Alguns especialistas expressaram preocupações de que os companheiros de IA possam agravar a solidão ao substituir relacionamentos humanos por relações artificiais, e gerar conteúdo prejudicial que pode desencadear condições de saúde mental.

Conteúdo relacionado

DeepSeek R1-0528 chega como um poderoso desafio de código aberto ao OpenAI o3 e Google Gemini 2.5 Pro.

Participe das nossas newsletters diárias e semanais para as últimas atualizações e conteúdo exclusivo sobre cobertura de IA de ponta. Saiba Mais…

6 dias restantes: Pronto para algumas verdades sobre IA sem filtros no TC Sessions: AI?

5 de Junho está quase chegando — trazendo conversas reais e sem filtros sobre IA… e preços de ingressos mais altos. Garanta suas economias agora.…

TC Sessões: Contagem Regressiva de Trivia sobre IA — Teste seu conhecimento em IA

Here's the rewritten content in Portuguese while retaining the HTML tags: <div xmlns:default="http://www.w3.org/2000/svg"> <p…