O CEO da OpenAI, Sam Altman, começou o ano afirmando em um post no blog que 2025 seria um grande ano para agentes de IA, ferramentas que podem automatizar tarefas e tomar ações em seu nome.

Agora, estamos vendo a primeira tentativa real da OpenAI.

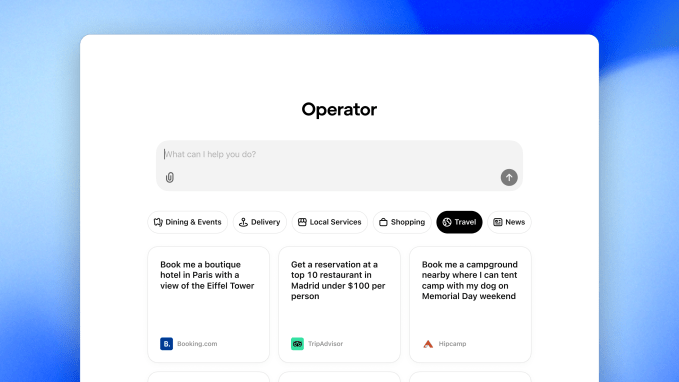

Na quinta-feira, a OpenAI anunciou o lançamento de uma prévia de pesquisa do Operator, um agente de IA de propósito geral que pode controlar um navegador da web e realizar certas ações de forma independente. O Operator está sendo disponibilizado primeiro para usuários nos EUA no plano de assinatura Pro de $200 do ChatGPT. A OpenAI afirma que planeja lançar esse recurso para mais usuários em suas camadas Plus, Team e Enterprise eventualmente.

“[Operador] estará em outros países em breve,” disse Sam Altman, CEO da OpenAI, durante uma transmissão ao vivo na quinta-feira. “A Europa, infelizmente, levará mais tempo.”

Esta prévia de pesquisa inicial está disponível através de operator.chatgpt.com, mas em breve, a OpenAI diz que deseja integrar o Operator em todos os seus clientes ChatGPT.

O Operator promete automatizar tarefas como agendar acomodações de viagem, fazer reservas em restaurantes e realizar compras online, segundo a OpenAI. Existem várias categorias de tarefas que os usuários podem escolher dentro da interface do Operator, incluindo compras, entrega, refeições e viagens — todas as quais habilitam diferentes tipos de automação.

Quando os usuários do ChatGPT ativam o Operator, uma pequena janela aparecerá mostrando um navegador da web dedicado que o agente usa para completar tarefas, juntamente com explicações das ações específicas que o agente está realizando. Os usuários ainda podem controlar sua tela enquanto o Operator está trabalhando, já que o Operator utiliza seu próprio navegador dedicado.

A OpenAI afirma que o Operator é alimentado por um modelo de Agente Usando Computador, ou CUA, que combina as capacidades de visão do modelo GPT-4o da empresa com habilidades de raciocínio de modelos mais avançados da OpenAI. O CUA é treinado para interagir com o front-end de sites, o que significa que não precisa usar APIs voltadas para desenvolvedores para acessar diferentes serviços.

Em outras palavras, o CUA pode usar botões, navegar em menus e preencher formulários em uma página da web assim como um humano faria.

A OpenAI afirma que está colaborando com empresas como DoorDash, eBay, Instacart, Priceline, StubHub e Uber para garantir que o Operator respeite os acordos de termos de serviço dessas empresas.

“O modelo CUA é treinado para pedir confirmação do usuário antes de finalizar tarefas com efeitos colaterais externos, por exemplo, antes de enviar um pedido, enviar um e-mail, etc., para que o usuário possa verificar o trabalho do modelo antes que ele se torne permanente,” escreve a OpenAI em materiais fornecidos ao TechCrunch. “[Ele] já provou ser útil em uma variedade de casos, e temos como objetivo estender essa confiabilidade em uma gama mais ampla de tarefas.”

Mas a OpenAI alerta que o CUA não é perfeito. A empresa afirma que “[não espera que o] CUA funcione de maneira confiável em todos os cenários neste momento.”

“Atualmente, o Operator não pode lidar de forma confiável com muitas tarefas complexas ou especializadas,” adiciona a OpenAI em um documento de suporte, “como criar apresentações detalhadas, gerenciar sistemas de calendário intrincados ou interagir com interfaces web altamente personalizadas ou não padrão.

Por uma questão de prudência, a OpenAI também está exigindo supervisão para algumas tarefas, como transações bancárias, que o CUA e o Operator poderiam realizar principalmente por conta própria. Os usuários precisarão intervir para inserir informações do cartão de crédito, por exemplo. A OpenAI afirma que o Operator não coleta ou faz captura de tela de nenhum dado.

“Em sites particularmente sensíveis, como e-mail, o Operator requer supervisão ativa do usuário, garantindo que os usuários possam detectar e corrigir diretamente quaisquer possíveis erros que o modelo possa cometer,” afirma a OpenAI em seus materiais de suporte.

Isso, sem dúvida, limita a utilidade do Operator — mas também garante que o agente não “alucine” e, por exemplo, gaste seu pagamento da hipoteca em cadeiras de acento. O Google tomou uma abordagem semelhante com seu agente de IA Project Mariner, que também não preenche informações como números de cartão de crédito.

Limitações

O Operator tem algumas limitações que merecem destaque.

Existem limites de taxa — tanto diários quanto dependentes da tarefa. A OpenAI afirma que o Operator pode realizar várias tarefas ao mesmo tempo, mas que existem “limites dinâmicos” sobre isso. Também há um limite de uso geral que se reinicia diariamente.

Neste estágio de lançamento, o Operator também se recusará a realizar tarefas diretamente por razões de segurança, como enviar e-mails (apesar do fato de que o CUA é capaz disso) e excluir eventos do calendário. A OpenAI afirma que isso mudará no futuro, mas não divulga um prazo.

O Operator também pode “ficar preso” se encontrar uma interface particularmente complexa, um campo de senha ou uma verificação de CAPTCHA. Ele pedirá ao usuário para intervir quando isso ocorrer, afirma a OpenAI.

Um futuro agente

A OpenAI tem avançado lentamente no desenvolvimento de um agente de IA em comparação com seus rivais (veja: agentes da Rabbit, Google e Anthropic), o que pode ter relação com os riscos de segurança em torno da tecnologia.

Quando um sistema de IA pode realizar ações na web, ele abre a porta para casos de uso muito mais perigosos por parte de pessoas mal-intencionadas. Você poderia automatizar agentes de IA para orquestrar golpes de phishing ou ataques DDoS, ou fazê-los garantir ingressos para um show antes que qualquer outra pessoa pudesse. Especialmente para uma ferramenta tão amplamente utilizada quanto o ChatGPT, é importante que a OpenAI tome medidas para prevenir esse tipo de exploração.

Parece que a OpenAI acredita que o Operator é seguro o suficiente para ser lançado em sua forma atual, pelo menos como uma prévia de pesquisa.

“O Operator emprega ferramentas que buscam limitar a suscetibilidade do modelo a prompts maliciosos, instruções ocultas e tentativas de phishing,” explica a OpenAI em seu site. “Um sistema de monitoramento pausa a execução se atividade suspeita for detectada, enquanto pipelines automatizados e revisados por humanos atualizam continuamente as salvaguardas.”

O Operator é a tentativa mais ousada da OpenAI até agora de criar um agente de IA. Na semana passada, a OpenAI lançou Tarefas, oferecendo ao ChatGPT recursos simples de automação, como a capacidade de definir lembretes e agendar prompts para serem executados em um determinado horário todos os dias.

As Tarefas deram aos usuários do ChatGPT algumas funcionalidades familiares, mas necessárias, para tornar o ChatGPT tão prático quanto Siri ou Alexa. No entanto, o Operator exibe capacidades que a geração anterior de assistentes virtuais nunca poderia realizar.

Os agentes de IA foram apresentados como a próxima grande novidade na IA após o ChatGPT: uma nova tecnologia que mudará a forma como as pessoas usam a internet e seus PCs. Em vez de simplesmente apresentar e processar informações, os agentes podem — em teoria — tomar ações e realmente fazer coisas.

Com o lançamento da primeira abordagem concreta da OpenAI sobre agentes, logo ficará claro quão realista essa visão é.

Conteúdo relacionado

ChatGPT se refere a usuários pelo nome sem solicitação, e alguns acham isso ‘estranho’

[the_ad id="145565"] Alguns usuários do ChatGPT notaram um fenômeno estranho recentemente: O chatbot ocasionalmente se refere a eles pelo nome enquanto raciocina sobre…

De ‘acompanhar’ a ‘nos acompanhar’: Como o Google silenciosamente assumiu a liderança em IA empresarial.

[the_ad id="145565"] Participe de nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA de ponta. Saiba Mais Há…

Tudo o que você precisa saber sobre o chatbot de IA

[the_ad id="145565"] O ChatGPT, o chatbot de IA geradora de texto da OpenAI, conquistou o mundo desde seu lançamento em novembro de 2022. O que começou como uma ferramenta para…