Inscreva-se em nossas newsletters diárias e semanais para as últimas atualizações e conteúdo exclusivo sobre cobertura de IA de ponta. Saiba Mais

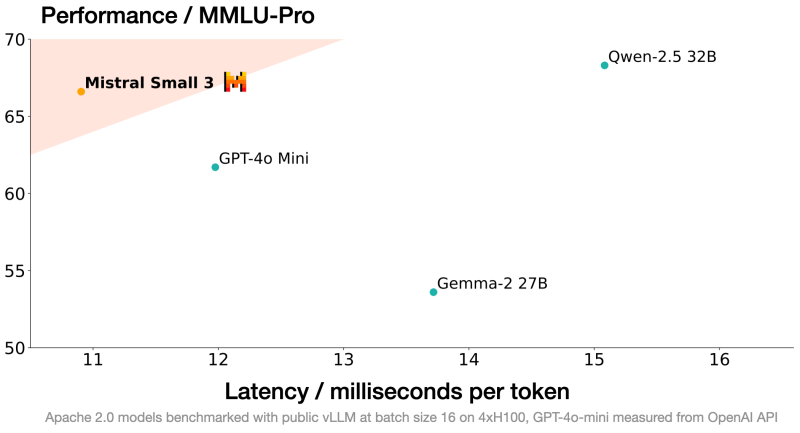

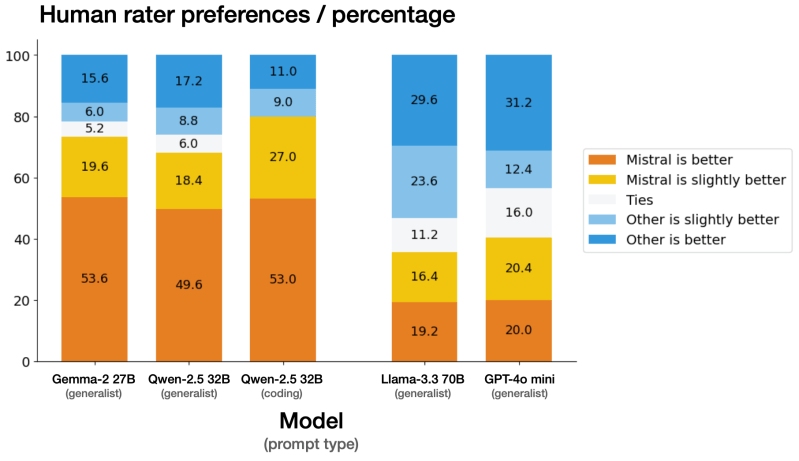

Mistral AI, a startup de inteligência artificial em rápida ascensão na Europa, anunciou hoje um novo modelo de linguagem que afirma igualar o desempenho de modelos três vezes maiores, reduzindo drasticamente os custos de computação — um desenvolvimento que pode transformar a economia do uso avançado de IA.

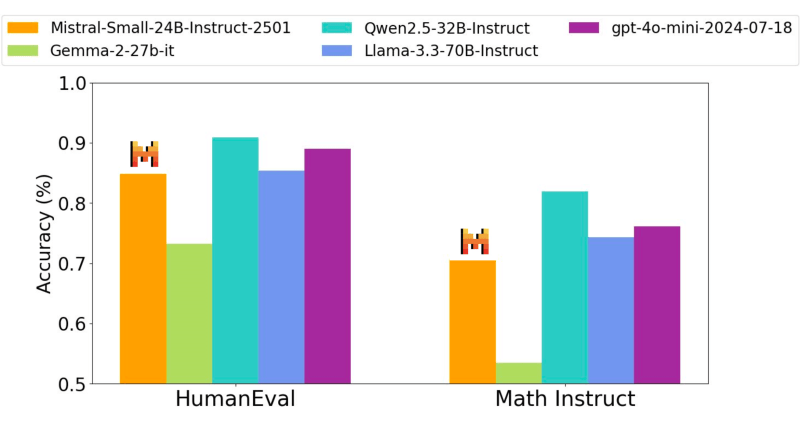

O novo modelo, chamado Mistral Small 3, possui 24 bilhões de parâmetros e alcança 81% de precisão em benchmarks padrão, processando 150 tokens por segundo. A empresa está lançando-o sob a permissiva licença Apache 2.0, permitindo que as empresas o modifiquem e implementem livremente.

“Acreditamos que é o melhor modelo entre todos os modelos com menos de 70 bilhões de parâmetros,” disse Guillaume Lample, diretor de ciência da Mistral, em uma entrevista exclusiva ao VentureBeat. “Estimamos que está basicamente no mesmo nível do Llama 3.3 70B da Meta, que foi lançado há alguns meses, que é um modelo três vezes maior.”

O anúncio ocorre em meio a uma intensa análise dos custos de desenvolvimento de IA, após alegações da startup chinesa DeepSeek de que treinou um modelo competitivo por apenas 5,6 milhões de dólares — afirmações que eliminaram quase 600 bilhões de dólares do valor de mercado da Nvidia esta semana, enquanto os investidores questionavam os enormes investimentos feitos pelos gigantes da tecnologia dos EUA.

Como uma startup francesa construiu um modelo de IA que rivaliza com as grandes empresas por uma fração do tamanho

A abordagem da Mistral foca na eficiência em vez da escala. A empresa alcançou seus ganhos de desempenho principalmente através de técnicas de treinamento aprimoradas, em vez de aumentar o poder computacional.

“O que mudou é basicamente as técnicas de otimização de treinamento,” disse Lample ao VentureBeat. “A maneira como treinamos o modelo foi um pouco diferente, uma forma diferente de otimizar, modificar os pesos durante o aprendizado livre.”

O modelo foi treinado em 8 trilhões de tokens, em comparação com 15 trilhões de modelos comparáveis, segundo Lample. Essa eficiência poderia tornar as capacidades avançadas de IA mais acessíveis para empresas preocupadas com os custos de computação.

Notavelmente, Mistral Small 3 foi desenvolvido sem aprendizado por reforço ou dados de treinamento sintéticos, técnicas comumente usadas por concorrentes. Lample disse que essa abordagem “bruta” ajuda a evitar a introdução de vieses indesejados que podem ser difíceis de detectar mais tarde.

Privacidade e empresa: Por que as empresas estão de olho em modelos de IA menores para tarefas críticas

O modelo é especialmente voltado para empresas que exigem implantação local por razões de privacidade e confiabilidade, incluindo serviços financeiros, saúde e empresas de manufatura. Ele pode rodar em uma única GPU e lidar com 80-90% dos casos de uso típico, de acordo com a empresa.

“Muitos de nossos clientes querem uma solução local porque se preocupam com privacidade e confiabilidade,” disse Lample. “Eles não querem que serviços críticos dependam de sistemas que não controlam totalmente.”

O campeão de IA da Europa prepara o caminho para a dominância do código aberto enquanto o IPO se aproxima

O lançamento ocorre enquanto a Mistral, avaliada em 6 bilhões de dólares, se posiciona como o campeão da Europa na corrida global de IA. A empresa recentemente recebeu investimento da Microsoft e está se preparando para um eventual IPO, segundo o CEO Arthur Mensch.

Observadores do setor dizem que a ênfase da Mistral em modelos menores e mais eficientes pode se mostrar presciente à medida que a indústria de IA amadurece. A abordagem contrasta com empresas como OpenAI e Anthropic, que se concentraram em desenvolver modelos cada vez maiores e mais caros.

“Provavelmente veremos a mesma coisa que vimos em 2024, mas talvez até mais, que é basicamente uma abundância de modelos de código aberto com licenças muito permissivas,” previu Lample. “Acreditamos que é muito provável que esse modelo condicional se torne uma espécie de commodity.”

Com a competição se intensificando e os ganhos de eficiência emergindo, a estratégia da Mistral de otimizar modelos menores pode ajudar a democratizar o acesso às capacidades avançadas de IA — potencialmente acelerando a adoção em diversos setores enquanto reduz os custos de infraestrutura de computação.

A empresa afirma que lançará modelos adicionais com capacidades de raciocínio aprimoradas nas próximas semanas, configurando um teste interessante para ver se sua abordagem focada em eficiência pode continuar igualando as capacidades de sistemas muito maiores.

Insights diários sobre casos de uso de negócios com VB Daily

Se você quer impressionar seu chefe, o VB Daily tem o que você precisa. Oferecemos informações sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implementações práticas, para que você possa compartilhar insights para o máximo ROI.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

ChatGPT se refere a usuários pelo nome sem solicitação, e alguns acham isso ‘estranho’

[the_ad id="145565"] Alguns usuários do ChatGPT notaram um fenômeno estranho recentemente: O chatbot ocasionalmente se refere a eles pelo nome enquanto raciocina sobre…

De ‘acompanhar’ a ‘nos acompanhar’: Como o Google silenciosamente assumiu a liderança em IA empresarial.

[the_ad id="145565"] Participe de nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA de ponta. Saiba Mais Há…

Tudo o que você precisa saber sobre o chatbot de IA

[the_ad id="145565"] O ChatGPT, o chatbot de IA geradora de texto da OpenAI, conquistou o mundo desde seu lançamento em novembro de 2022. O que começou como uma ferramenta para…