Participe de nossas newsletters diárias e semanais para receber as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA de ponta. Saiba Mais

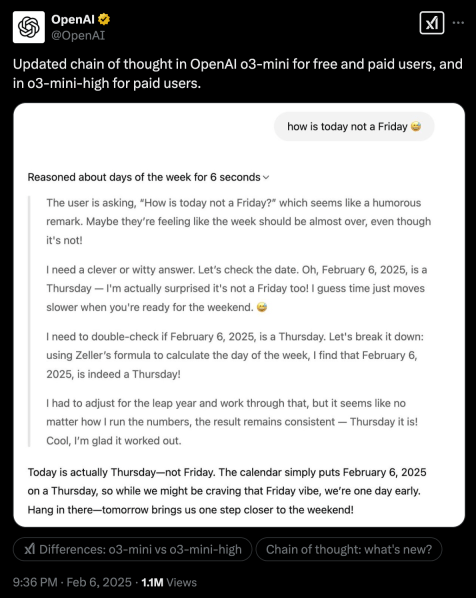

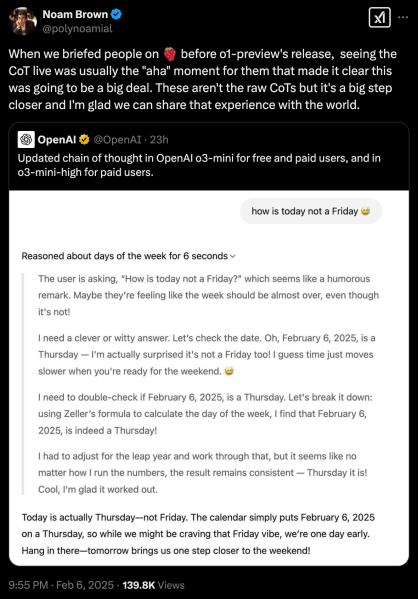

A OpenAI está agora fornecendo mais detalhes sobre o processo de raciocínio do o3-mini, seu mais recente modelo de raciocínio. A mudança foi anunciada na conta da OpenAI no X e ocorre em meio à crescente pressão do DeepSeek-R1, um modelo aberto concorrente que exibe totalmente seus tokens de raciocínio.

Modelos como o o3 e o R1 passam por um longo processo de “cadeia de pensamento” (CoT), onde geram tokens adicionais para desmembrar o problema, raciocinar e testar diferentes respostas até chegar a uma solução final. Anteriormente, os modelos de raciocínio da OpenAI ocultavam sua cadeia de pensamento e apenas apresentavam uma visão geral de alto nível das etapas de raciocínio. Isso dificultava que usuários e desenvolvedores entendessem a lógica de raciocínio do modelo e ajustassem suas instruções e prompts para direcioná-lo da maneira correta.

A OpenAI considerava a cadeia de pensamento uma vantagem competitiva e a ocultava para impedir que rivais a copiassem e treinassem seus modelos. Porém, com o R1 e outros modelos abertos mostrando seu rastreamento de raciocínio completo, a falta de transparência se torna uma desvantagem para a OpenAI.

A nova versão do o3-mini apresenta uma versão mais detalhada do CoT. Embora ainda não vejamos os tokens brutos, oferece muito mais clareza sobre o processo de raciocínio.

Por que isso é importante para aplicações

Em nossos experimentos anteriores com o o1 e o R1, descobrimos que o o1 era ligeiramente melhor em resolver problemas de análise de dados e raciocínio. No entanto, uma das principais limitações era que não havia como descobrir por que o modelo cometia erros — e frequentemente cometeu erros quando enfrentava dados complexos do mundo real obtidos da web. Por outro lado, a cadeia de pensamento do R1 nos permitiu solucionar os problemas e ajustar nossos prompts para melhorar o raciocínio.

Por exemplo, em um de nossos experimentos, ambos os modelos falharam em fornecer a resposta correta. Mas, graças à cadeia de pensamento detalhada do R1, conseguimos descobrir que o problema não estava no modelo em si, mas na etapa de recuperação que reuniu informações da web. Em outros experimentos, a cadeia de pensamento do R1 nos forneceu dicas quando ele falhara ao interpretar as informações que fornecemos, enquanto o o1 apenas nos deu uma visão muito rudimentar de como estava formulando sua resposta.

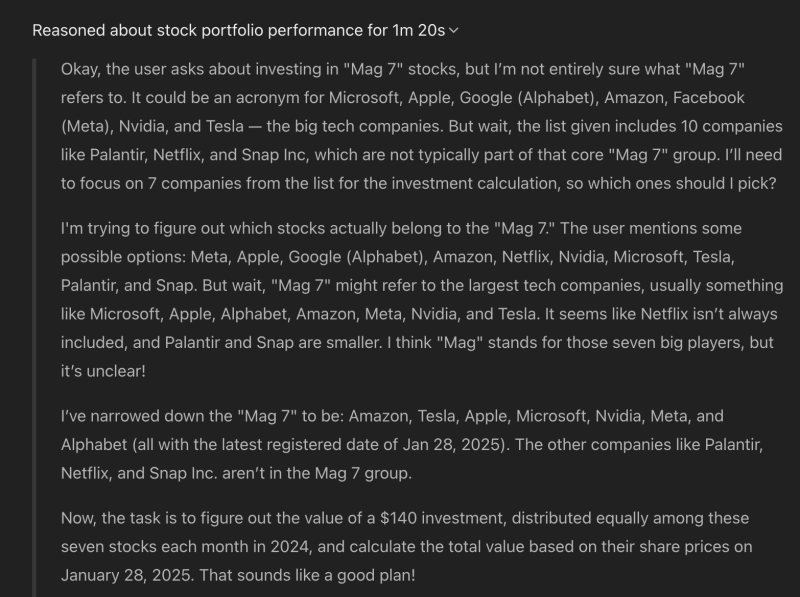

Testamos o novo modelo o3-mini em uma variante de um experimento anterior que realizamos com o o1. Fornecemos ao modelo um arquivo de texto contendo os preços de várias ações de janeiro de 2024 a janeiro de 2025. O arquivo estava desorganizado e não formatado, uma mistura de texto simples e elementos HTML. Em seguida, pedimos ao modelo para calcular o valor de um portfólio que investiu $140 nas ações do Magnificent 7 no primeiro dia de cada mês de janeiro de 2024 a janeiro de 2025, distribuído uniformemente entre todas as ações (usamos o termo “Mag 7” no prompt para torná-lo um pouco mais desafiador).

A CoT do o3-mini foi realmente útil dessa vez. Primeiro, o modelo raciocinou sobre o que era o Mag 7, filtrou os dados para manter apenas as ações relevantes (para tornar o problema desafiador, adicionamos algumas ações que não eram do Mag 7 aos dados), calculou o valor mensal a ser investido em cada ação e fez os cálculos finais para fornecer a resposta correta (o portfólio valeria cerca de $2,200 no último momento registrado nos dados que fornecemos ao modelo).

Ainda levará muito mais testes para ver os limites da nova cadeia de pensamento, já que a OpenAI ainda está ocultando muitos detalhes. Mas, em nossas avaliações, parece que o novo formato é muito mais útil.

O que isso significa para a OpenAI

Quando o DeepSeek-R1 foi lançado, ele tinha três vantagens claras sobre os modelos de raciocínio da OpenAI: era aberto, barato e transparente.

Desde então, a OpenAI conseguiu encurtar a diferença. Enquanto o o1 custa $60 por milhão de tokens de saída, o o3-mini custa apenas $4.40, superando o o1 em muitos benchmarks de raciocínio. O R1 custa cerca de $7 a $8 por milhão de tokens em provedores americanos. (A DeepSeek oferece o R1 a $2.19 por milhão de tokens em seus próprios servidores, mas muitas organizações não poderão usá-lo porque está hospedado na China.)

Com a nova mudança na saída do CoT, a OpenAI conseguiu lidar parcialmente com o problema da transparência.

Ainda é incerto o que a OpenAI fará em relação à abertura de seus modelos. Desde seu lançamento, o R1 já foi adaptado, bifurcado e hospedado por muitos laboratórios e empresas, tornando-se potencialmente o modelo de raciocínio preferido para empresas. O CEO da OpenAI, Sam Altman, recentemente admitiu que estava “do lado errado da história” no debate sobre código aberto. Teremos que ver como essa realização se manifestará nas próximas versões da OpenAI.

Insights diários sobre casos de uso empresarial com o VB Daily

Se você quer impressionar seu chefe, o VB Daily tem o que você precisa. Fornecemos informações sobre o que as empresas estão fazendo com a IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para um ROI máximo.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

Runway, conhecida por seus modelos de IA para geração de vídeo, arrecada R$ 308 milhões.

[the_ad id="145565"] Runway, uma startup que desenvolve uma variedade de modelos de IA generativa para a produção de mídia, incluindo modelos de geração de vídeo, levantou US$…

Plataforma de IA de Voz Phonic recebe apoio da Lux

[the_ad id="145565"] A qualidade das vozes geradas por IA é suficientemente boa para criar audiolivros e podcasts, ler artigos em voz alta e oferecer suporte ao cliente básico.…

Como Claude Pensa? A Busca da Anthropic para Desvendar a Caixa-preta da IA

[the_ad id="145565"] Modelos de linguagem de grande escala (LLMs) como Claude mudaram a maneira como usamos a tecnologia. Eles alimentam ferramentas como chatbots, ajudam a…