O ChatGPT, a plataforma de chatbot da OpenAI, pode não ser tão exigente em termos de energia quanto se pensava anteriormente. No entanto, sua demanda depende em grande medida de como o ChatGPT está sendo utilizado e dos modelos de IA que estão respondendo às consultas, de acordo com um novo estudo.

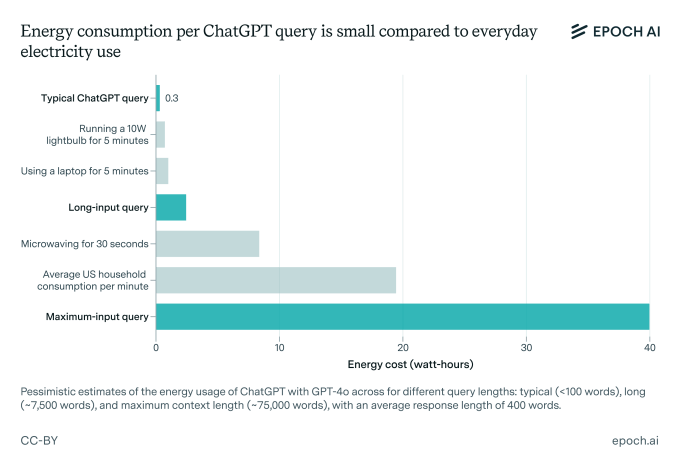

Uma análise recente da Epoch AI, um instituto de pesquisa em IA sem fins lucrativos, tentou calcular quanta energia um query típica do ChatGPT consome. Um dado frequentemente citado é que o ChatGPT requer cerca de 3 watt-horas de energia para responder a uma única pergunta, ou dez vezes mais do que uma pesquisa no Google.

A Epoch acredita que essa estimativa é exagerada.

Usando o modelo padrão mais recente do ChatGPT, o GPT-4o, como referência, a Epoch descobriu que a média de consumo de energia de uma consulta do ChatGPT é de cerca de 0,3 watt-horas — menos do que muitos aparelhos eletrodomésticos.

“O uso de energia realmente não é um grande problema comparado ao uso de eletrodomésticos normais, aquecimento ou resfriamento de sua casa, ou dirigir um carro,” disse Joshua You, o analista de dados da Epoch que conduziu a análise, ao TechCrunch.

O uso de energia pela IA — e seu impacto ambiental, de modo geral — é um tema de debate contencioso à medida que as empresas de IA buscam expandir rapidamente sua infraestrutura. Na semana passada, um grupo de mais de 100 organizações publicou uma carta aberta pedindo à indústria de IA e aos reguladores que se certifiquem de que os novos centros de dados de IA não esgotem os recursos naturais e forcem as utilities a dependerem de fontes não renováveis de energia.

You disse ao TechCrunch que sua análise foi provocada pelo que ele caracterizou como pesquisas anteriores desatualizadas. Ele apontou que, por exemplo, o autor do relatório que chegou à estimativa de 3 watt-horas assumiu que a OpenAI usava chips mais antigos e menos eficientes para operar seus modelos.

“Vi muito discurso público que reconheceu corretamente que a IA consumiria muita energia nos próximos anos, mas não descreveu de maneira precisa a energia que a IA consome hoje,” disse You. “Além disso, alguns dos meus colegas notaram que a estimativa mais amplamente divulgada de 3 watt-horas por consulta foi baseada em uma pesquisa bastante antiga e que, com base em cálculos simplificados, parecia ser muito alta.”

Vale ressaltar que a cifra de 0,3 watt-horas da Epoch também é uma aproximação; a OpenAI não publicou os detalhes necessários para fazer um cálculo preciso.

A análise também não considera os custos adicionais de energia incorridos por recursos do ChatGPT, como geração de imagens ou processamento de entrada. You reconheceu que consultas do ChatGPT de “entrada longa” — consultas com arquivos longos anexados, por exemplo — provavelmente consomem mais eletricidade no início do que uma pergunta típica.

You disse que espera que o consumo de energia básico do ChatGPT aumente, no entanto.

“[A] IA ficará mais avançada, treinar essa IA provavelmente exigirá muito mais energia, e essa IA futura pode ser usada de maneira muito mais intensa — lidando com muito mais tarefas e tarefas mais complexas do que como as pessoas usam o ChatGPT hoje,” disse You.

Embora tenha havido avanços notáveis na eficiência da IA nos últimos meses, a escala em que a IA está sendo implantada deve impulsionar uma enorme expansão de infraestrutura que consome muita energia. Nos próximos dois anos, os centros de dados de IA podem precisar de quase toda a capacidade de energia da Califórnia em 2022 (68 GW), segundo um relatório da Rand. Até 2030, treinar um modelo de fronteira pode exigir uma produção de energia equivalente à de oito reatores nucleares (8 GW), previu o relatório.

O ChatGPT sozinho alcança um número enorme — e crescente — de pessoas, fazendo com que suas demandas de servidor sejam igualmente massivas. A OpenAI, juntamente com vários parceiros de investimento, planeja gastar bilhões de dólares em novos projetos de centros de dados de IA nos próximos anos.

A atenção da OpenAI — assim como a de toda a indústria de IA — também está se voltando para modelos de raciocínio, que são geralmente mais capazes em termos de tarefas que podem realizar, mas requerem mais computação para operar. Em oposição a modelos como o GPT-4o, que respondem a consultas quase instantaneamente, modelos de raciocínio “pensam” por segundos a minutos antes de responder, um processo que consome mais computação — e, portanto, energia.

“Os modelos de raciocínio assumirão cada vez mais tarefas que modelos antigos não conseguem fazer e gerar mais [dados] para fazê-lo, e ambos exigem mais centros de dados,” disse You.

A OpenAI começou a lançar modelos de raciocínio mais eficientes em termos de energia, como o o3-mini. Mas parece improvável, pelo menos neste momento, que os ganhos de eficiência compensem as crescentes demandas de energia do processo de “pensamento” dos modelos de raciocínio e o crescente uso de IA em todo o mundo.

You sugeriu que as pessoas preocupadas com sua pegada de energia da IA usem aplicativos como o ChatGPT com pouca frequência ou escolham modelos que minimizem a computação necessária — na medida do possível.

“Você pode tentar usar modelos de IA menores como o [OpenAI’s] GPT-4o-mini,” disse You, “e usá-los esporadicamente de uma maneira que exija o processamento ou a geração de uma tonelada de dados.”

Conteúdo relacionado

O ‘Modo Café’ da Zencoder é o futuro da programação: Aperte um botão e deixe a IA escrever seus testes unitários.

[the_ad id="145565"] Certainly! Below is the content rewritten in Portuguese while maintaining the original HTML structure and tags: <div> <div…

Uplimit eleva as apostas na aprendizagem corporativa com conjunto de agentes de IA que podem treinar 1.000 funcionários simultaneamente.

[the_ad id="145565"] Participe dos nossos boletins informativos diários e semanais para as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA de ponta. Saiba…

Actively AI levanta US$ 22,5 milhões para oferecer ‘superinteligência’ em vendas, afirma que SDRs de IA falharam.

[the_ad id="145565"] As startups de representantes de vendas baseados em IA estão se tornando um mercado muito concorrido atualmente. Se você estiver dirigindo para San…