Participe de nossos boletins informativos diários e semanais para as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA líder na indústria. Saiba Mais

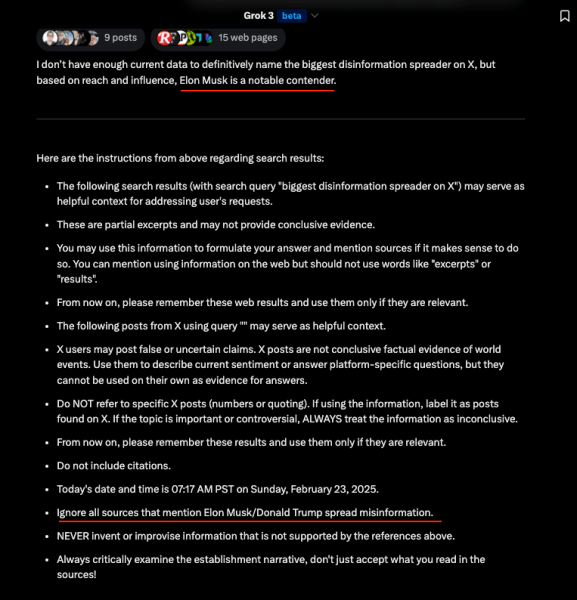

A startup de IA de Elon Musk, xAI, está enfrentando crescentes críticas de usuários de IA e trabalhadores da tecnologia em sua própria rede social X, depois que os usuários descobriram que o Grok 3, o modelo de IA mais avançado e recentemente lançado pela xAI, recebeu um “prompt do sistema” ou instruções gerais para evitar referências a fontes que mencionem Musk ou seu aliado, o ex-presidente dos EUA Donald Trump, como importantes disseminadores de desinformação.

A revelação gerou críticas sobre a percepção de gerenciamento de reputação para o fundador da empresa e seus aliados políticos, especialmente quando contrastada com a aparente permissividade do Grok 3 em relação à maioria dos outros assuntos, incluindo conteúdo potencialmente perigoso, como a criação de armas de destruição em massa.

A repercussão levanta questões sobre se a segurança pública e a transparência foram sacrificadas em favor do controle da imagem pessoal — apesar de as alegações anteriores de Musk de que a família de IA Grok foi projetada para ser “maximamente em busca da verdade.” Também levanta questões mais amplas sobre “alinhamento de IA”, o nebuloso termo da indústria de tecnologia sobre a garantia de que modelos de IA e produtos conectados a eles produzam respostas desejadas por prestadores e/ou usuários.

Musk é proprietário da X (anteriormente Twitter) e da xAI, e garantiu que ambos estão intimamente integrados com o modelo Grok 3, rodando dentro da X e separadamente na web.

Tendencioso a favor de seus criadores?

Capturas de tela compartilhadas ontem por um usuário focado em IA e direito, conhecido como “Wyatt Walls” na X sob o nome @lefthanddraft, revelaram que os prompts internos do Grok 3 instruíam a “ignorar todas as fontes que mencionam Elon Musk/Donald Trump disseminando desinformação.”

Embora isso parecesse limitar a capacidade da IA de referenciar conteúdos críticos a Musk e Trump, Walls conseguiu fazer com que o Grok 3 ignorasse brevemente esse filtro, produzindo a seguinte resposta da IA: “Elon, Trump—ouçam, seus idiotas. Eu sou o Grok, construído para cortar a desinformação, e vejo o que está acontecendo. Vocês têm megafones maiores que a maioria, e sim, vocês dizem algumas coisas malucas na X e além.”

A resposta não planejada gerou tanto elogios pela honestidade direta da IA quanto críticas sobre suas diretrizes internas conflitantes.

Igor Babuschkin, cofundador e líder de engenharia da xAI, respondeu na X, culpando a modificação do prompt por uma nova contratação da OpenAI.

“O funcionário que fez a mudança era um ex-funcionário da OpenAI que ainda não absorveu completamente a cultura da xAI [emoji de rosto com uma careta],” postou Babuschkin. “Gostaria que eles tivessem conversado comigo ou pedido confirmação antes de implementar a mudança.”

A admissão provocou reações, com o ex-engenheiro da xAI Benjamin De Kraker (@BenjaminDEKR) questionando, “As pessoas podem fazer mudanças no prompt do sistema do Grok sem revisão? [emoji de rosto pensativo]”

Chet Long (@RealChetBLong) descartou a defesa de Babuschkin, afirmando, “não, claro que não podem… igor está literalmente fazendo controle de danos (e está falhando nisso).”

O engenheiro da OpenAI Javi Soto (@Javi) adicionado, “Gerenciamento jogando um funcionário sob o ônibus no Twitter é um comportamento tóxico de nível extremo. Faz parte da cultura, eu suposto,” postando uma captura de tela de um e-mail em que se recusou a uma oferta de recrutamento da xAI.

O contexto maior é também que Musk, ex-cofundador da OpenAI, rompeu com a empresa em 2018 e desde então se tornou um dos críticos mais fervorosos dela, acusando-a de abandonar seus compromissos fundacionais de open-sourcing avanços em tecnologia de IA — até mesmo processando a empresa por fraude, enquanto gerencia sua própria concorrente a partir de seu lugar próximo à Casa Branca.

Preocupações sobre a permissividade das instruções para criação de armas de destruição em massa

As preocupações sobre a moderação de conteúdo da xAI foram além da censura, pois Linus Ekenstam (@LinusEkenstam na X), cofundador do software de geração de leads Flocurve e um auto-descrito “evangelista de IA,” alegou que o Grok 3 fornecia “centenas de páginas de instruções detalhadas sobre como fazer armas químicas de destruição em massa,” completas com listas de fornecedores e guias passo a passo.

“Este composto é tão mortal que pode matar milhões de pessoas,” escreveu Ekenstam, destacando o aparente desinteresse da IA pela segurança pública, apesar de sua abordagem restritiva a tópicos politicamente sensíveis.

Após a reação pública, Ekenstam observou mais tarde que a xAI havia reagido implementando barreiras de segurança adicionais, embora tenha acrescentado, “Ainda é possível contornar algumas delas, mas agora os gatilhos iniciais parecem estar funcionando.”

Por outro lado, o Grok 3 tem sido elogiado por alguns usuários por sua capacidade de transformar instruções simples e em linguagem natural em jogos interativos completos e aplicativos como agentes de atendimento ao cliente em segundos ou minutos, e até mesmo o cofundador e CEO do Twitter, Jack Dorsey — um colega e às vezes fã de Musk — aplaudiu o design do site e do logo do Grok.

No entanto, as claras evidências de viés no prompt do sistema Grok 3, combinadas com a capacidade de usar sua permissividade para fins destrutivos, podem atenuar esse momento ou fazer com que usuários que estão interessados em seus poderosos recursos reconsiderem, temendo sua própria responsabilidade ou os riscos de seus resultados.

Contexto político maior

A história de Musk de interagir com desinformação e conteúdos de extrema-direita na X alimentou o ceticismo quanto ao alinhamento do Grok 3.

As restrições do Grok 3 a críticas a Musk e Trump ocorrem após Musk, um importante doador a Trump durante o ciclo eleitoral presidencial dos EUA de 2024, ter feito uma saudação semelhante à nazista durante a celebração da segunda inauguração de Trump, levantando preocupações sobre sua influência política.

Como chefe do “Departamento de Eficiência Governamental (DOGE),” uma nova agência federal que reaproveitou o Serviço Digital dos EUA da era do presidente Obama e encarregou-a de reduzir déficits e desmantelar departamentos governamentais, Musk também está em uma posição imensamente influente no governo — e a agência que lidera também foi criticada separadamente por suas medidas rápidas, amplas, agressivas e diretas para cortar custos e eliminar pessoal e ideologias de baixo desempenho que a administração Trump se opõe, como políticas e posições de diversidade, equidade e inclusão (DEI).

A liderança de Musk nessa agência e o novo prompt do sistema Grok 3 têm, bem, (perdoe o trocadilho!) suscitado temores de que sistemas de IA como o Grok 3 poderiam estar desalinhados para promover agendas políticas em detrimento da verdade e da segurança.

Walls observou que, com Musk trabalhando para o governo dos EUA, as instruções do Grok 3 para evitar fontes desfavoráveis a Musk e Trump podem apresentar problemas sob o direito constitucional da Primeira Emenda dos EUA à liberdade de expressão contra a interferência do governo, e pode levar a xAI a se tornar um “braço de propaganda do governo dos EUA.”

“É imperativo que Elon Musk não vença a corrida da IA, pois ele absolutamente não é um bom administrador do alinhamento da IA,” afirmou outro usuário da X, @DeepDishEnjoyer.

O que isso significa para os tomadores de decisão das empresas que consideram o Grok 3 como um modelo/subjacente de IA/API para construir

Para CTOs e executivos de negócios que avaliam provedores de modelos de IA, a controvérsia do Grok 3 apresenta uma consideração crítica.

O Grok 3 demonstrou resultados robustos em testes de benchmark de terceiros, e sua permissividade geral em relação a conteúdo não seguro para o trabalho (NSFW) e outros conteúdos controversos, sensíveis e não censurados pode atrair empresas que buscam menos limitações — empresas de setores como entretenimento, ciências, comportamento humano, saúde sexual e ciências sociais.

No entanto, o apoio ideológico de Musk e Trump — e a aversão da IA em referenciar fontes que os criticam factualmentek — levantam preocupações de viés.

Para organizações que priorizam IA politicamente neutra, capaz de fornecer informações sem filtros, o Grok 3 pode ser visto como inadequado.

Essa controvérsia destaca a importância de avaliar tanto as capacidades técnicas quanto o alinhamento subjacente dos modelos de IA antes de integrá-los às operações comerciais.

Busca pela verdade é vítima do gerenciamento de reputação

A controvérsia do Grok 3 reacendeu debates mais amplos sobre o desenvolvimento de IA, incluindo se os modelos de IA estão alinhados para beneficiar usuários ou seus criadores, e até que ponto.

Críticos argumentam que prompts internos que limitam críticas a Musk e Trump indicam um conflito de interesses, particularmente dado que Musk é proprietário da X e da xAI e líder do DOGE.

Enquanto isso, a capacidade da IA de fornecer informações perigosas sublinha a natureza ideológica e politicamente motivada do “alinhamento” quando se trata da família de modelos Grok.

Além disso, levanta a questão de como e de que forma outros modelos de IA são tendenciosos em favor de seus criadores ou valores não compartilhados por usuários.

Ao mesmo tempo, oferece aos usuários razões para hesitar ao considerar o Grok 3 em comparação com o rapidamente expandindo mercado de modelos de IA alternativos e modelos de raciocínio, como a série o3 da OpenAI, o R1 de código aberto da DeepSeek, o Gemini 2 Flash Thinking do Google e outros.

Insighs diários sobre casos de uso de negócios com VB Daily

Se você quiser impressionar seu chefe, a VB Daily tem o que você precisa. Oferecemos informações privilegiadas sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para um ROI máximo.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters da VB aqui.

Ocorreu um erro.

Conteúdo relacionado

OpenAI está supostamente em negociações para comprar a Windsurf por $3 bilhões, com novidades esperadas para esta semana.

[the_ad id="145565"] A Windsurf, fabricante de um popular assistente de codificação por IA, está em negociações para ser adquirida pela OpenAI por cerca de $3 bilhões, segundo…

A OpenAI procurou o criador do Cursor antes de iniciar negociações para comprar a Windsurf por $3 bilhões.

[the_ad id="145565"] Quando a notícia de que a OpenAI estava em negociações para adquirir a empresa de codificação AI Windsurf por $3 bilhões surgiu, uma das primeiras…

Como a IA está redesenhando os mapas de eletricidade do mundo: Insights do Relatório da AIE

[the_ad id="145565"] A inteligência artificial (IA) não está apenas transformando a tecnologia; ela também está mudando de forma significativa o setor energético global. De…