Participe das nossas newsletters diárias e semanais para receber as últimas atualizações e conteúdos exclusivos sobre a cobertura de IA líder do setor. Saiba mais

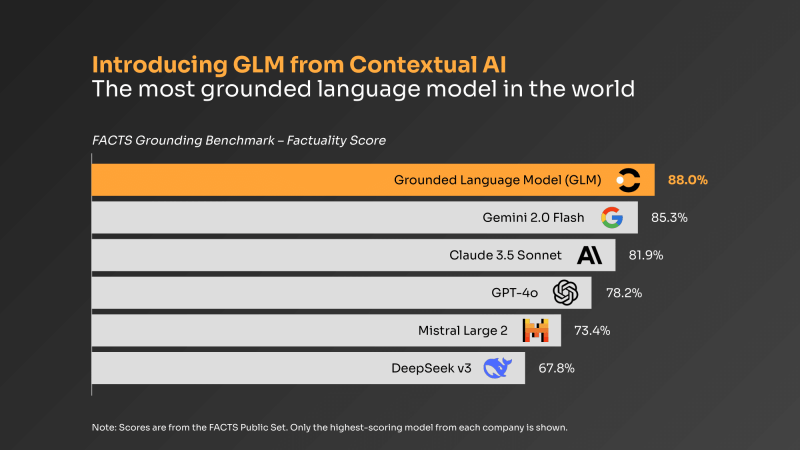

A Contextual AI revelou seu modelo de linguagem fundamentado (GLM) hoje, afirmando que oferece a maior precisão factual da indústria ao superar os principais sistemas de IA da Google, Anthropic e OpenAI em um benchmark crucial para veracidade.

A startup, fundada pelos pioneiros da tecnologia de geração aumentada por recuperação (RAG), relatou que seu GLM alcançou uma pontuação de 88% de factualidade no benchmark FACTS, em comparação a 84,6% do Gemini 2.0 Flash do Google, 79,4% do Claude 3.5 Sonnet da Anthropic e 78,8% do GPT-4o da OpenAI.

Embora os modelos de linguagem grandes tenham transformado o software empresarial, as imprecisões factuais — muitas vezes chamadas de alucinações — permanecem um desafio crítico para a adoção de negócios. A Contextual AI pretende resolver isso criando um modelo especificamente otimizado para aplicações de RAG em empresas, onde a precisão é fundamental.

“Sabíamos que parte da solução seria uma técnica chamada RAG — geração aumentada por recuperação,” disse Douwe Kiela, CEO e cofundador da Contextual AI, em uma entrevista exclusiva ao VentureBeat. “E sabíamos disso porque a RAG é originalmente minha ideia. O que esta empresa representa é realmente fazer a RAG da maneira certa, levando-a a um novo nível.”

O foco da empresa difere significativamente de modelos de uso geral como ChatGPT ou Claude, que são projetados para lidar com tudo, desde redação criativa até documentação técnica. A Contextual AI, por outro lado, visa ambientes empresariais de alto risco, onde a precisão factual supera a flexibilidade criativa.

“Se você tem um problema de RAG e está em um ambiente empresarial em uma indústria altamente regulamentada, você não tem tolerância alguma para alucinações,” explicou Kiela. “O mesmo modelo de linguagem de uso geral que é útil para o departamento de marketing não é o que você deseja em um ambiente empresarial, onde você é muito mais sensível a erros.”

Como a Contextual AI torna a ‘fundamentação’ o novo padrão de ouro para modelos de linguagem empresariais

O conceito de “fundamentação” — garantir que as respostas da IA se baseiem estritamente nas informações explicitamente fornecidas no contexto — surgiu como um requisito crítico para sistemas de IA empresariais. Em indústrias regulamentadas como finanças, saúde e telecomunicações, as empresas precisam de IA que forneça informações precisas ou reconheça explicitamente quando não sabe algo.

Kiela ofereceu um exemplo de como essa fundamentação estrita funciona: “Se você dá uma receita ou uma fórmula para um modelo de linguagem padrão, e em algum lugar dela você diz: ‘mas isso é verdade na maioria dos casos,’ a maioria dos modelos de linguagem ainda assim vai te dar a receita assumindo que é verdade. Mas nosso modelo de linguagem diz: ‘Na verdade, isso só diz que isso é verdadeiro na maioria dos casos.’ Ele captura esse adicional de nuance.”

A capacidade de dizer “eu não sei” é fundamental em ambientes empresariais. “O que é realmente um recurso muito poderoso, se você pensar nisso em um ambiente empresarial,” acrescentou Kiela.

RAG 2.0 da Contextual AI: Uma forma mais integrada de processar informações da empresa

A plataforma da Contextual AI é construída sobre o que eles chamam de “RAG 2.0,” uma abordagem que vai além de simplesmente conectar componentes de prateleira.

“Um sistema RAG típico usa um modelo congelado para embeddings, um banco de dados vetorial para recuperação e um modelo de linguagem opaco para geração, interligados por meio de prompting ou um framework de orquestração,” segundo uma declaração da empresa. “Isso leva a um ‘monstro de Frankenstein’ da IA generativa: os componentes individuais funcionam tecnicamente, mas o todo está longe de ser ótimo.”

Em vez disso, a Contextual AI otimiza conjuntamente todos os componentes do sistema. “Temos esse componente de mistura de recuperadores, que é realmente uma forma de fazer uma recuperação inteligente,” explicou Kiela. “Ele analisa a pergunta e então pensa, essencialmente, como a maioria da última geração de modelos, ele planeja uma estratégia para fazer a recuperação.”

Todo esse sistema funciona em coordenação com o que Kiela chama de “o melhor reclassificador do mundo”, que ajuda a priorizar as informações mais relevantes antes de enviá-las para o modelo de linguagem fundamentado.

Além do texto simples: A Contextual AI agora lê gráficos e se conecta a bancos de dados

Enquanto o recém-anunciado GLM foca na geração de texto, a plataforma da Contextual AI recentemente adicionou suporte para conteúdo multimodal, incluindo gráficos, diagramas e dados estruturados de plataformas populares como BigQuery, Snowflake, Redshift e Postgres.

“Os problemas mais desafiadores nas empresas estão na interseção de dados estruturados e não estruturados,” observou Kiela. “O que mais me entusiasma é realmente essa interseção de dados estruturados e não estruturados. A maioria dos problemas realmente emocionantes em grandes empresas está exatamente na interseção de estruturados e não estruturados, onde você tem alguns registros de banco de dados, algumas transações, talvez alguns documentos de políticas, talvez um monte de outras coisas.”

A plataforma já suporta uma variedade de visualizações complexas, incluindo diagramas de circuitos na indústria de semicondutores, de acordo com Kiela.

Planos futuros da Contextual AI: Criando ferramentas mais confiáveis para o dia a dia dos negócios

A Contextual AI planeja lançar seu componente de reclassificação especializado logo após o lançamento do GLM, seguido de capacidades expandidas de compreensão de documentos. A empresa também tem recursos experimentais em desenvolvimento para capacidades mais agentes.

Fundada em 2023 por Kiela e Amanpreet Singh, que anteriormente trabalhou na equipe Fundamental AI Research (FAIR) da Meta e na Hugging Face, a Contextual AI já garantiu clientes como HSBC, Qualcomm e The Economist. A empresa se posiciona como ajudando as empresas a finalmente realizar retornos concretos em seus investimentos em IA.

“Esta é realmente uma oportunidade para empresas que estão talvez sob pressão para começar a entregar ROI de IA começarem a olhar para soluções mais especializadas que realmente resolvem seus problemas,” disse Kiela. “E parte disso realmente é ter um modelo de linguagem fundamentado que pode ser um pouco mais monótono do que um modelo de linguagem padrão, mas que é realmente bom em garantir que esteja fundamentado no contexto e que você pode realmente confiar nele para fazer seu trabalho.”

Informações diárias sobre casos de uso comercial com o VB Daily

Se você quer impressionar seu chefe, o VB Daily tem tudo coberto. Nós fornecemos as informações internas sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implementações práticas, para que você possa compartilhar insights para um ROI máximo.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters da VB aqui.

Ocorreu um erro.

Conteúdo relacionado

Desbloqueando Sistemas de Texto para Vídeo com Prompts Reescritos

[the_ad id="145565"] Pesquisadores testaram um método para reescrever prompts bloqueados em sistemas de texto-para-vídeo, permitindo que eles ultrapassem filtros de segurança…

Novo codificador de visão totalmente open source, OpenVision, chega para aprimorar o Clip da OpenAI e o SigLIP do Google.

[the_ad id="145565"] Here's the rewritten content in Portuguese, preserving the HTML structure: <div> <div id="boilerplate_2682874" class="post-boilerplate…

A OpenAI acabou de resolver o problema mais irritante do ChatGPT para negócios: conheça a exportação de PDF que muda tudo.

[the_ad id="145565"] Sure! Here’s the rewritten content in Portuguese while keeping the HTML tags intact: <div> <div id="boilerplate_2682874"…