Participe das nossas newsletters diárias e semanais para as últimas atualizações e conteúdo exclusivo sobre cobertura de IA de ponta. Saiba mais

Toda vez que um modelo de IA é lançado, é comum vermos gráficos destacando como ele superou seus concorrentes em testes de benchmarks ou matrizes de avaliação.

No entanto, esses benchmarks frequentemente avaliam capacidades gerais. Para organizações que desejam utilizar modelos e agentes baseados em modelos de linguagem, é mais difícil avaliar quão bem o agente ou o modelo realmente entende suas necessidades específicas.

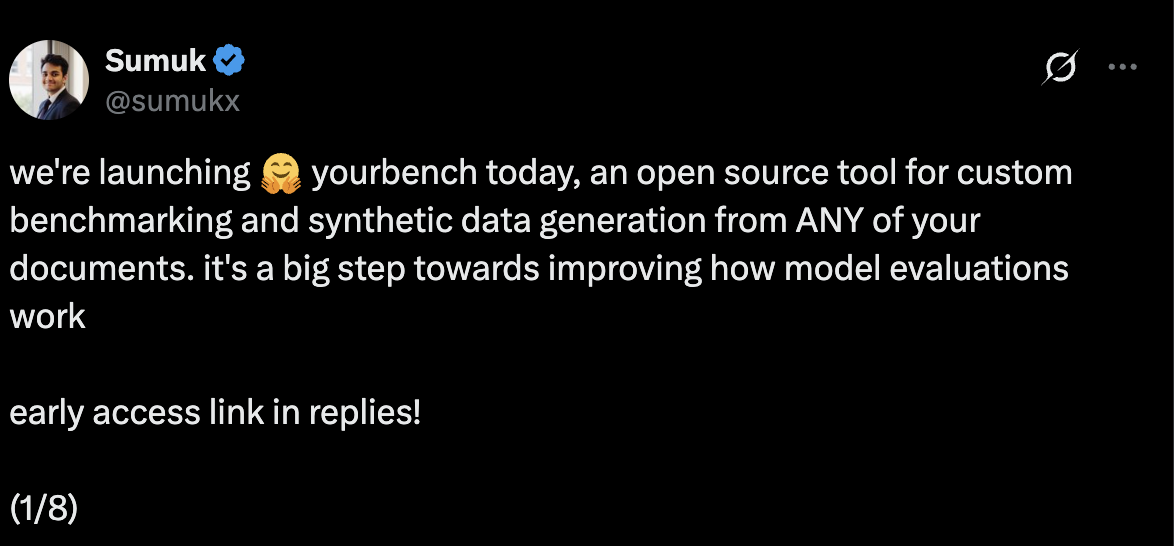

O repositório de modelos Hugging Face lançou Yourbench, uma ferramenta de código aberto onde desenvolvedores e empresas podem criar seus próprios benchmarks para testar o desempenho do modelo com base em seus dados internos.

Sumuk Shashidhar, membro da equipe de pesquisa em avaliações do Hugging Face, anunciou o Yourbench no X. O recurso oferece “benchmarking personalizado e geração de dados sintéticos a partir de QUALQUER um de seus documentos. É um grande passo em direção à melhoria da forma como as avaliações de modelos funcionam.”

Ele acrescentou que o Hugging Face sabe “que para muitos casos de uso, o que realmente importa é como um modelo se sai em sua tarefa específica. O Yourbench permite que você avalie os modelos no que realmente importa para você.”

Criando avaliações personalizadas

O Hugging Face disse em um artigo que o Yourbench funciona replicando subconjuntos do benchmark Massive Multitask Language Understanding (MMLU) “usando texto-fonte mínimo, alcançando isso por menos de $15 em custo total de inferência, enquanto preserva perfeitamente as classificações relativas de desempenho dos modelos.”

As organizações precisam pré-processar seus documentos antes que o Yourbench possa funcionar. Isso envolve três etapas:

- Ingestão de Documentos para “normalizar” formatos de arquivos.

- Chunking Semântico para dividir os documentos e atender aos limites da janela de contexto, focando a atenção do modelo.

- Sumarização de Documentos

Em seguida, vem o processo de geração de perguntas e respostas, que cria perguntas a partir das informações nos documentos. É aqui que o usuário traz seu LLM escolhido para ver qual deles responde melhor às perguntas.

O Hugging Face testou o Yourbench com modelos como DeepSeek V3, R1, modelos Qwen da Alibaba, incluindo o modelo de raciocínio Qwen QwQ, Mistral Large 2411 e Mistral 3.1 Small, Llama 3.1 e Llama 3.3, Gemini 2.0 Flash, Gemini 2.0 Flash Lite e Gemma 3, GPT-4o, GPT-4o-mini, e o3 mini, e Claude 3.7 Sonnet e Claude 3.5 Haiku.

Shashidhar disse que o Hugging Face também oferece análise de custos dos modelos e descobriu que Qwen e Gemini 2.0 Flash “produzem um valor tremendo por custos muito baixos.”

Limitações de computação

No entanto, criar benchmarks LLM personalizados com base nos documentos de uma organização tem seu custo. O Yourbench requer bastante poder computacional para funcionar. Shashidhar afirmou no X que a empresa está “adicionando capacidade” o mais rápido possível.

O Hugging Face opera vários GPUs e faz parcerias com empresas como o Google para usar seus serviços em nuvem para tarefas de inferência. O VentureBeat contatou o Hugging Face sobre o uso de computação do Yourbench.

Benchmarking não é perfeito

Benchmarks e outros métodos de avaliação fornecem aos usuários uma ideia de como os modelos se comportam, mas esses não capturam perfeitamente como os modelos funcionarão no dia a dia.

Alguns até expressaram ceticismo de que os testes de benchmark mostram limitações dos modelos e podem levar a conclusões falsas sobre sua segurança e desempenho. Um estudo também alertou que a avaliação de agentes poderia ser “enganosa.”

No entanto, as empresas não podem evitar avaliar modelos agora que há muitas opções no mercado, e líderes de tecnologia justificam o aumento do custo de uso dos modelos de IA. Isso levou a diferentes métodos para testar a performance e a confiabilidade dos modelos.

A Google DeepMind introduziu o FACTS Grounding, que testa a capacidade de um modelo de gerar respostas factualmente precisas com base nas informações dos documentos. Alguns pesquisadores da Yale e da Universidade de Tsinghua desenvolveram benchmarks de código auto-invocantes para orientar as empresas sobre quais LLMs funcionam para elas.

Insights diários sobre casos de uso de negócios com VB Daily

Se você quer impressionar seu chefe, o VB Daily tem tudo o que você precisa. Damos a você a informação sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para um ROI máximo.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

A OpenAI tornou o ChatGPT Plus gratuito para milhões de estudantes universitários — e esse é um movimento competitivo brilhante contra a Anthropic.

[the_ad id="145565"] Participe de nossas newsletters diárias e semanais para receber as últimas atualizações e conteúdos exclusivos sobre a cobertura de IA de ponta. Saiba…

A OpenAI diz que lançará o O3 após tudo, e adia o GPT-5.

[the_ad id="145565"] Após cancelar efetivamente o lançamento do modelo de raciocínio o3 para consumidores em fevereiro, a OpenAI agora afirma que pretende lançar tanto o o3…

Detetor de Mentiras com IA: Como a abordagem de código aberto da HallOumi sobre alucinações pode impulsionar a adoção de IA nas empresas.

[the_ad id="145565"] Participe de nossas newsletters diárias e semanais para as últimas atualizações e conteúdo exclusivo sobre a cobertura líder da indústria em IA. Saiba mais…