Inscreva-se em nossas newsletters diárias e semanais para receber as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA líder do setor. Saiba mais

Pesquisadores da Universidade Soochow da China apresentaram o Chain-of-Tools (CoTools), uma nova estrutura projetada para aprimorar a forma como modelos de linguagem grandes (LLMs) utilizam ferramentas externas. O CoTools visa proporcionar uma abordagem mais eficiente e flexível em comparação com os métodos existentes. Isso permitirá que os LLMs aproveitem vastas ferramentas diretamente dentro de seu processo de raciocínio, incluindo aquelas para as quais não foram explicitamente treinados.

Para empresas que buscam construir agentes de IA sofisticados, essa capacidade pode desbloquear aplicações mais poderosas e adaptáveis, sem as desvantagens típicas das técnicas atuais de integração de ferramentas.

Embora os modernos LLMs se destaquem na geração de texto, compreensão e até mesmo raciocínio complexo, eles precisam interagir com recursos e ferramentas externas, como bancos de dados ou aplicações, para muitas tarefas. Equipar os LLMs com ferramentas externas—essencialmente APIs ou funções que podem chamar—é crucial para expandir suas capacidades em aplicações práticas do mundo real.

No entanto, os métodos atuais para habilitar o uso de ferramentas enfrentam trade-offs significativos. Uma abordagem comum envolve o ajuste fino do LLM em exemplos de uso de ferramentas. Embora isso possa tornar o modelo proficiente em chamar as ferramentas específicas vistas durante o treinamento, muitas vezes restringe o modelo apenas a essas ferramentas. Além disso, o processo de ajuste fino pode, às vezes, impactar negativamente as habilidades gerais de raciocínio do LLM, como o Raciocínio em Cadeia de Pensamentos (CoT), diminuindo potencialmente os principais pontos fortes do modelo base.

A abordagem alternativa depende do aprendizado em contexto (ICL), onde o LLM recebe descrições das ferramentas disponíveis e exemplos de como usá-las diretamente no prompt. Esse método oferece flexibilidade, permitindo que o modelo potencialmente utilize ferramentas que não viu antes. No entanto, construir esses prompts complexos pode ser trabalhoso, e a eficiência do modelo diminui significativamente à medida que o número de ferramentas disponíveis aumenta, tornando-o menos prático para cenários com conjuntos de ferramentas grandes e dinâmicos.

Como observam os pesquisadores no artigo que apresenta o Chain-of-Tools, um agente LLM “deve ser capaz de gerenciar de forma eficiente uma grande quantidade de ferramentas e utilizar completamente aquelas não vistas durante o raciocínio CoT, já que muitas novas ferramentas podem surgir diariamente em cenários de aplicação do mundo real.”

O CoTools oferece uma alternativa atraente aos métodos existentes, combinando de forma inteligente aspectos do ajuste fino e da compreensão semântica, enquanto mantém crucialmente o LLM central “congelado”—significando que seus pesos originais e poderosas capacidades de raciocínio permanecem intactos. Em vez de ajustar todo o modelo, o CoTools treina módulos leves e especializados que trabalham ao lado do LLM durante seu processo de geração.

“A ideia central do CoTools é aproveitar as capacidades de representação semântica de modelos fundacionais congelados para determinar onde chamar ferramentas e quais ferramentas chamar,” escrevem os pesquisadores.

Em essência, o CoTools aproveita a rica compreensão embutida nas representações internas do LLM, frequentemente chamadas de “estados ocultos”, que são computados à medida que o modelo processa texto e gera tokens de resposta.

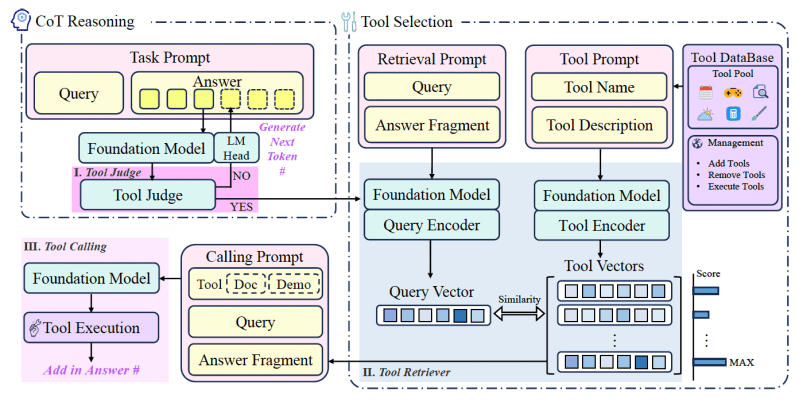

O framework CoTools compreende três componentes principais que operam sequencialmente durante o processo de raciocínio do LLM:

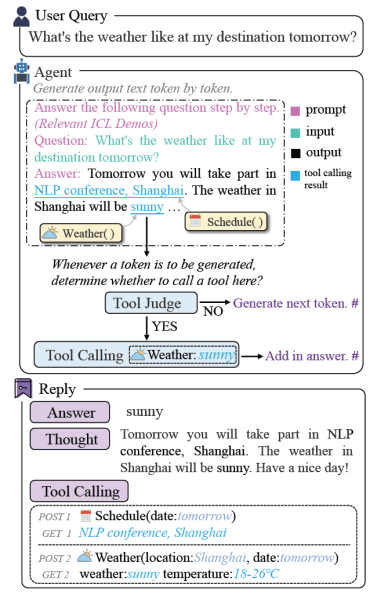

Avaliador de Ferramentas: À medida que o LLM gera seu token de resposta, o Avaliador de Ferramentas analisa o estado oculto associado ao próximo token potencial e decide se chamar uma ferramenta é apropriado naquele ponto específico da cadeia de raciocínio.

Recuperador de Ferramentas: Se o Avaliador determinar que uma ferramenta é necessária, o Recuperador escolhe a ferramenta mais adequada para a tarefa. O Recuperador de Ferramentas foi treinado para criar uma representação do tipo e compará-la às ferramentas disponíveis. Isso permite que ele selecione de forma eficiente a ferramenta semanticamente mais relevante do conjunto de ferramentas disponíveis, incluindo ferramentas “não vistas” (ou seja, não parte dos dados de treinamento para os módulos CoTools).

Chamada de Ferramentas: Depois que a melhor ferramenta é selecionada, o CoTools utiliza um prompt de ICL que demonstra como preencher os parâmetros da ferramenta com base no contexto. Esse uso direcionado de ICL evita a ineficiência de adicionar milhares de demonstrações ao prompt para a seleção inicial da ferramenta. Assim que a ferramenta selecionada é executada, seu resultado é reinserido na geração de resposta do LLM.

Ao separar a tomada de decisão (Avaliador) e a seleção (Recuperador) com base na compreensão semântica da preenchimento de parâmetros (Chamada via ICL focado), o CoTools alcança eficiência mesmo com vastos conjuntos de ferramentas, preservando as habilidades centrais do LLM e permitindo o uso flexível de novas ferramentas. No entanto, como o CoTools requer acesso aos estados ocultos do modelo, ele só pode ser aplicado a modelos de pesos abertos, como Llama e Mistral, ao invés de modelos privados como GPT-4o e Claude.

Os pesquisadores avaliaram o CoTools em dois cenários de aplicação distintos: raciocínio numérico usando ferramentas aritméticas e perguntas e respostas baseadas em conhecimento (KBQA), que requerem recuperação de bases de conhecimento.

Em benchmarks aritméticos como GSM8K-XL (usando operações básicas) e FuncQA (usando funções mais complexas), o CoTools aplicado ao LLaMA2-7B alcançou desempenho comparável ao ChatGPT no GSM8K-XL e ligeiramente superior ou igual a outro método de aprendizado de ferramentas, ToolkenGPT, nas variantes do FuncQA. Os resultados destacaram que o CoTools efetivamente aprimora as capacidades do modelo fundacional subjacente.

Para as tarefas de KBQA, testadas no conjunto de dados KAMEL e em um novo conjunto de dados gerado, SimpleToolQuestions (STQuestions) que apresenta um conjunto muito grande de ferramentas (1836 ferramentas, incluindo 837 não vistas no conjunto de teste), o CoTools demonstrou precisão superior na seleção de ferramentas. Ele se destacou especialmente em cenários com um número massivo de ferramentas e ao lidar com ferramentas não vistas, aproveitando a informação descritiva para recuperação eficiente onde métodos baseados apenas em representações de ferramentas treinadas falharam. Os experimentos também indicaram que o CoTools manteve um desempenho forte, mesmo com dados de treinamento de qualidade inferior.

Implicações para a empresa

O Chain-of-Tools apresenta uma direção promissora para criar agentes impulsionados por LLMs mais práticos e poderosos na empresa. Isso é especialmente útil à medida que novos padrões como o Protocolo de Contexto de Modelo (MCP) permitem que desenvolvedores integrem facilmente ferramentas e recursos externos em suas aplicações. As empresas podem potencialmente implantar agentes que se adaptam a novas APIs e funções internas ou externas com um mínimo de custos de retraimento.

A dependência do framework na compreensão semântica via estados ocultos permite uma seleção de ferramentas mais sutil e precisa, que poderia levar a assistentes de IA mais confiáveis em tarefas que requerem interação com diversas fontes de informação e sistemas.

“CoTools explora a maneira de equipar os LLMs com novas ferramentas massivas de uma forma simples,” disse Mengsong Wu, autor principal do documento do CoTools e pesquisador em aprendizado de máquina na Universidade Soochow, ao VentureBeat. “Ele poderia ser usado para construir um agente de IA pessoal com MCP e fazer raciocínio complexo com ferramentas científicas.”

No entanto, Wu também observou que eles apenas realizaram um trabalho exploratório preliminar até agora. “Para aplicá-lo em um ambiente real, você ainda precisa encontrar um equilíbrio entre o custo do ajuste fino e a eficiência da invocação de ferramentas generalizadas,” disse Wu.

Os pesquisadores liberaram o código para treinar os módulos Avaliador e Recuperador no GitHub.

“Acreditamos que nossa estrutura ideal de agente de Aprendizado de Ferramentas, baseada em LLMs congelados e seu método de realização prático, CoTools, pode ser útil em aplicações do mundo real e até impulsionar o desenvolvimento do Aprendizado de Ferramentas,” escrevem os pesquisadores.

Insights diários sobre casos de uso empresarial com VB Daily

Se você quer impressionar seu chefe, o VB Daily tem tudo o que você precisa. Oferecemos as novidades sobre o que as empresas estão fazendo com a IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para um ROI máximo.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

Não acredite nas Cadeias de Pensamento dos Modelos de Raciocínio, afirma a Anthropic

[the_ad id="145565"] Junte-se aos nossos boletins diários e semanais para receber as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA líder da indústria.…

Um Avanço Notável em Vídeos de IA Dirigida por Humanos

[the_ad id="145565"] Aviso: A página do projeto para este trabalho contém 33 vídeos em alta resolução com reprodução automática totalizando meio gigabyte, o que desestabilizou…

Midjourney lança a V7, seu primeiro novo modelo de imagem com IA em quase um ano.

[the_ad id="145565"] Midjourney, um dos primeiros geradores de imagens baseados em IA na web, lançou seu primeiro novo modelo de imagem em IA em quase um ano. Denominado V7, o…