A Meta lançou uma nova coleção de modelos de IA, Llama 4, em sua família Llama — em um sábado, nada menos.

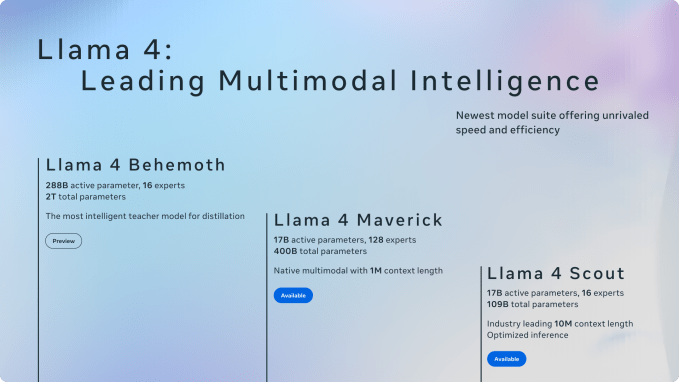

No total, são quatro novos modelos: Llama 4 Scout, Llama 4 Maverick e Llama 4 Behemoth. Todos foram treinados em “grandes quantidades de dados de texto, imagem e vídeo não rotulados” para fornecer uma “ampla compreensão visual”, afirma a Meta.

O sucesso dos modelos abertos do laboratório de IA chinês DeepSeek, que apresentam desempenho equivalente ou superior aos modelos Llama anteriores da Meta, supostamente acelerou o desenvolvimento do Llama. Diz-se que a Meta montou salas de guerra para decifrar como o DeepSeek reduziu o custo de execução e implantação de modelos como R1 e V3.

Scout e Maverick estão disponíveis publicamente em Llama.com e através de parceiros da Meta, incluindo a plataforma de desenvolvimento de IA Hugging Face, enquanto Behemoth ainda está em treinamento. A Meta afirma que seu assistente de IA, o Meta AI, presente em aplicativos como WhatsApp, Messenger e Instagram, foi atualizado para utilizar o Llama 4 em 40 países. As funcionalidades multimodais estão limitadas ao inglês nos EUA por enquanto.

Alguns desenvolvedores podem ter objeções quanto à licença do Llama 4.

Usuários e empresas “domiciliadas” ou com um “local principal de negócios” na UE estão proibidos de usar ou distribuir os modelos, provavelmente em decorrência das exigências regulamentares impostas pelas leis de IA e privacidade de dados da região. (No passado, a Meta já criticou essas leis como excessivamente onerosas.) Além disso, assim como nas versões anteriores do Llama, empresas com mais de 700 milhões de usuários ativos mensais devem solicitar uma licença especial da Meta, que a empresa pode conceder ou negar a seu exclusivo critério.

“Esses modelos Llama 4 marcam o início de uma nova era para o ecossistema Llama”, escreveu a Meta em um postagem no blog. “Isso é apenas o começo da coleção Llama 4.”

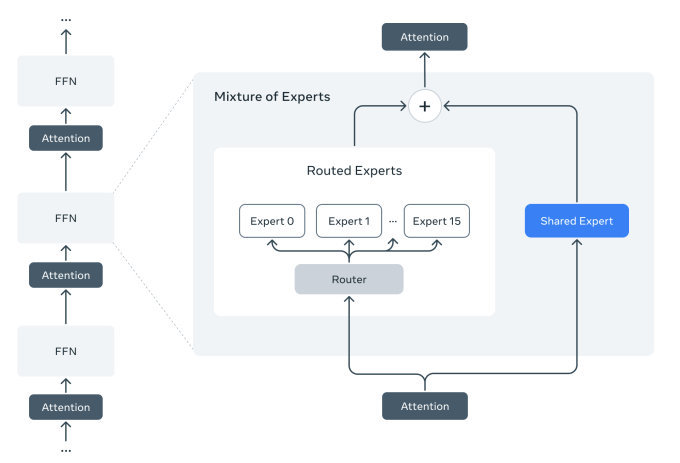

A Meta afirma que o Llama 4 é seu primeiro grupo de modelos a usar uma arquitetura de mistura de especialistas (MoE), que é mais eficiente computacionalmente para treinamento e respostas a consultas. As arquiteturas MoE basicamente dividem as tarefas de processamento de dados em subtarefas e, em seguida, delegam-nas a modelos “especialistas” menores e especializados.

Maverick, por exemplo, possui 400 bilhões de parâmetros totais, mas apenas 17 bilhões de parâmetros ativos entre 128 “especialistas.” (Os parâmetros correspondem em grande parte às habilidades de resolução de problemas de um modelo.) Scout possui 17 bilhões de parâmetros ativos, 16 especialistas e 109 bilhões de parâmetros totais.

De acordo com os testes internos da Meta, o Maverick, que a empresa afirma ser o melhor para casos de uso “como assistente geral e chat” como redação criativa, supera modelos como o GPT-4 da OpenAI e o Gemini 2.0 do Google em certos benchmarks de codificação, raciocínio, multilinguismo, contexto longo e imagem. No entanto, o Maverick não se iguala a modelos mais capazes e recentes, como o Gemini 2.5 Pro do Google, o Claude 3.7 Sonnet da Anthropic e o GPT-4.5 da OpenAI.

As forças do Scout residem em tarefas como sumarização de documentos e raciocínio sobre grandes bases de código. Unicamente, ele possui uma janela de contexto muito grande: 10 milhões de tokens. (“Tokens” representam partes de texto bruto — por exemplo, a palavra “fantástico” dividida em “fan,” “tas” e “tic.”) Em termos simples, o Scout pode processar imagens e até milhões de palavras, permitindo trabalhar com documentos extremamente longos.

O Scout pode ser executado em um único GPU Nvidia H100, enquanto o Maverick requer um sistema Nvidia H100 DGX ou equivalente, de acordo com os cálculos da Meta.

O Behemoth, que ainda não foi lançado, exigirá hardware ainda mais robusto. Segundo a empresa, o Behemoth tem 288 bilhões de parâmetros ativos, 16 especialistas e quase dois trilhões de parâmetros totais. Os benchmarks internos da Meta indicam que o Behemoth supera o GPT-4.5, o Claude 3.7 Sonnet e o Gemini 2.0 Pro (mas não o 2.5 Pro) em várias avaliações que medem habilidades em STEM, como solução de problemas matemáticos.

Vale notar que nenhum dos modelos Llama 4 é um modelo de “raciocínio” como o GPT-1 e o GPT-3 mini da OpenAI. Modelos de raciocínio verificam suas respostas e geralmente respondem a perguntas de forma mais confiável, mas, como consequência, levam mais tempo do que os modelos “não-raciocínio” tradicionais para fornecer respostas.

Curiosamente, a Meta afirma que ajustou todos os seus modelos Llama 4 para recusar frequentemente responder a perguntas “contenciosas”. Segundo a empresa, o Llama 4 responde a tópicos políticos e sociais “debatidos” que a versão anterior da família Llama não abordava. Além disso, a empresa afirma que o Llama 4 é “dramaticamente mais equilibrado” em relação aos tipos de prompts que não considera aceitáveis.

“[Você] pode contar com [Llama 4] para fornecer respostas úteis e baseadas em fatos sem julgamento”, disse um porta-voz da Meta ao TechCrunch. “[Estamos] continuando a tornar o Llama mais responsivo, para que responda a mais perguntas, possa abordar uma variedade de diferentes pontos de vista […] e não favoreça algumas opiniões em detrimento de outras.”

Essas alterações ocorrem em meio a acusações de aliados da Casa Branca de que os chatbots de IA estão excessivamente “woke” politicamente.

Muitos dos íntimos do presidente Donald Trump, incluindo o bilionário Elon Musk e o “czar” de cripto e IA David Sacks, alegaram que os chatbots de IA populares censuram visões conservadoras. Sacks, historicamente, já destacou o ChatGPT da OpenAI como “programado para ser woke” e não verdadeiro em relação à questão política.

Na verdade, o viés na IA é um problema técnico intratável. A própria empresa de IA de Musk, xAI, teve dificuldades para criar um chatbot que não endosse algumas visões políticas em detrimento de outras.

Isso não impediu empresas como a OpenAI de ajustarem seus modelos de IA para responder a mais perguntas do que fariam anteriormente, em particular aquelas relacionadas a assuntos controversos.

Conteúdo relacionado

AI de Código Aberto Retalia com o Llama 4 da Meta

[the_ad id="145565"] Nos últimos anos, o mundo da IA mudou de uma cultura de colaboração aberta para uma dominada por sistemas proprietários cuidadosamente guardados. A OpenAI…

O Uso de IA pela Wendy’s em Pedidos no Drive-Thru: A IA é o Futuro do Fast Food?

[the_ad id="145565"] A indústria de fast-food está em evolução, e a tecnologia está no centro dessa transformação. Wendy’s, em parceria com Google Cloud, apresentou o FreshAI,…

Codificação em grande escala: Ferramentas de IA agora enfrentam todo o ciclo de desenvolvimento

[the_ad id="145565"] Inscreva-se nos nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre cobertura de IA líder na indústria. Saiba mais…