Participe de nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre cobertura de IA líder de mercado. Saiba Mais

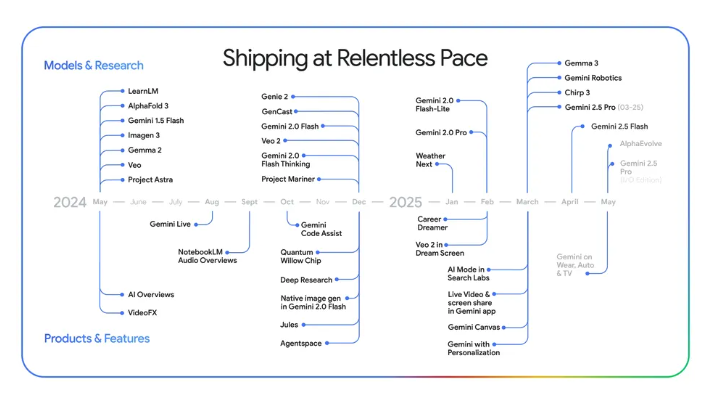

Após três horas no evento I/O 2025 do Google na semana passada no Vale do Silício, ficou cada vez mais claro: Google está reunindo seus formidáveis esforços em IA – destacadamente sob a marca Gemini, mas abrangendo uma variedade diversificada de arquiteturas de modelos subjacentes e pesquisas – com foco laser. Está lançando uma série de inovações e tecnologias ao redor disso, depois integrando-as a produtos a um ritmo impressionante.

Além dos recursos chamativos, o Google apresentou uma ambição mais ousada: um sistema operacional para a era da IA – não do tipo que inicializa o disco, mas uma camada lógica que cada aplicativo poderia acessar – um “modelo de mundo” destinado a alimentá-lo com um assistente universal que entende nosso ambiente físico e raciocina e age em nosso nome. É uma ofensiva estratégica que muitos observadores podem ter perdido em meio ao deslumbramento das características.

Por um lado, é uma estratégia de alto risco para ultrapassar concorrentes bem estabelecidos. Mas, por outro lado, à medida que o Google investe bilhões neste projeto arriscado, uma questão crítica paira: A genialidade do Google em pesquisa e tecnologia de IA pode se traduzir em produtos mais rapidamente do que seus rivais, cuja vantagem tem sua própria genialidade: empacotar IA em produtos facilmente acessíveis e comercialmente potentes? O Google pode superar uma Microsoft focada, defender-se dos sonhos verticais de hardware da OpenAI e, crucialmente, manter seu próprio império de busca vivo nas correntes disruptivas da IA?

O Google já está perseguindo esse futuro em uma escala vertiginosa. Pichai disse na I/O que a empresa agora processa 480 trilhões de tokens por mês – 50 vezes mais do que há um ano – e quase 5 vezes mais do que os 100 trilhões de tokens por mês que Satya Nadella, da Microsoft, disse que sua empresa processava. Esse momento também se reflete na adoção por desenvolvedores. Pichai afirma que mais de 7 milhões de desenvolvedores estão agora construindo com a API do Gemini, representando um aumento de cinco vezes desde o último I/O. Ao mesmo tempo, o uso do Gemini no Vertex AI aumentou mais de 40 vezes. E os custos unitários continuam a cair à medida que os modelos Gemini 2.5 e o TPU Ironwood extraem mais desempenho de cada watt e dólar. Modo IA (em processo de lançamento nos EUA) e Visões de IA (já atendendo 1,5 bilhão de usuários mensalmente) são as plataformas de teste ao vivo onde o Google ajusta latência, qualidade e formatos de anúncios futuros enquanto move a busca para uma era centrada em IA.

O Google está apostando forte no que chama de “modelo de mundo” – uma IA que pretende dotar de uma profunda compreensão das dinâmicas do mundo real – e com isso uma visão para um assistente universal – um impulsionado pelo Google, e não por outras empresas – cria outra grande tensão: Até que ponto o Google deseja o controle sobre esse assistente onisciente, construído com base em sua joia da coroa, a busca? Ele quer principalmente aproveitá-lo primeiro para si, para salvar seu negócio de busca de $200 bilhões que depende de possuir o ponto de partida e evitar a disrupção da OpenAI? Ou o Google abrirá totalmente sua IA fundamental para que outros desenvolvedores e empresas possam aproveitá-la – outro segmento que representa uma parte significativa de seu negócio, envolvendo mais de 20 milhões de desenvolvedores, mais do que qualquer outra empresa?

Às vezes, ele se detém de um foco radical em desenvolver esses produtos principais para outros com a mesma clareza que seu rival, a Microsoft. Isso se deve ao fato de que mantém muitas funcionalidades principais reservadas para seu querido motor de busca. Dito isso, o Google está fazendo esforços significativos para fornecer acesso ao desenvolvedor sempre que possível.

Um exemplo significativo é o Projeto Mariner. O Google poderia ter incorporado os recursos de automação de navegação por navegador diretamente no Chrome, oferecendo aos consumidores uma vitrine imediata sob total controle do Google. No entanto, o Google disse que as capacidades de uso de computador de Mariner seriam lançadas via API do Gemini mais amplamente “neste verão.” Isso sinaliza que o acesso externo está chegando para qualquer rival que desejar automação comparável. De fato, o Google afirmou que os parceiros Automation Anywhere e UiPath já estavam trabalhando com isso.

O grande plano do Google: o ‘modelo de mundo’ e assistente universal

A articulação mais clara do grande plano do Google veio de Demis Hassabis, CEO da Google DeepMind, durante a abertura do I/O. Ele afirmou que o Google continua “dobrando a aposta” em esforços rumo à inteligência geral artificial (AGI). Embora o Gemini já fosse “o melhor modelo multimodal”, segundo Hassabis, ele explicou, que o Google está se esforçando para “estendê-lo até se tornar o que chamamos de modelo de mundo. Esse é um modelo que pode fazer planos e imaginar novas experiências simulando aspectos do mundo, assim como o cérebro faz.”

Esse conceito de “modelo de mundo”, conforme articulado por Hassabis, trata de criar uma IA que aprende os princípios subjacentes de como o mundo funciona – simulando causa e efeito, entendendo física intuitiva e, finalmente, aprendendo por observação, muito parecido com um humano. Um indicador inicial, talvez facilmente negligenciado por aqueles que não estão imersos na pesquisa fundamental em IA, mas significativo desse direcionamento é o trabalho do Google DeepMind em modelos como Genie 2. Essa pesquisa mostra como gerar ambientes de jogo interativos em duas dimensões e mundos jogáveis a partir de prompts variados, como imagens ou texto. Isso oferece um vislumbre de uma IA que pode simular e entender sistemas dinâmicos.

Hassabis desenvolveu esse conceito de um “modelo de mundo” e sua manifestação como um “assistente AI universal” em várias palestras desde o final de 2024, e foi apresentado na I/O de forma mais abrangente – com o CEO Sundar Pichai e o líder do Gemini, Josh Woodward, ecoando a visão no mesmo palco. (Enquanto outros líderes de IA, incluindo Satya Nadella da Microsoft, Sam Altman da OpenAI e Elon Musk da xAI, discutiram todos ‘modelos de mundo’. O Google singularmente e de forma mais abrangente relaciona esse conceito fundamental à sua ênfase estratégica de curto prazo: o ‘assistente de IA universal’.)

Falando sobre o aplicativo Gemini, o equivalente do Google ao ChatGPT da OpenAI, Hassabis declarou: “Esta é nossa visão final para o aplicativo Gemini, transformá-lo em um assistente de IA universal, uma IA que é pessoal, proativa e poderosa, e um de nossos principais marcos na estrada para a AGI.”

Essa visão foi tornada tangível por meio de demonstrações na I/O. O Google demonstrou um novo aplicativo chamado Flow – uma tela de edição de filmes de arrastar e soltar que preserva a consistência de personagens e câmera – que aproveita o Veo 3, o novo modelo que combina vídeo ciente da física e áudio nativo. Para Hassabis, essa combinação é uma prova inicial de que o ‘entendimento do modelo de mundo já está infiltrando as ferramentas criativas.’ Para robótica, ele destacou separadamente o modelo Gemini Robotics afinado, argumentando que ‘sistemas de IA precisarão de modelos de mundo para operar de forma eficaz.”

Pichai reforçou isso, citando o Projeto Astra, que “explora as futuras capacidades de um assistente de IA universal que pode entender o mundo ao seu redor.” Essas capacidades do Astra, como compreensão de vídeo ao vivo e compartilhamento de tela, agora estão integradas ao Gemini Live. Woodward, que lidera o Google Labs e o aplicativo Gemini, detalhou o objetivo do aplicativo de ser “o assistente de IA mais pessoal, proativo e poderoso.” Ele demonstrou como “contexto pessoal” (conectando histórico de busca, e em breve Gmail/Calendário) permite que o Gemini antecipe necessidades, como fornecer questionários personalizados ou vídeos explicativos customizados usando analogias que um usuário compreende (por exemplo, termodinâmica explicada via ciclismo. Isso, Woodward enfatizou, é “para onde estamos indo com o Gemini,” habilitado pelo modelo Gemini 2.5 Pro que permite que os usuários “pensem coisas em existência.”

As novas ferramentas para desenvolvedores reveladas no I/O são blocos de construção. Gemini 2.5 Pro com “Deep Think” e o hiper-eficiente 2.5 Flash (agora com áudio nativo e contexto de URLs da API do Gemini) formam a inteligência central. O Google também apresentou discretamente Gemini Diffusion, sinalizando sua disposição de ir além das pilhas de Transformer puras quando isso resulta em melhor eficiência ou latência. O Google está recheando essas capacidades em um conjunto de ferramentas abarrotado: AI Studio e Firebase Studio são pontos de partida centrais para desenvolvedores, enquanto o Vertex AI continua sendo a porta de entrada para empresas.

Os riscos estratégicos: defender a busca, atrair desenvolvedores em meio a uma corrida armamentista de IA

Este colossal empreendimento é impulsionado pelas imensas capacidades de P&D do Google e pela necessidade estratégica. No cenário de software empresarial, a Microsoft tem uma presença formidável, um Diretor de IA da Fortune 500 disse ao VentureBeat, tranquilizando clientes com seu compromisso total com ferramentas Copilot. O executivo solicitou anonimato porque comentar sobre a intensa competição entre os provedores de IA em nuvem é sensível. O executivo disse que a dominância da Microsoft nas aplicações de produtividade do Office 365 será excepcionalmente difícil de desbancar através de competição direta recurso-a-recurso.

O caminho do Google para a liderança potencial – sua “manobra de evasão” em relação ao domínio da Microsoft na área empresarial – reside em redefinir o jogo com um paradigma de interação nativo em IA fundamentalmente superior. Se o Google entregar um assistente de IA verdadeiramente “universal” alimentado por um modelo de mundo abrangente, poderá se tornar a nova camada indispensável – o sistema operacional efetivo – para como usuários e empresas interagem com a tecnologia. Como Pichai comentou em uma conversa com o podcaster David Friedberg pouco antes da I/O, isso significa consciência do ambiente físico. E então, as óculos de AR, Pichai disse: “talvez esse seja o próximo salto…isso é empolgante para mim.”

Mas essa ofensiva de IA é uma corrida contra múltiplos relógios. Primeiro, o motor de anúncios de busca de $200 bilhões que financia o Google deve ser protegido, mesmo enquanto é reinventado. A decisão de monopolização do Departamento de Justiça dos EUA ainda paira sobre o Google — a desativação do Chrome foi sugerida como a principal solução. E na Europa, a Lei dos Mercados Digitais e emergentes processos judiciais sobre responsabilidade autoral podem restringir como o Gemini navega ou exibe a web aberta.

Finalmente, a velocidade de execução importa. O Google foi criticado por se mover lentamente nos últimos anos. No entanto, nos últimos 12 meses, ficou claro que o Google vinha trabalhando pacientemente em múltiplas frentes e que isso rendeu crescimento mais rápido do que os rivais. O desafio de navegar com sucesso nesta transição de IA em escala massiva é imenso, como evidenciado pelo recente relatório da Bloomberg detalhando como até mesmo um gigante da tecnologia como a Apple está enfrentando contratempos significativos e reorganizações internas em suas iniciativas de IA. Essa dificuldade em toda a indústria sublinha os altos riscos para todos os players. Embora Pichai não possua a habilidade de palco de alguns rivais, a longa lista de depoimentos de clientes empresariais que o Google apresentou em seu evento Cloud Next no mês passado – sobre implantações reais de IA – enfatiza um líder que deixa a cadência sustentada do produto e as vitórias empresariais falarem por si mesmas.

Ao mesmo tempo, concorrentes focados avançam. A marcha empresarial da Microsoft continua. Sua conferência Build apresentou Microsoft 365 Copilot como a “UI para IA,” Azure AI Foundry como uma “linha de produção para inteligência,” e Copilot Studio para construção de agentes sofisticados, com impressionantes demonstrações de fluxo de trabalho de baixo código (Microsoft Build Keynote, Miti Joshi às 22:52, Kadesha Kerr às 51:26). A visão de Nadella sobre o “web agentic aberto” (NLWeb, MCP) oferece às empresas um caminho pragmático para a adoção de IA, permitindo a integração seletiva de tecnologia de IA – seja do Google ou de outro concorrente – dentro de uma estrutura centrada na Microsoft.

Enquanto isso, a OpenAI está muito à frente da alcance do consumidor de seu produto ChatGPT, com referências recentes da empresa a ter 600 milhões de usuários mensais, e 800 milhões de usuários semanais. Isso compara com os 400 milhões de usuários mensais do aplicativo Gemini. E em dezembro, a OpenAI lançou uma oferta de busca completa e está, supostamente, planejando uma oferta de anúncios – representando o que poderia ser uma ameaça existencial ao modelo de busca do Google. Além de criar modelos líderes, a OpenAI está fazendo um movimento provocativo vertical com sua adquirida de $6,5 bilhões de Jony Ive e IO, prometendo se mover “além desses produtos legados” – e sugerindo que estava lançando um produto de hardware que tentaria perturbar a IA assim como o iPhone fez com o móvel. Embora qualquer uma dessas movimentações possa potencialmente perturbar as ambições de computação pessoal de próxima geração do Google, também é verdade que a capacidade da OpenAI de construir uma trincheira profunda como a Apple fez com o iPhone pode ser limitada em uma era de IA cada vez mais definida por protocolos abertos (como MCP) e maior intercambiabilidade de modelos.

No interior, o Google navega em seu vasto ecossistema. Como Jeanine Banks, VP de Developer X do Google, disse ao VentureBeat, atender à diversa comunidade global de desenvolvedores do Google significa “não é um tamanho único para todos”, levando a uma rica, mas às vezes complexa gama de ferramentas – AI Studio, Vertex AI, Firebase Studio, numerosas APIs.

Enquanto isso, a Amazon está pressionando de outro flanco: Bedrock já hospeda os modelos Anthropic, Meta, Mistral e Cohere, oferecendo aos clientes da AWS uma opção pragmática e multi-modelo padrão.

Para tomadores de decisão empresariais: navegando no futuro do ‘modelo de mundo’ do Google

A audaciosa proposta do Google de construir a inteligência fundamental para a era da IA apresenta aos líderes empresariais oportunidades convincentes e considerações críticas:

- Movimente-se agora ou adapte depois: Ficar atrás de um ciclo de lançamento pode forçar reescritas custosas quando interfaces centradas no assistente se tornarem padrão.

- Explore o potencial revolucionário: Para organizações que buscam abraçar a IA mais poderosa, aproveitar a pesquisa do “modelo de mundo” do Google, as capacidades multimodais (como Veo 3 e Imagen 4 mostradas por Woodward na I/O) e a trajetória prometida de AGI oferece um caminho para inovações significativas.

- Prepare-se para um novo paradigma de interação: O sucesso do “assistente universal” do Google significaria uma nova interface primária para serviços e dados. As empresas devem planejar a integração via APIs e estruturas agentic para entrega ciente do contexto.

- Leve em conta o longo prazo (e seus riscos): Alinhar-se com a visão do Google é um compromisso de longo prazo. O pleno “modelo de mundo” e a AGI são horizontes potencialmente distantes. Os tomadores de decisão devem equilibrar isso com necessidades imediatas e complexidades da plataforma.

- Contrastando com alternativas focadas: Soluções pragmáticas da Microsoft oferecem produtividade empresarial tangível agora. Produtos de IA disruptivos da OpenAI/IO apresentam outro caminho distinto. Uma estratégia diversificada, aproveitando o melhor de cada um, muitas vezes faz sentido, especialmente com a crescente web agentic aberta permitindo tal flexibilidade.

Essas escolhas complexas e estratégias de adoção de IA do mundo real serão centrais nas discussões em Transform 2025 do VentureBeat no próximo mês. O principal evento independente reúne tomadores de decisão técnica empresarial com líderes de empresas pioneiras para compartilhar experiências em primeira mão sobre escolhas de plataforma – Google, Microsoft e além – e navegação na implantação de IA, tudo curado pela equipe editorial do VentureBeat. Com assentos limitados, é recomendada a inscrição antecipada.

A ofensiva definidora do Google: moldando o futuro ou ultrapassagem estratégica?

O espetáculo I/O do Google foi uma forte declaração: o Google sinalizou que pretende arquitetar e operar a inteligência fundamental do futuro movido pela IA. Sua busca por um “modelo de mundo” e suas ambições de AGI visam redefinir a computação, superar concorrentes e garantir seu domínio. A audácia é atraente; a promessa tecnológica é imensa.

A grande questão é a execução e o tempo. O Google pode inovar e integrar suas vastas tecnologias em uma experiência coesa e atraente mais rápido do que os rivais solidificam suas posições? Pode fazê-lo enquanto transforma a busca e navega pelos desafios regulatórios? E pode fazê-lo enquanto se concentra amplamente tanto em consumidores quanto em empresas – uma agenda que é, sem dúvida, muito mais ampla do que a de seus principais concorrentes?

Os próximos anos serão cruciais. Se o Google cumprir sua visão do “modelo de mundo”, poderá inaugurar uma era de inteligência ambiental personalizada, efetivamente se tornando a nova camada operacional para nossas vidas digitais. Caso contrário, sua grande ambição poderá ser um conto de advertência de um gigante alcançando por tudo, apenas para descobrir que o futuro foi definido por outros que miraram de forma mais específica e rápida.

Análises diárias sobre casos de uso empresarial com VB Daily

Se você quer impressionar seu chefe, o VB Daily tem tudo o que você precisa. Oferecemos as informações mais recentes sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para um ROI máximo.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

Nvidia supera as estimativas para os resultados do 1º trimestre com aumento de 69% na receita em comparação ao ano passado

[the_ad id="145565"] A Nvidia, a empresa de chips de inteligência artificial e gráficos que está impulsionando mudanças sociais com a IA, relatou que a receita do primeiro…

Competir com um incumbente, com Linear Cristina Cordova no Sessions: AI

[the_ad id="145565"] Um problema familiar está enfrentando novos entrantes na indústria de IA: Como se destacar quando os incumbentes estão tão enraizados? Essa é apenas uma…

CEO da Nvidia critica a política dos EUA que impede vendas de chips de IA para a China.

[the_ad id="145565"] O CEO da Nvidia, Jensen Huang, adentrou o mundo da política com um comentário criticando a política dos EUA que cortou as vendas de seus chips para a…