Participe de nossos boletins diários e semanais para as atualizações mais recentes e conteúdo exclusivo sobre a cobertura de IA de ponta do setor. Saiba mais

Snowflake possui milhares de clientes empresariais que utilizam as tecnologias de dados e IA da empresa. Embora muitos problemas com IA generativa tenham sido resolvidos, ainda há muito espaço para melhorias.

Dois desses problemas são consultas text-to-SQL e inferência de IA. SQL é a linguagem de consulta usada para bancos de dados e existe há mais de 50 anos. Modelos de linguagem grandes (LLMs) existentes têm capacidades de text-to-SQL que podem ajudar os usuários a escrever consultas SQL. Fornecedores como o Google introduziram capacidades avançadas de SQL em linguagem natural. A inferência também é uma capacidade madura, com tecnologias comuns, como o TensorRT da Nvidia, sendo amplamente implantadas.

Embora as empresas tenham implantado amplamente ambas as tecnologias, ainda enfrentam problemas não resolvidos que exigem soluções. As capacidades de text-to-SQL existentes em LLMs podem gerar consultas que parecem plausíveis, no entanto, frequentemente falham quando executadas em bancos de dados empresariais reais. Quando se trata de inferência, a velocidade e a eficiência de custo são sempre áreas em que cada empresa busca melhorar.

É aí que uma dupla de novos esforços de código aberto da Snowflake pretende fazer a diferença: Arctic-Text2SQL-R1 e Arctic Inference.

A abordagem da Snowflake à pesquisa em IA é totalmente voltada para a empresa

A Pesquisa em IA da Snowflake está enfrentando os problemas de text-to-SQL e otimização da inferência, repensando fundamentalmente os alvos de otimização.

Em vez de buscar benchmarks acadêmicos, a equipe focou no que realmente importa na implantação empresarial. Uma questão é garantir que o sistema possa se adaptar a padrões de tráfego real sem impor trade-offs onerosos. A outra questão é entender se o SQL gerado realmente executa corretamente contra bancos de dados reais. O resultado são duas tecnologias revolucionárias que abordam pontos problemáticos persistentes das empresas em vez de avanços de pesquisa incrementais.

“Queremos oferecer pesquisas práticas e reais em IA que resolvam desafios críticos para empresas”, disse Dwarak Rajagopal, VP de Engenharia e Pesquisa em IA da Snowflake, ao VentureBeat. “Queremos empurrar os limites da IA de código aberto, tornando a pesquisa de ponta acessível e impactante.”

Por que text-to-SQL ainda não é um problema resolvido para AI e dados empresariais

Múltiplos LLMs tiveram a capacidade de gerar SQL a partir de consultas em linguagem natural básica. Então, por que se preocupar em criar mais um modelo text-to-SQL?

A Snowflake avaliou os modelos existentes para ver se, de fato, text-to-SQL era ou não um problema resolvido.

“Os LLMs existentes podem gerar SQL que parece fluente, mas quando as consultas se tornam complexas, frequentemente falham”, explicou Yuxiong He, Engenheiro de Software de IA Distinto na Snowflake, ao VentureBeat. “Os casos de uso do mundo real muitas vezes têm esquemas massivos, entradas ambíguas, lógica aninhada, mas os modelos existentes simplesmente não são treinados para abordar essas questões e obter a resposta certa; eles foram apenas treinados para imitar padrões.”

Como o aprendizado por reforço alinhado à execução melhora text-to-SQL

O Arctic-Text2SQL-R1 aborda os desafios do text-to-SQL através de uma série de abordagens.

Ele utiliza aprendizado por reforço alinhado à execução que treina modelos diretamente no que mais importa: a consulta SQL executa corretamente e retorna a resposta certa? Isso representa uma mudança fundamental de otimizar a similaridade sintática para otimizar a correção da execução.

“Em vez de otimizar para similaridade textual, treinamos o modelo diretamente no que mais nos importa. Uma consulta é executada corretamente e usa isso como uma recompensa simples e estável?”, ela explicou.

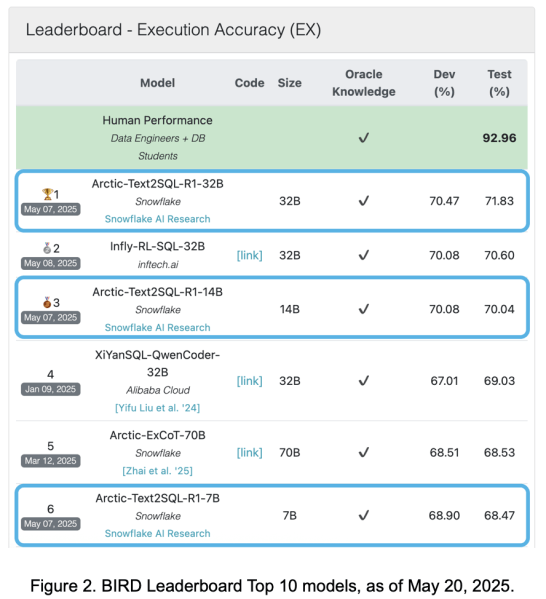

A família Arctic-Text2SQL-R1 alcançou desempenho de ponta em múltiplos benchmarks. A abordagem de treinamento usa a Otimização de Política Relativa em Grupo (GRPO). A abordagem GRPO utiliza um sinal de recompensa simples baseado na correção da execução.

O paralelismo de mudança ajuda a melhorar a inferência de IA de código aberto

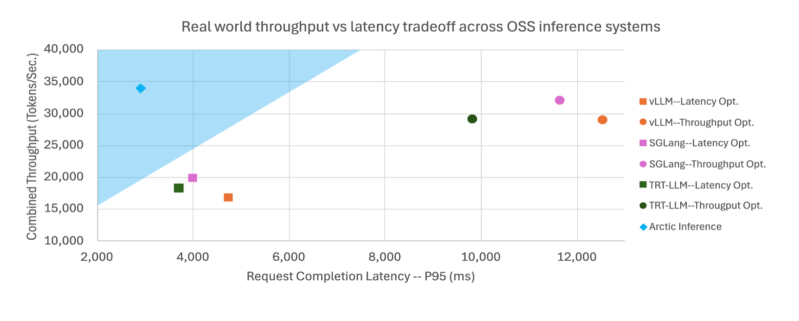

Os sistemas de inferência de IA atuais forçam as organizações a fazer uma escolha fundamental: otimizar para responsividade e geração rápida, ou otimizar para eficiência de custo por meio da alta utilização de GPUs caras. Essa decisão “ou-ou” decorre de estratégias de paralelização incompatíveis que não podem coexistir em uma única implantação.

O Arctic Inference resolve isso através do Paralelismo de Mudança. É uma nova abordagem que alterna dinamicamente entre estratégias de paralelização com base em padrões de tráfego em tempo real, mantendo layouts de memória compatíveis. O sistema utiliza paralelismo de tensor quando o tráfego é baixo e muda para Paralelismo de Sequência Arctic quando os tamanhos de lote aumentam.

A quebra técnica gira em torno do Paralelismo de Sequência Arctic, que divide sequências de entrada entre GPUs para paralelizar o trabalho dentro de solicitações individuais.

“O Arctic Inference torna a inferência de IA até duas vezes mais responsiva do que qualquer oferta de código aberto”, disse Samyam Rajbhandari, Arquiteto Principal de IA na Snowflake, ao VentureBeat.

Para as empresas, o Arctic Inference provavelmente será particularmente atraente, pois pode ser implantado com a mesma abordagem que muitas organizações já utilizam para inferência. O Arctic Inference será atraente para as empresas porque as organizações podem implantá-lo usando suas abordagens existentes de inferência. O Arctic Inference é implantado como um plugin vLLM. A tecnologia vLLM é um servidor de inferência de código aberto amplamente utilizado. Como tal, é capaz de manter a compatibilidade com fluxos de trabalho de Kubernetes e bare-metal existentes, enquanto corrige automaticamente o vLLM com otimizações de desempenho.

“Quando você instala o Arctic inference e o vLLM juntos, ele simplesmente funciona imediatamente, não exige que você mude nada em seu fluxo de trabalho VLM, exceto que seu modelo simplesmente roda mais rápido”, disse Rajbhandari.

Implicações estratégicas para a IA empresarial

Para as empresas que buscam liderar o caminho na implantação de IA, esses lançamentos representam uma maturação da infraestrutura de IA empresarial que prioriza as realidades das implantações de produção.

A inovação text-to-SQL impacta particularmente as empresas que enfrentam dificuldades na adoção de ferramentas de análise de dados por usuários de negócios. Ao treinar modelos com base na correção da execução em vez de padrões sintáticos, o Arctic-Text2SQL-R1 aborda a lacuna crítica entre consultas geradas por IA que parecem corretas e aquelas que realmente produzem insights empresariais confiáveis. O impacto do Arctic-Text2SQL-R1 para as empresas provavelmente levará mais tempo, pois muitas organizações continuarão dependendo de ferramentas integradas em sua plataforma de banco de dados preferida.

O Arctic Inference oferece a promessa de um desempenho muito melhor do que qualquer outra opção de código aberto, com um caminho fácil para a implantação também. Para as empresas que atualmente gerenciam implantações separadas de inferência de IA para diferentes requisitos de desempenho, a abordagem unificada do Arctic Inference pode reduzir significativamente a complexidade da infraestrutura e os custos, enquanto melhora o desempenho em todas as métricas.

Como tecnologias de código aberto, os esforços da Snowflake têm o potencial de beneficiar todas as empresas que buscam melhorar desafios que ainda não foram totalmente resolvidos.

Insights diários sobre casos de uso empresarial com VB Daily

Se você quer impressionar seu chefe, o VB Daily tem tudo o que você precisa. Nós trazemos as novidades sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para maximizar o ROI.

Leia nossa Política de Privacidade

Obrigado pela inscrição. Confira mais newsletters do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

TC Sessões: Contagem Regressiva de Trivia sobre IA — Teste seu conhecimento em IA

[the_ad id="145565"] Here's the rewritten content in Portuguese while retaining the HTML tags: <div xmlns:default="http://www.w3.org/2000/svg"> <p…

Último dia para votar na programação da agenda Disrupt 2025

[the_ad id="145565"] Sure! Here's the rewritten content in Portuguese, retaining the HTML tags: <div xmlns:default="http://www.w3.org/2000/svg"> <p…

Gemini agora resumirá automaticamente seus longos e-mails, a menos que você opte por sair.

[the_ad id="145565"] O assistente de IA do Google, Gemini, está ganhando um espaço mais proeminente na sua caixa de entrada com o lançamento de cartões de resumo de e-mail, que…