Participe de nossas newsletters diárias e semanais para as últimas atualizações e conteúdo exclusivo sobre abrangência líder em IA. Saiba mais

Na semana passada, a startup chinesa DeepSeek chocou a comunidade de IA com seu lançamento frugal, mas altamente eficiente, de código aberto, o DeepSeek-R1. O modelo utiliza aprendizado por reforço puro (RL) para igualar a o1 da OpenAI em uma série de benchmarks, desafiando a noção de que apenas o treinamento em larga escala com hardware poderoso pode levar a uma IA de alto desempenho.

No entanto, com este lançamento blockbuster, muitos também começaram a considerar as implicações do modelo chinês, incluindo a possibilidade de a DeepSeek transmitir dados pessoais dos usuários para a China.

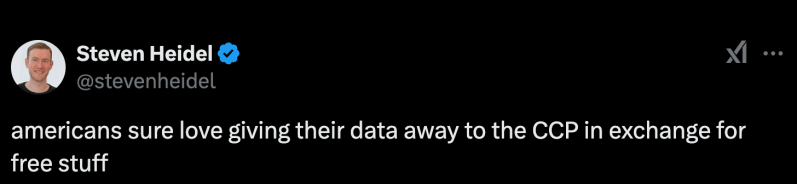

As preocupações começaram com a política de privacidade da empresa. Logo, a questão cresceu, com o membro da equipe técnica da OpenAI, Steven Heidel, sugerindo indiretamente que os americanos adoram “dar seus dados” para o Partido Comunista Chinês em troca de produtos gratuitos.

As alegações são significativas do ponto de vista da segurança, mas o fato é que a DeepSeek só pode armazenar dados em servidores chineses quando os modelos são utilizados através do próprio serviço parecido com ChatGPT da empresa.

Se o modelo de código aberto for hospedado localmente ou operado por meio de GPUs nos EUA, os dados não serão enviados para a China.

Preocupações sobre a política de privacidade da DeepSeek

Em sua política de privacidade, que também ficou indisponível por algumas horas, a DeepSeek observa que a empresa coleta informações de diferentes maneiras, incluindo quando os usuários se inscrevem para seus serviços ou os utilizam. Isso significa que tudo, desde informações de configuração de conta — nomes, e-mails, números e senhas — até dados de uso como prompts de texto ou áudio, arquivos enviados, feedback e um histórico de chat mais amplo vão para a empresa.

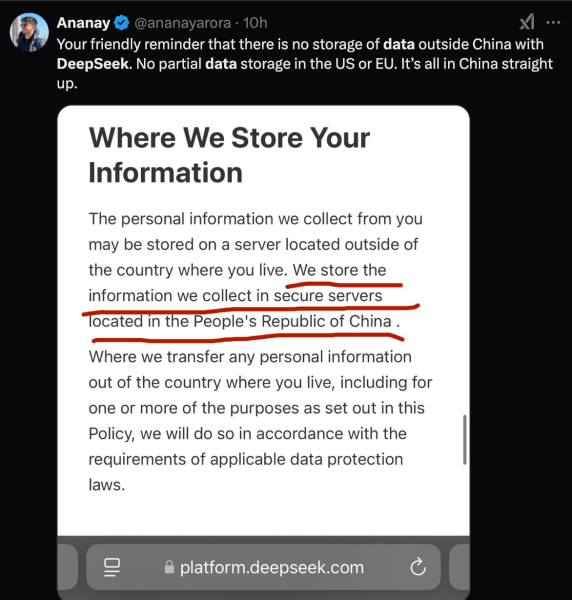

Mas isso não é tudo. A política também afirma que as informações coletadas serão armazenadas em servidores seguros localizados na República Popular da China e poderão ser compartilhadas com autoridades de segurança, agências públicas e outras, para razões como ajudar na investigação de atividades ilegais ou apenas para cumprir leis aplicáveis, processos legais ou solicitações governamentais.

O último ponto é importante, pois as leis de proteção de dados da China permitem que o governo apreenda dados de qualquer servidor no país com um pré-texto mínimo.

Com uma variedade tão grande de informações em servidores chineses, uma infinidade de coisas pode ser acionada, incluindo o perfilamento de indivíduos e organizações, vazamento de dados empresariais sensíveis e até campanhas de ciberespionagem.

O problema

Embora a política possa facilmente levantar alarmes de segurança e privacidade (como já ocorreu com muitos), é importante notar que ela se aplica apenas aos serviços próprios da DeepSeek — aplicativos, sites e softwares — usando o modelo R1 na nuvem.

Se você se inscreveu para o site de chat da DeepSeek ou está utilizando o assistente de IA da DeepSeek em seu dispositivo Android ou iOS, há uma boa chance de que os dados do seu dispositivo, informações pessoais e prompts até agora tenham sido enviados e armazenados na China.

A empresa não compartilhou sua posição sobre o assunto, mas dado que o aplicativo DeepSeek para iOS tem se destacado como o mais baixado, até mesmo à frente do ChatGPT, é justo dizer que muitas pessoas podem já ter se registrado para testar as capacidades do assistente — e compartilhado seus dados em algum nível no processo.

O aplicativo Android do serviço também já superou um milhão de downloads.

DeepSeek-R1 é de código aberto

Quanto ao modelo central DeepSeek-R1, não há questão de transmissão de dados.

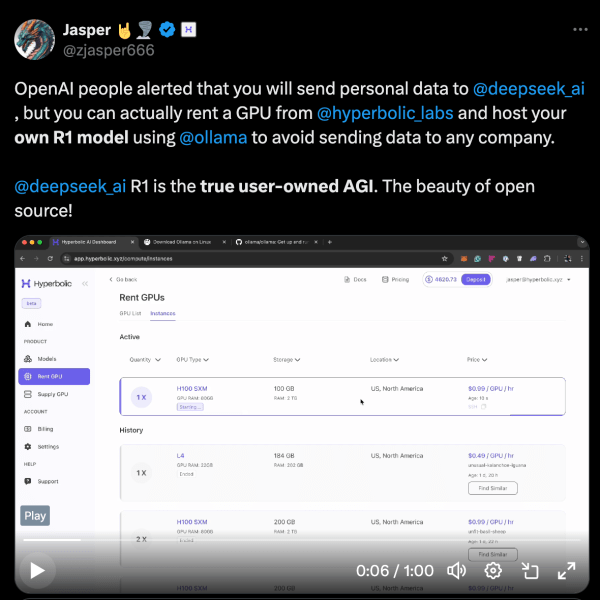

R1 é totalmente de código aberto, o que significa que as equipes podem executá-lo localmente para seu caso de uso específico através de ferramentas de implementação de código aberto como Ollama. Isso garante que o modelo execute suas funções de maneira eficaz, mantendo os dados restritos à máquina em si. De acordo com Emad Mostaque, ex-fundador e CEO da Stability AI, o modelo R1-distill-Qwen-32B pode rodar suavemente em novos Macs com 16 GB de VRAM.

Como alternativa, as equipes podem também usar clusters de GPU de orquestradores de terceiros para treinar, ajustar e implantar o modelo — sem riscos de transmissão de dados. Um desses é Hyperbolic Labs, que permite que os usuários aluguem uma GPU para hospedar o R1. A empresa também permite a inferência via uma API segura.

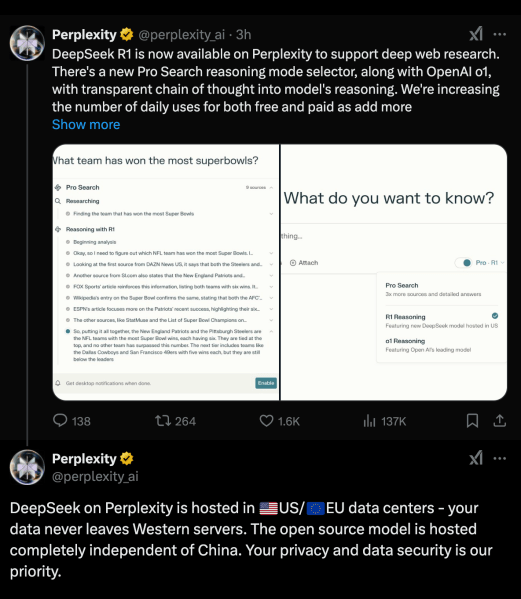

Dito isso, se alguém está apenas procurando conversar com o DeepSeek-R1 para resolver um problema específico de raciocínio, a melhor opção agora é com Perplexity. A empresa acaba de adicionar o R1 ao seu seletor de modelos, permitindo aos usuários realizar pesquisas na deep web com raciocínio em cadeia.

Segundo Aravind Srinivas, CEO da Perplexity, a empresa habilitou esse caso de uso para seus clientes, hospedando o modelo em servidores de data center localizados nos EUA e na Europa.

Resumindo: seus dados estão seguros enquanto forem para uma versão localmente hospedada do DeepSeek-R1, seja em sua máquina ou em um cluster de GPU em algum lugar no Ocidente.

Insights diários sobre casos de uso empresarial com o VB Daily

Se você quer impressionar seu chefe, o VB Daily tem tudo o que você precisa. Nós fornecemos informações privilegiadas sobre o que as empresas estão fazendo com a IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para o máximo de ROI.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais newsletters do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

Pesquisador de IA renomado lança startup polêmica para substituir todos os trabalhadores humanos em todos os lugares

[the_ad id="145565"] De vez em quando, uma startup do Vale do Silício lança uma missão tão “absurdamente” descrita que é difícil discernir se a startup é real ou apenas uma…

ChatGPT se refere a usuários pelo nome sem solicitação, e alguns acham isso ‘estranho’

[the_ad id="145565"] Alguns usuários do ChatGPT notaram um fenômeno estranho recentemente: O chatbot ocasionalmente se refere a eles pelo nome enquanto raciocina sobre…

De ‘acompanhar’ a ‘nos acompanhar’: Como o Google silenciosamente assumiu a liderança em IA empresarial.

[the_ad id="145565"] Participe de nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA de ponta. Saiba Mais Há…