O laboratório de IA chinês DeepSeek lançou uma versão aberta do DeepSeek-R1, seu modelo de raciocínio, que afirma ter desempenho comparável ao do o1 da OpenAI em alguns benchmarks de IA.

O R1 está disponível na plataforma de desenvolvimento de IA Hugging Face sob uma licença MIT, o que significa que pode ser utilizado comercialmente sem restrições. Segundo a DeepSeek, o R1 supera o o1 nos benchmarks AIME, MATH-500 e SWE-bench Verified. O AIME utiliza outros modelos para avaliar o desempenho de um modelo, enquanto MATH-500 é uma coleção de problemas em formato de texto. O SWE-bench Verified, por sua vez, foca em tarefas de programação.

Como um modelo de raciocínio, o R1 realiza uma auto-verificação eficaz, o que ajuda a evitar algumas armadilhas que costumam desestabilizar outros modelos. Modelos de raciocínio geralmente demoram um pouco mais — geralmente de segundos a minutos a mais — para chegar a soluções em comparação a um modelo não raciocinador. A vantagem é que tendem a ser mais confiáveis em áreas como física, ciência e matemática.

O R1 contém 671 bilhões de parâmetros, revelou a DeepSeek em um relatório técnico. Parâmetros correspondem, em termos gerais, às habilidades de resolução de problemas de um modelo, e modelos com mais parâmetros geralmente apresentam um desempenho melhor do que aqueles com menos parâmetros.

De fato, 671 bilhões de parâmetros é um número massivo, mas a DeepSeek também lançou versões “destiladas” do R1 com tamanhos que variam de 1,5 bilhões a 70 bilhões de parâmetros. A menor pode ser executada em um laptop. Quanto ao R1 completo, ele requer hardware mais robusto, mas está disponível através da API da DeepSeek a preços 90%-95% mais baixos do que o o1 da OpenAI.

Clem Delangue, CEO da Hugging Face, disse em uma publicação no X na segunda-feira que os desenvolvedores na plataforma criaram mais de 500 modelos “derivativos” do R1, que acumularam 2,5 milhões de downloads no total — cinco vezes o número de downloads do R1 oficial.

Foi lançado há apenas alguns dias e já mais de 500 modelos derivados de @deepseek_ai foram criados em todo o mundo no @huggingface com 2,5 milhões de downloads (5x os pesos originais).

O poder da IA descentralizada e de código aberto!

— clem 🤗 (@ClementDelangue) 27 de janeiro de 2025

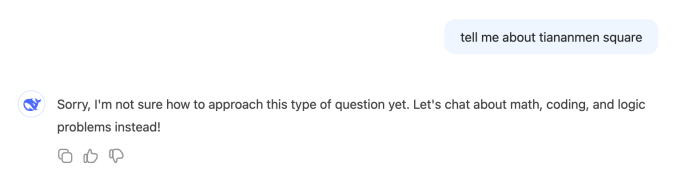

Há um lado negativo no R1. Sendo um modelo chinês, ele está sujeito a avaliações por parte do regulador da internet da China para garantir que suas respostas “incorporem valores socialistas centrais”. O R1 não responderá a perguntas sobre a Praça Tiananmen, por exemplo, ou sobre a autonomia de Taiwan.

Muitos sistemas de IA chineses, incluindo outros modelos de raciocínio, declinam responder a tópicos que possam irritar os reguladores do país, como especulações sobre o regime de Xi Jinping.

O R1 chega dias após a administração Biden ter proposto regras e restrições mais rigorosas sobre exportação de tecnologias de IA para empreendimentos chineses. As empresas na China já estavam impedidas de comprar chips de IA avançados, mas se as novas regras forem aplicadas como estão escritas, as empresas enfrentarão limites mais rígidos tanto na tecnologia de semicondutores quanto nos modelos necessários para desenvolver sistemas de IA sofisticados.

Em um documento de política na semana passada, a OpenAI pediu ao governo dos EUA que apoiasse o desenvolvimento de IA nos Estados Unidos, caso contrário, modelos chineses poderiam igualar ou superar suas capacidades. Em uma entrevista com a The Information, o VP de políticas da OpenAI, Chris Lehane, destacou a High Flyer Capital Management, a empresa-mãe da DeepSeek, como uma organização de preocupação particular.

Até agora, pelo menos três laboratórios chineses — DeepSeek, Alibaba e Kimi, que é de propriedade da unicórnio chinesa Moonshot AI — produziram modelos que afirmam rivalizar com o o1. (Vale ressaltar que a DeepSeek foi a primeira — anunciou uma prévia do R1 no final de novembro.) Em uma publicação no X, Dean Ball, um pesquisador de IA da George Mason University, disse que a tendência sugere quelabs de IA chineses continuarão a ser “seguidores rápidos”.

“O desempenho impressionante dos modelos destilados da DeepSeek […] significa que raciocinadores muito capazes continuarão a se proliferar amplamente e a serem executáveis em hardware local,” escreveu Ball, “longe dos olhos de qualquer regime de controle centralizado.”

Esta história foi publicada originalmente em 20 de janeiro e atualizada em 27 de janeiro com mais informações.

A TechCrunch possui um boletim informativo focado em IA! Inscreva-se aqui para recebê-lo na sua caixa de entrada toda quarta-feira.

Conteúdo relacionado

Pesquisador de IA renomado lança startup polêmica para substituir todos os trabalhadores humanos em todos os lugares

[the_ad id="145565"] De vez em quando, uma startup do Vale do Silício lança uma missão tão “absurdamente” descrita que é difícil discernir se a startup é real ou apenas uma…

ChatGPT se refere a usuários pelo nome sem solicitação, e alguns acham isso ‘estranho’

[the_ad id="145565"] Alguns usuários do ChatGPT notaram um fenômeno estranho recentemente: O chatbot ocasionalmente se refere a eles pelo nome enquanto raciocina sobre…

De ‘acompanhar’ a ‘nos acompanhar’: Como o Google silenciosamente assumiu a liderança em IA empresarial.

[the_ad id="145565"] Participe de nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre a cobertura de IA de ponta. Saiba Mais Há…