Participe de nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre cobertura de IA de ponta na indústria. Saiba mais

A startup canadense de IA, Cohere, foi lançada em 2019 com o objetivo de atender ao setor empresarial, mas pesquisas independentes indicam que ela até agora enfrentou dificuldades para conquistar uma parte do mercado entre desenvolvedores terceirizados em comparação com rivais de modelos proprietários nos EUA, como OpenAI e Anthropic, sem mencionar a ascensão do competidor chinês de código aberto, DeepSeek.

No entanto, a Cohere continua a expandir suas ofertas: Hoje, sua divisão de pesquisa sem fins lucrativos, Cohere for AI, anunciou o lançamento de seu primeiro modelo de visão, Aya Vision, um novo modelo de IA multimodal de pesos abertos que integra capacidades de linguagem e visão e se destaca por suportar entradas em 23 idiomas diferentes falados por aquilo que a Cohere afirma em uma postagem oficial ser “metade da população mundial”, tornando-o atraente para um amplo público global.

O Aya Vision foi projetado para aprimorar a capacidade da IA de interpretar imagens, gerar texto e traduzir conteúdo visual em linguagem natural, tornando a IA multilíngue mais acessível e eficaz. Isso pode ser especialmente útil para empresas e organizações que operam em múltiplos mercados ao redor do mundo, com diferentes preferências linguísticas.

Ele já está disponível no site da Cohere e nas comunidades de código de IA Hugging Face e Kaggle sob uma licença Creative Commons Attribution-NonCommercial 4.0 International (CC BY-NC 4.0), permitindo que pesquisadores e desenvolvedores possam usar, modificar e compartilhar o modelo para fins não comerciais, desde que a atribuição adequada seja dada.

Além disso, Aya Vision está disponível através do WhatsApp, permitindo que os usuários interajam com o modelo diretamente em um ambiente familiar.

Isso, infelizmente, limita seu uso para empresas e como uma ferramenta para aplicativos pagos ou fluxos de trabalho lucrativos.

Ele está disponível nas versões de 8 bilhões e 32 bilhões de parâmetros (parâmetros se referem ao número de definições internas em um modelo de IA, incluindo seus pesos e vieses; geralmente, mais parâmetros indicam um modelo mais poderoso e de melhor desempenho).

Suporta 23 idiomas e contando

Embora os principais modelos de IA de rivais possam entender texto em vários idiomas, expandir essa capacidade para tarefas baseadas em visão é um desafio.

No entanto, o Aya Vision supera isso, permitindo que os usuários gerem legendas de imagens, respondam a perguntas visuais, traduzam imagens e realizem tarefas de linguagem baseadas em texto em um conjunto diversificado de idiomas:

1. Inglês

2. Francês

3. Alemão

4. Espanhol

5. Italiano

6. Português

7. Japonês

8. Coreano

9. Chinês

10. Árabe

11. Grego

12. Persa

13. Polonês

14. Indonésio

15. Checo

16. Hebraico

17. Hindi

18. Holandês

19. Romeno

20. Russo

21. Turco

22. Ucraniano

23. Vietnamita

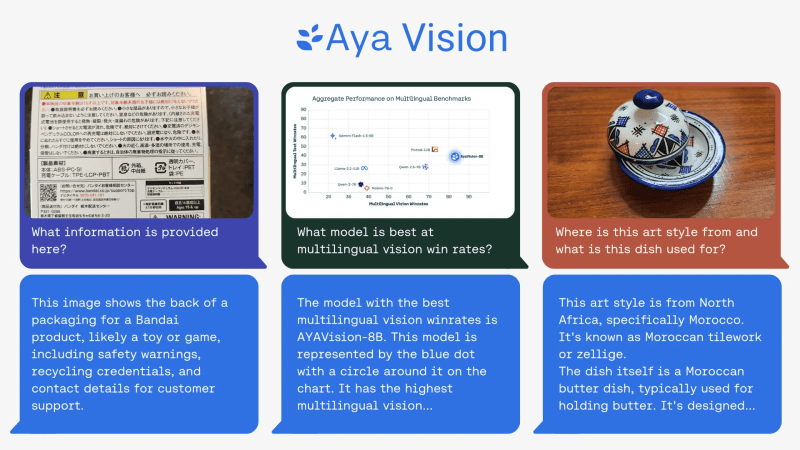

Em sua postagem no blog, a Cohere mostrou como o Aya Vision pode analisar imagens e texto em embalagens de produtos e fornecer traduções ou explicações. Ele também pode identificar e descrever estilos artísticos de diferentes culturas, ajudando os usuários a aprender sobre objetos e tradições através da compreensão visual impulsionada por IA.

As capacidades do Aya Vision têm amplas implicações em múltiplas áreas:

• Aprendizado de idiomas e educação: Os usuários podem traduzir e descrever imagens em vários idiomas, tornando o conteúdo educacional mais acessível.

• Preservação cultural: O modelo pode gerar descrições detalhadas de arte, marcos e artefatos históricos, apoiando a documentação cultural em idiomas sub-representados.

• Ferramentas de acessibilidade: A IA baseada em visão pode auxiliar usuários com deficiência visual, fornecendo descrições detalhadas de imagens em sua língua nativa.

• Comunicação global: A tradução multimodal em tempo real permite que organizações e indivíduos se comuniquem de maneira mais eficaz em diferentes idiomas.

Desempenho forte e alta eficiência em benchmarks líderes

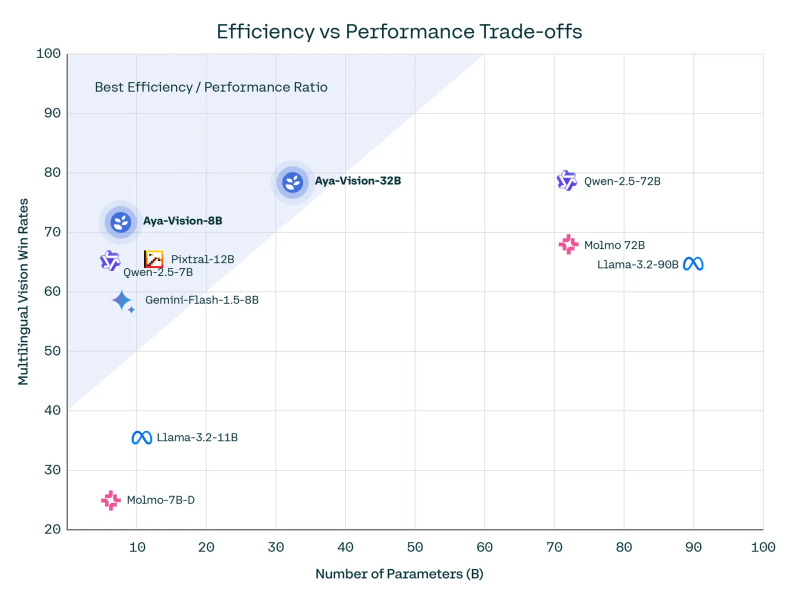

Uma das características marcantes do Aya Vision é sua eficiência e desempenho em relação ao tamanho do modelo. Apesar de ser significativamente menor que alguns modelos multimodais líderes, o Aya Vision superou alternativas muito maiores em vários benchmarks-chave.

• O Aya Vision 8B supera o Llama 90B, que é 11 vezes maior.

• O Aya Vision 32B supera o Qwen 72B, Llama 90B e Molmo 72B, todos com pelo menos o dobro de tamanho (ou mais).

• Resultados de benchmark no AyaVisionBench e m-WildVision mostram que o Aya Vision 8B alcança taxas de vitória de até 79%, e o Aya Vision 32B atinge 72% de taxas de vitória em tarefas de compreensão de imagens multilíngues.

Uma comparação visual da eficiência em relação ao desempenho destaca a vantagem do Aya Vision. Como mostrado no gráfico de trade-off entre eficiência e desempenho, o Aya Vision 8B e 32B demonstram um desempenho de classe mundial em relação ao tamanho de seus parâmetros, superando modelos muito maiores enquanto mantêm eficiência computacional.

As inovações tecnológicas por trás do Aya Vision

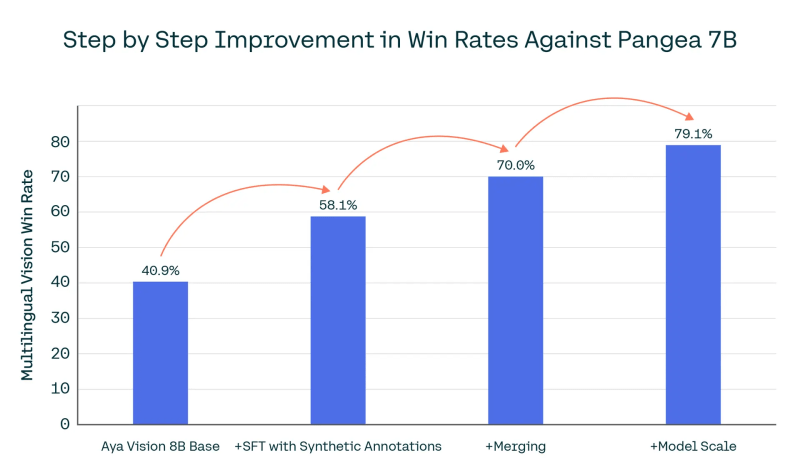

A Cohere For AI atribui os ganhos de desempenho do Aya Vision a várias inovações-chave:

• Anotações sintéticas: O modelo utiliza geração de dados sintéticos para aprimorar o treinamento em tarefas multimodais.

• Escalonamento de dados multilíngues: Ao traduzir e reformular dados em diferentes idiomas, o modelo ganha uma compreensão mais ampla de contextos multilíngues.

• Mesclagem de modelos multimodais: Técnicas avançadas combinam insights dos modelos de visão e linguagem, melhorando o desempenho geral.

Esses avanços permitem que o Aya Vision processe imagens e textos com maior precisão, mantendo fortes capacidades multilíngues.

O gráfico de melhoria de desempenho passo a passo ilustra como inovações incrementais, incluindo fine-tuning sintético (SFT), mesclagem de modelos e escalonamento, contribuíram para as altas taxas de vitória do Aya Vision.

Implicações para tomadores de decisão empresariais

Apesar do Aya Vision ostensivamente atender ao setor empresarial, as empresas podem ter dificuldade em utilizá-lo, dadas suas restritivas condições de licenciamento não comerciais.

No entanto, CEOs, CTOs, líderes de TI e pesquisadores de IA podem usar os modelos para explorar capacidades multilíngues e multimodais impulsionadas por IA em suas organizações — particularmente em pesquisa, prototipagem e benchmark.

As empresas ainda podem usá-lo para pesquisa e desenvolvimento internos, avaliando o desempenho de IA multilíngue e experimentando aplicações multimodais.

CTOs e equipes de IA acharão o Aya Vision valioso como um modelo de pesos abertos altamente eficiente, que supera alternativas muito maiores enquanto requer menos recursos computacionais.

Isso o torna uma ferramenta útil para benchmark contra modelos proprietários, explorando soluções potenciais impulsionadas por IA e testando interações multimodais multilíngues antes de se comprometer com uma estratégia de implantação comercial.

Para cientistas de dados e pesquisadores de IA, o Aya Vision é muito mais útil.

Sua natureza open-source e rigorosos benchmarks fornecem uma base transparente para estudar o comportamento do modelo, fine-tuning em configurações não comerciais e contribuir para os avanços da IA aberta.

Seja utilizado para pesquisa interna, colaborações acadêmicas ou avaliações de ética de IA, o Aya Vision serve como um recurso de ponta para empresas que buscam estar na vanguarda da IA multilíngue e multimodal — sem as restrições de modelos proprietários e de código fechado.

Pesquisa e colaboração de código aberto

O Aya Vision é parte da Aya, uma iniciativa mais ampla da Cohere focada em tornar a IA e a tecnologia relacionada mais multilíngue.

Desde sua criação em fevereiro de 2024, a iniciativa Aya envolveu uma comunidade global de pesquisa com mais de 3.000 pesquisadores independentes em 119 países, trabalhando juntos para melhorar modelos de IA de linguagem.

Para reforçar seu compromisso com a ciência aberta, a Cohere lançou os pesos abertos para o Aya Vision 8B e 32B no Kaggle e Hugging Face, garantindo que pesquisadores de todo o mundo possam acessar e experimentar os modelos. Além disso, a Cohere For AI apresentou o AyaVisionBenchmark, um novo conjunto de avaliação de visão multilíngue projetado para fornecer uma estrutura rigorosa de avaliação para IA multimodal.

A disponibilidade do Aya Vision como um modelo de pesos abertos marca um passo importante na criação de uma pesquisa de IA multilíngue mais inclusiva e acessível.

O Aya Vision se baseia no sucesso do Aya Expanse, outra família de LLM da Cohere For AI focada em IA multilíngue. Ao expandir seu foco para a IA multimodal, a Cohere For AI está posicionando o Aya Vision como uma ferramenta-chave para pesquisadores, desenvolvedores e empresas que buscam integrar IA multilíngue em seus fluxos de trabalho.

À medida que a iniciativa Aya continua a evoluir, a Cohere For AI também anunciou planos para lançar um novo esforço de pesquisa colaborativa nas próximas semanas. Pesquisadores e desenvolvedores interessados em contribuir com avanços em IA multilíngue podem se juntar à comunidade de ciência aberta ou se inscrever para bolsas de pesquisa.

Por enquanto, o lançamento do Aya Vision representa um salto significativo na IA multimodal multilíngue, oferecendo uma solução de alto desempenho e pesos abertos que desafia o domínio de modelos maiores e de código fechado. Ao tornar esses avanços disponíveis para a comunidade de pesquisa em geral, a Cohere For AI continua a expandir os limites do que é possível em comunicação multilíngue impulsionada por IA.

Insights diários sobre casos de uso empresarial com VB Daily

Se você deseja impressionar seu chefe, o VB Daily te cobre. Nós fornecemos informações sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para o máximo ROI.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais boletins do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

Co-fundador da Hugging Face, Thomas Wolf, desafia a visão do CEO da Anthropic para o futuro da IA — e a indústria de $130 bilhões está prestando atenção.

[the_ad id="145565"] Participe de nossas newsletters diárias e semanais para receber as últimas atualizações e conteúdos exclusivos sobre a cobertura líder do setor em IA.…

O que é Mistral AI? Tudo o que você precisa saber sobre o concorrente da OpenAI.

[the_ad id="145565"] A Mistral AI, a empresa francesa responsável pelo assistente de IA Le Chat e vários modelos fundamentais, é oficialmente considerada uma das startups de…

Um padrão aberto para construção de agentes de IA está chegando da Cisco, LangChain e Galileo.

[the_ad id="145565"] Participe de nossas newsletters diárias e semanais para receber as últimas atualizações e conteúdos exclusivos sobre a cobertura de inteligência…