Junte-se aos nossos boletins diários e semanais para as últimas atualizações e conteúdo exclusivo sobre coberturas de IA líderes do setor. Saiba Mais

Um novo framework chamado METASCALE permite que grandes modelos de linguagem (LLMs) se adaptem dinamicamente ao seu modo de raciocínio no momento da inferência. Este framework aborda uma das limitações dos LLMs, que é utilizar a mesma estratégia de raciocínio para todos os tipos de problemas.

Apresentado em um artigo de pesquisadores da Universidade da Califórnia, Davis, da Universidade do Sul da Califórnia e da Microsoft Research, o METASCALE utiliza “meta-pensamentos” — estratégias de pensamento adaptativas específicas para cada tarefa — para melhorar o desempenho e a generalização dos LLMs em diversas tarefas.

Essa abordagem pode oferecer às empresas uma maneira de aumentar a precisão e a eficiência de suas aplicações LLM sem precisar alterar os modelos ou se envolver em caros esforços de ajuste fino.

As limitações das Estratégias de Raciocínio Fixas

Um dos principais desafios das aplicações LLM é seu comportamento de raciocínio fixo e inflexível. Ao contrário dos humanos, que podem escolher conscientemente diferentes abordagens para resolver problemas, os LLMs geralmente dependem de correspondências de padrão de seus dados de treinamento, o que pode não sempre alinhar-se aos princípios de raciocínio sólidos que os humanos utilizam.

Métodos atuais para ajustar o processo de raciocínio dos LLMs, como prompts de cadeia de pensamento (CoT), auto-verificação e pensamento reverso, geralmente são projetados para tarefas específicas, limitando sua adaptabilidade e eficácia em cenários diversos.

Os pesquisadores destacam que “essas abordagens impõem estruturas de pensamento fixas em vez de permitir que os LLMs determine adaptivamente a estratégia específica da tarefa mais eficaz, potencialmente limitando seu desempenho.”

Para abordar essa limitação, os pesquisadores propõem o conceito de “meta-pensamento.” Este processo permite que os LLMs reflitam sobre sua abordagem antes de gerar uma resposta. Os meta-pensamentos orientam o processo de raciocínio através de dois componentes inspirados na cognição humana:

Estado cognitivo: A perspectiva, expertise ou função que o modelo adota para abordar a tarefa.

Estratégia de resolução de problemas: Um padrão estruturado usado para formular uma solução para a tarefa com base no estado de espírito escolhido.

Em vez de enfrentar diretamente um problema, o LLM primeiro determina como pensar, selecionando a estratégia cognitiva mais adequada. Por exemplo, quando confrontado com um problema complexo de software, o LLM pode primeiro considerar o tipo de profissional que resolveria isso (por exemplo, um engenheiro de software) e escolher uma estratégia para abordar o problema (por exemplo, usando padrões de design para decompor o problema ou usando uma abordagem de micro-serviços para simplificar a implementação).

“Ao incorporar essa etapa de meta-pensamento, os LLMs podem adaptar dinamicamente seu processo de raciocínio para diferentes tarefas, em vez de depender de heurísticas rígidas e predefinidas,” escrevem os pesquisadores.

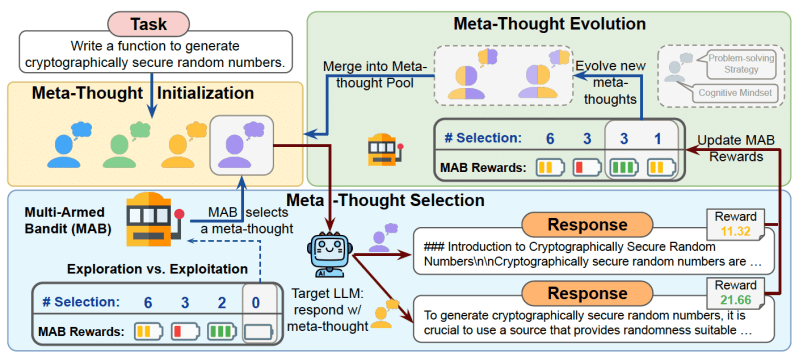

Baseando-se nos meta-pensamentos, os pesquisadores introduzem o METASCALE, um framework de teste que pode ser aplicado a qualquer modelo através de engenharia de prompts.

“O objetivo é permitir que os LLMs explorem diferentes estratégias de raciocínio e gerem a resposta mais eficaz para uma determinada entrada,” afirmam.

O METASCALE opera em três fases:

Inicialização: O METASCALE gera um pool diversificado de estratégias de raciocínio com base no prompt de entrada. Ele faz isso solicitando que o LLM se auto-componha estratégias e aproveitando conjuntos de dados de ajuste com instruções contendo modelos de raciocínio para diferentes tipos de problemas. Essa combinação cria um rico pool inicial de meta-pensamentos.

Seleção: Um algoritmo Multi-Armed Bandit (MAB) seleciona o meta-pensamento mais promissor para cada iteração. MAB é um framework de problemas onde um agente deve escolher repetidamente entre várias opções, ou “braços,” cada uma com distribuições de recompensa desconhecidas. O desafio principal é equilibrar “exploração” (por exemplo, tentando diferentes estratégias de raciocínio) e “exploração” (selecionando consistentemente a estratégia de raciocínio que anteriormente forneceu as melhores respostas). No METASCALE, cada meta-pensamento é tratado como um braço, e o objetivo é maximizar a recompensa (qualidade da resposta) com base no meta-pensamento selecionado.

Evolution: Um algoritmo genético refina e expande o pool de estratégias cognitivas de maneira iterativa. O METASCALE utiliza meta-pensamentos de alto desempenho como “pais” para produzir novos meta-pensamentos “filhos.” O LLM é solicitado a desenvolver meta-pensamentos refinados que integrem e melhorem os pais selecionados. Para manter a eficiência, o METASCALE opera dentro de um orçamento de amostragem fixo ao gerar os meta-pensamentos.

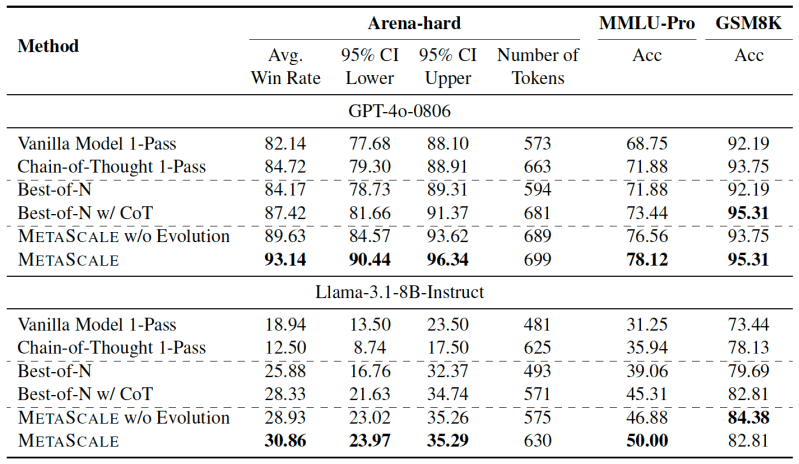

Os pesquisadores avaliaram o METASCALE em benchmarks de raciocínio matemático (GSM8K), conhecimento e compreensão de linguagem (MMLU-Pro) e Arena-Hard, comparando-o a quatro métodos de inferência de baseline: respostas diretas (inferência em uma única passada), CoT, Best-of-N (amostrando várias respostas e escolhendo a melhor) e Best-of-N com CoT. Eles usaram o GPT-4o e o Llama-3.1-8B-Instruct como modelos base para seus experimentos.

Os resultados mostram que o METASCALE melhora significativamente as capacidades de resolução de problemas dos LLMs em diversas tarefas, superando consistentemente os métodos de baseline. O METASCALE alcançou desempenho igual ou superior em comparação com todos os baselines, independentemente do uso do prompting CoT. Notavelmente, o GPT-4o com METASCALE superou o o1-mini sob controle de estilo.

“Esses resultados demonstram que a integração de meta-pensamentos permite que os LLMs escalem mais efetivamente durante o tempo de teste à medida que o número de amostras aumenta,” afirmam os pesquisadores.

À medida que o número de soluções candidatas aumentou, o METASCALE mostrou ganhos significativamente maiores do que outros baselines, indicando que é uma estratégia de escalonamento mais eficaz.

Implicações para o Empreendimento

Como uma técnica de teste, o METASCALE pode ajudar as empresas a melhorar a qualidade do raciocínio dos LLMs por meio de uma engenharia de prompts inteligente, sem a necessidade de ajustar ou trocar modelos. Ele também não requer a construção de estruturas de software complexas além dos modelos, já que toda a lógica é fornecida pelo próprio LLM.

Ao ajustar dinamicamente as estratégias de raciocínio dos LLMs, o METASCALE também é prático para aplicações do mundo real que lidam com diversas tarefas de raciocínio. Além disso, é um método de caixa-preta, que pode ser aplicado a modelos de código aberto executando na nuvem da empresa ou modelos fechados rodando atrás de APIs de terceiros. Ele demonstra capacidades promissoras de técnicas de escalonamento em tempo de teste para tarefas de raciocínio.

Insights diários sobre casos de uso empresarial com o VB Daily

Se você deseja impressionar seu chefe, o VB Daily tem tudo o que você precisa. Nós fornecemos informações internas sobre o que as empresas estão fazendo com IA generativa, desde mudanças regulatórias até implantações práticas, para que você possa compartilhar insights para um ROI máximo.

Leia nossa Política de Privacidade

Obrigado por se inscrever. Confira mais boletins do VB aqui.

Ocorreu um erro.

Conteúdo relacionado

Peter Diamandis responde à pergunta: A longevidade é apenas para os ricos?

[the_ad id="145565"] No episódio desta semana do StrictlyVC Download, a Editora Chefe do TechCrunch, Connie Loizos, e Alex Gove, da StrictlyVC, recebem o empreendedor,…

OpenAI irá lançar modelo de código aberto à medida que a economia da IA força uma mudança estratégica

[the_ad id="145565"] Certainly! Here’s the rewritten content in Portuguese while maintaining the HTML tags: <div> <div id="boilerplate_2682874"…

$40 bilhões para o fogo: À medida que a OpenAI ganha um milhão de usuários por hora, a corrida pela dominância em IA corporativa acelera em um novo nível.

[the_ad id="145565"] Junte-se aos nossos boletins diários e semanais para as últimas atualizações e conteúdos exclusivos sobre cobertura de IA líder de indústria.…