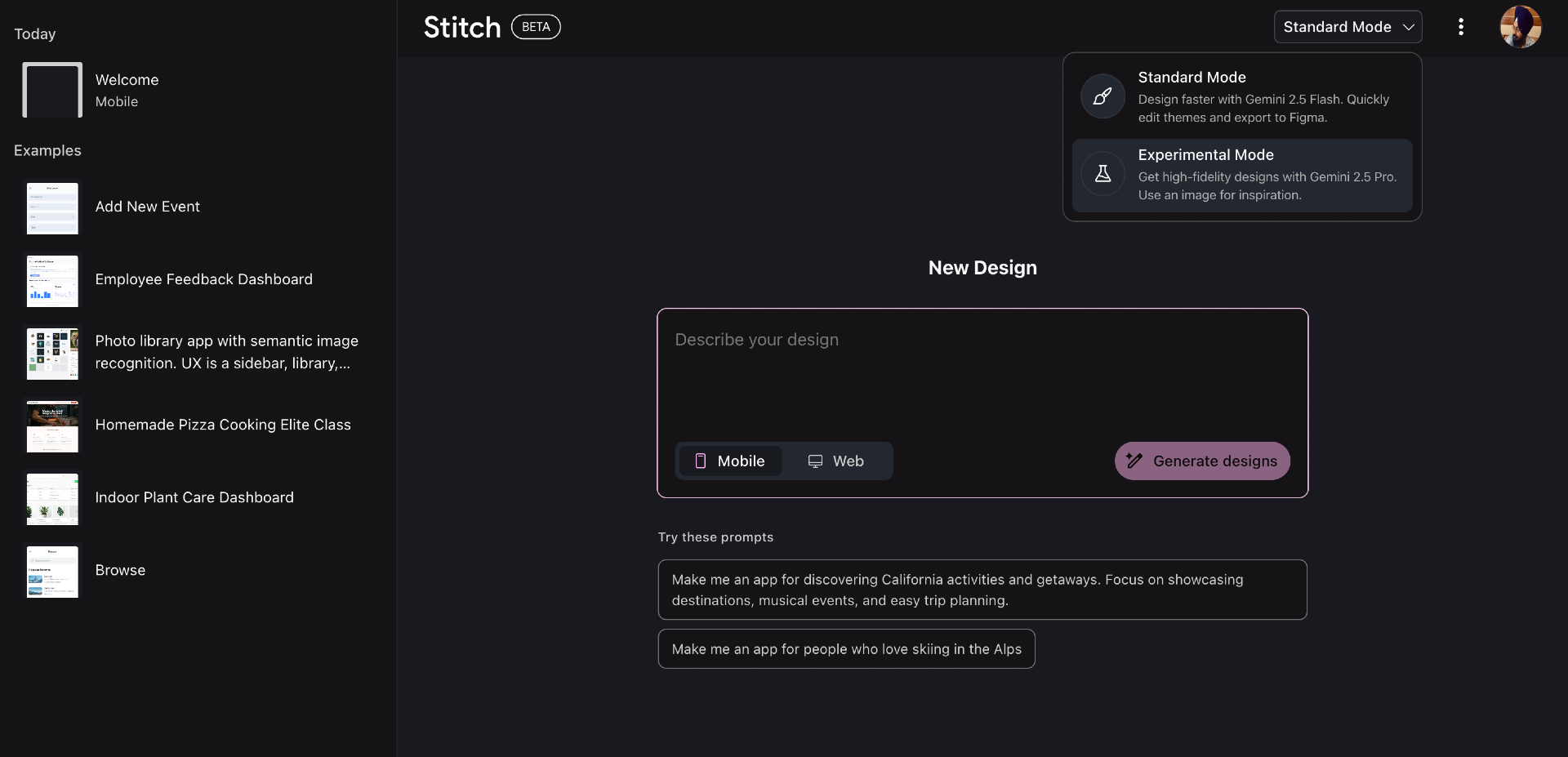

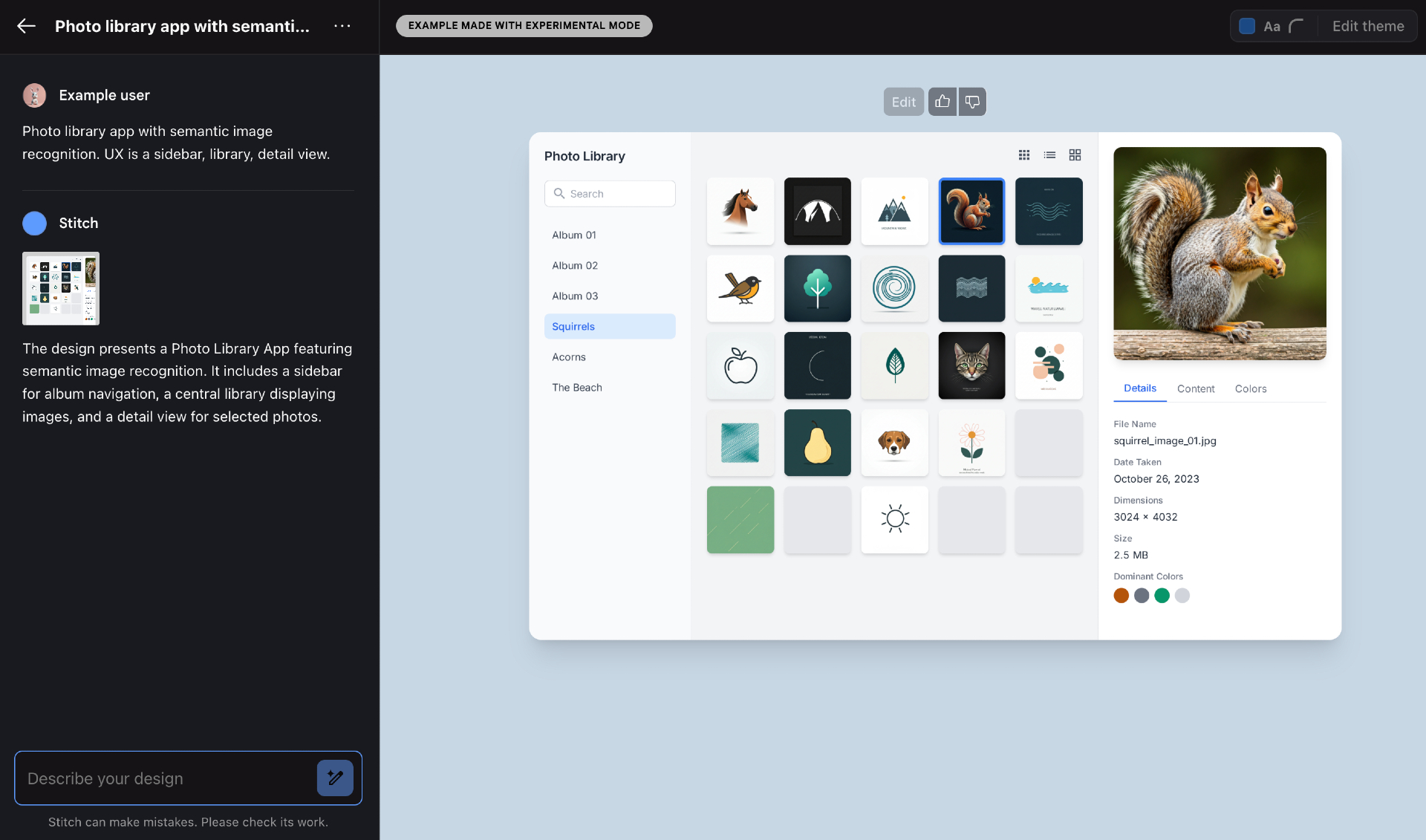

Na conferência de desenvolvedores Google I/O 2025, a Google lançou Stitch, uma ferramenta alimentada por IA para auxiliar na criação de interfaces de aplicativos web e móveis, gerando os elementos de UI e código necessários.

O Stitch pode ser acionado para criar UIs de aplicativos com algumas palavras ou até mesmo uma imagem, fornecendo marcação HTML e CSS para os designs que gera. Os usuários podem escolher entre os modelos de IA Gemini 2.5 Pro e Gemini 2.5 Flash para impulsionar a codificação e a ideação de interface do Stitch.

O Stitch chega em um momento em que a programação por vibe – programação usando modelos de IA que geram código – continua a crescer em popularidade. Várias grandes startups de tecnologia estão competindo neste mercado emergente, incluindo a fabricante do Cursor, Anysphere, Cognition e Windsurf. Apenas na semana passada, a OpenAI lançou um novo serviço assistivo de codificação chamado Codex. E ontem, durante o início do Build 2025, a Microsoft lançou uma série de atualizações para seu assistente de codificação GitHub Copilot.

Embora o Stitch seja um pouco mais limitado em sua funcionalidade em comparação com alguns outros produtos de codificação por vibe, ele oferece uma boa quantidade de opções de personalização. A ferramenta suporta exportação direta para o Figma e pode expor o código para que ele possa ser refinado e trabalhado em um IDE. O Stitch também permite que os usuários ajustem qualquer um dos elementos de design de aplicativo que gera.

Em uma demonstração com a TechCrunch, a gerente de produto do Google, Kathy Korevec, mostrou dois projetos criados com o Stitch: um design de UI móvel responsivo para um aplicativo para amantes de livros e um painel web para apicultura.

“[O Stitch é] onde você pode vir e fazer sua iteração inicial, e depois você pode continuar a partir daí,” disse Korevec. “O que queremos fazer é tornar super, super fácil e acessível para as pessoas realizarem esse próximo nível de pensamento de design ou esse próximo nível de construção de software para elas.”

Logo após o I/O, a Google planeja adicionar um recurso que permitirá aos usuários fazer alterações em seus designs de UI tirando capturas de tela do objeto que desejam ajustar e anotando-o com as modificações que desejam, disse Korevec. Ela acrescentou que, embora o Stitch seja razoavelmente poderoso, não se destina a ser uma plataforma de design completa como o Figma ou o Adobe XD.

Juntamente com o Stitch, a Google ampliou o acesso ao Jules, seu agente de IA destinado a ajudar desenvolvedores a corrigir bugs em seu código. Agora na beta pública, a ferramenta ajuda os desenvolvedores a entender códigos complexos, criar pull requests no GitHub e lidar com certos itens de backlog e tarefas de programação.

Em uma demonstração separada, Korevec mostrou o Jules atualizando um site que rodava a versão 16 do Node.js para a versão 22. O Jules clonou o código-base do site em uma máquina virtual limpa e compartilhou um “plano” para a atualização, que Korevec foi então convidada a aprovar. Uma vez que a atualização foi concluída, Korevec pediu ao Jules para verificar se o site ainda funcionava corretamente — o que o Jules fez.

Atualmente, o Jules usa o Gemini 2.5 Pro, mas Korevec disse à TechCrunch que os usuários poderão alternar entre diferentes modelos no futuro.

Conteúdo relacionado

O Veo 3 pode gerar vídeos — e trilhas sonoras para acompanhá-los.

[the_ad id="145565"] O mais recente modelo de IA para geração de vídeos do Google, Veo 3, pode criar áudio para acompanhar os clipes que gera. Na terça-feira, durante a…

Google AI Ultra: Você terá que pagar R$ 249,99 por mês pelo melhor AI do Google.

[the_ad id="145565"] O Google está lançando um novo plano de assinatura chamado Google AI Ultra para reunir mais de seus produtos de IA em um só lugar. O novo plano, anunciado…

“Deep Think” aprimora o desempenho do modelo Google Gemini da Google.

[the_ad id="145565"] O Google está aprimorando seus modelos de IA mais avançados, o Gemini. Na terça-feira, durante o Google I/O 2025, a empresa anunciou o Deep Think, um modo…